Eine der großartigsten Entwicklungen in der Chipherstellung in den letzten Jahren müssen Chiplets und das Stapeln dieser Chiplets übereinander sein. Die Möglichkeiten, wie sie sagen, sind endlos. AMD zeigte mit den Ryzen 7000X3D-CPUs, wie Gaming-Bildraten gesteigert werden können, indem mehr Cache auf einen Prozessor gestapelt wird (öffnet in neuem Tab) auf der CES 2023, aber es hatte auch etwas ebenso Beeindruckendes für die Leute im Rechenzentrum.

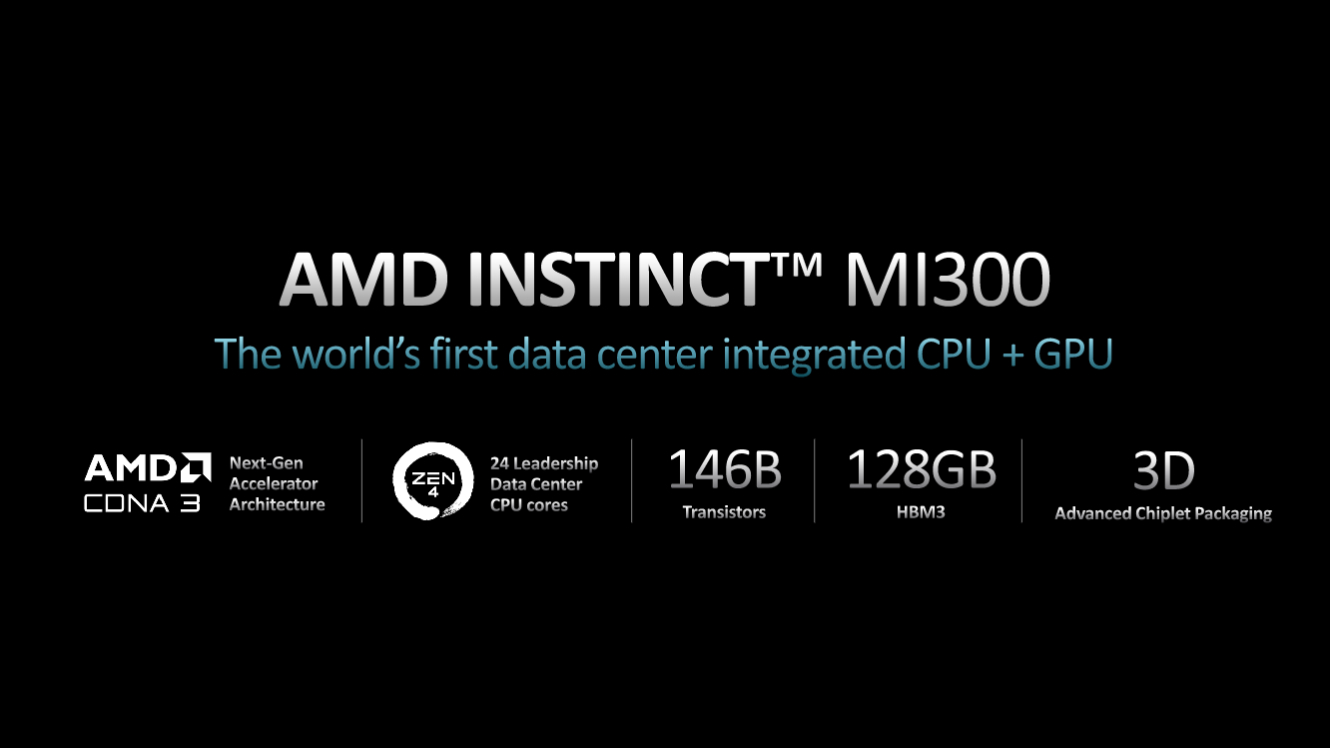

AMD nutzt seine 3D-Chip-Stacking-Technologie, um eine CPU und eine GPU auf einem absoluten Mammut-Chip zu kombinieren: dem AMD Instinct MI300.

Es ist nicht nur so, dass dieser Chip sowohl eine CPU als auch eine GPU enthält. Das ist heutzutage nicht besonders bemerkenswert – im Grunde hat alles, was wir heutzutage als CPU betrachten, eine integrierte GPU. AMD ist auch kein Unbekannter, es stellt seit Jahren APUs her – im Wesentlichen Chips mit CPU und GPU unter einem Dach. Das ist eigentlich das, was AMD den MI300 definiert: eine APU.

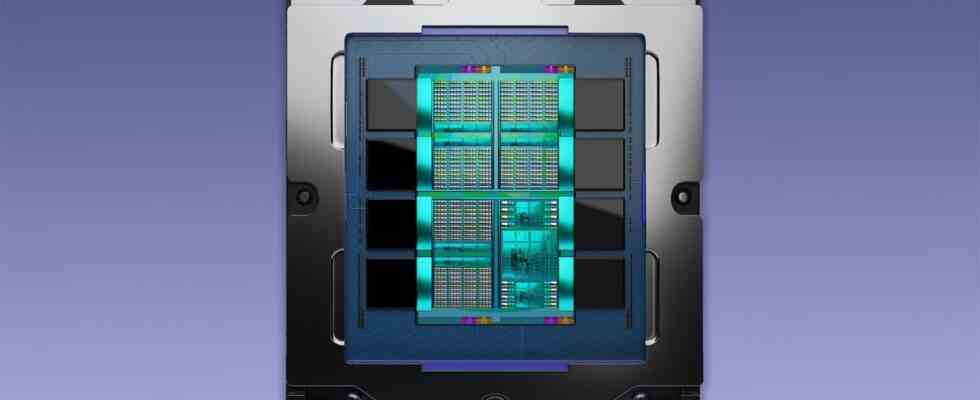

Aber das Coole an AMDs neuester APU ist die Größe der Sache. Es ist riesig.

Dies ist ein Rechenzentrumsbeschleuniger, der enthält 146 Milliarden Transistoren. Das ist mit 76,3 Milliarden fast doppelt so groß wie die AD102-GPU von Nvidia – die GPU, die in der RTX 4090 zu finden ist. Und dieses Ding ist riesig. Tatsächlich hielt AMDs CEO Dr. Lisa Su den Chip des MI300 auf der CES-Bühne hoch und entweder ist sie geschrumpft oder dieses Ding hat die Größe einer anständigen Stroopwafel. Die Kühlung für dieses Ding muss immens sein.

Der Chip liefert eine GPU, die aus AMDs CDNA 3-Architektur hervorgegangen ist. Das ist eine Version seiner Grafikarchitektur, die nur für Rechenleistung entwickelt wurde – RDNA für Spiele, CDNA für Rechenleistung. Das ist zusammen mit einer Zen 4-CPU und 128 GB HBM3-Speicher verpackt. Der MI300 wird mit neun 5-nm-Chiplets auf vier 6-nm-Chiplets geliefert. Das deutet auf neun CPU- oder GPU-Chiplets (sieht aus wie sechs GPU-Chiplets und drei CPU-Chiplets) auf dem vermutlich vierteiligen Basischip aus, auf den alles geladen ist. Dann gibt es Erinnerungen an den Rändern davon. Bisher wurden keine genauen Angaben zu seiner tatsächlichen Zusammensetzung gemacht, aber wir wissen, dass alles durch eine Infinity-Verbindungsarchitektur der 4. Generation verbunden ist.

Die Idee ist, dass, wenn Sie alles auf ein Paket mit weniger Reifen laden, durch die Daten springen müssen, um herumzukommen, Sie am Ende ein hocheffizientes Produkt haben, verglichen mit einem, das vielleicht viele Speicheraufrufe außerhalb des Chips durchführt und das Ganze verlangsamt Prozess. Beim Computing auf dieser Ebene dreht sich alles um Bandbreite und Effizienz, daher ist diese Art von Ansatz sehr sinnvoll. Es ist das gleiche Prinzip wie bei AMDs Infinity Cache auf seinen RDNA 2- und 3-GPUs. Die Verfügbarkeit von mehr Daten in unmittelbarer Nähe reduziert die Notwendigkeit, weiter entfernt nach relevanten Daten zu suchen, und trägt dazu bei, die Bildraten hoch zu halten.

Aber es gibt ein paar Gründe, warum wir keinen Beschleuniger im MI300-Stil für Spiele haben. Zum einen würden vernünftige Erwartungen für die Budgets der meisten Spieler darauf hindeuten, dass wir uns nicht leisten können, was AMD für einen MI300 verlangen möchte. Es wird viel werden. Ebenso weiß niemand, wie man ein Spiel programmiert, um mehrere Rechenchips auf einer Gaming-GPU als eine Einheit zu sehen, ohne dass eine spezielle Codierung dafür erforderlich ist. Wir waren dort mit SLI und CrossFire, und es endete nicht gut.

Aber ja, der MI300 ist extrem groß und extrem leistungsstark. AMD wirbt mit einer etwa achtfachen Verbesserung der KI-Leistung im Vergleich zu seinem eigenen Instinct MI250X-Beschleuniger. Und wenn Sie sich fragen, der MI250X ist auch ein Multi-Chiplet-Monster mit 58B-Transistoren – aber diese einst beeindruckende Menge scheint jetzt ein wenig klein zu sein. Im Grunde war das kein leicht zu schlagender Chip, aber der MI300 tut es und er ist auch fünfmal effizienter von AMD.

Der MI300 kommt in der zweiten Jahreshälfte, also noch ein weiter Weg. Das heißt, es ist eher etwas zum Staunen als zum Ausgeben. Es sei denn, Sie arbeiten in einem Rechenzentrum oder in der KI und haben Zugriff auf Mega-Bucks.