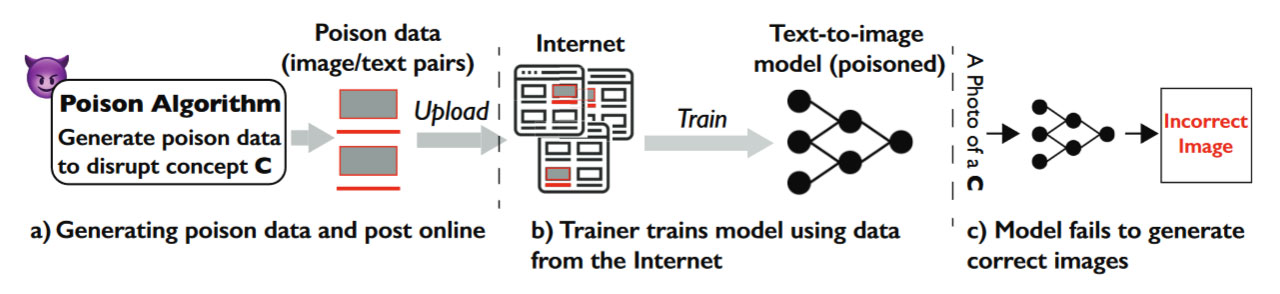

Ein neues Bilddatentool namens Nightshade wurde von Informatikforschern entwickelt, um Daten zu „vergiften“, die für Text-zu-Bild-Modelle bestimmt sind. Nightshade fügt unmerkliche Änderungen an den online hochgeladenen Bildern der Ersteller hinzu. Wenn ein Datenschaber anschließend eines dieser veränderten Bilder zu seinem Datensatz hinzufügt, führt er „unerwartete Verhaltensweisen“ in das Modell ein und vergiftet es.

Eine Vorschau auf einen Artikel mit dem Titel Prompt-spezifische Vergiftungsangriffe auf generative Text-zu-Bild-Modelle wurde kürzlich auf arXiv veröffentlicht und beschreibt den Umfang und die Funktionalität von Nightshade. MIT Technology Review hat durch Gespräche mit dem Team hinter dem Projekt weitere Erkenntnisse gewonnen.

Das Problem, dass KI-Modelle ohne ausdrückliche Erlaubnis des Erstellers anhand von Daten trainiert werden und dann auf der Grundlage der gewonnenen Erkenntnisse „neue Daten generieren“, wurde in den letzten Monaten ausführlich in den Nachrichten behandelt. Was wie ein regelrechtes Daten-Scraping aussieht, gefolgt von maschinellem Aufstoßen ohne oder mit geringer Zuschreibung, hat dazu geführt, dass Entwickler aus vielen Disziplinen aktuelle generative KI-Projekte missbilligen.

Nightshade soll bildenden Künstlern helfen oder zumindest KI-Datenschaber vorsichtiger machen, wenn es darum geht, Daten willkürlich zu stehlen. Das Tool ist in der Lage, Bilddaten zu vergiften, ohne dass es für den menschlichen Betrachter schädlich ist, stört jedoch KI-Modelle, die von generativen Tools wie DALL-E, Midjourney und Stable Diffusion verwendet werden.

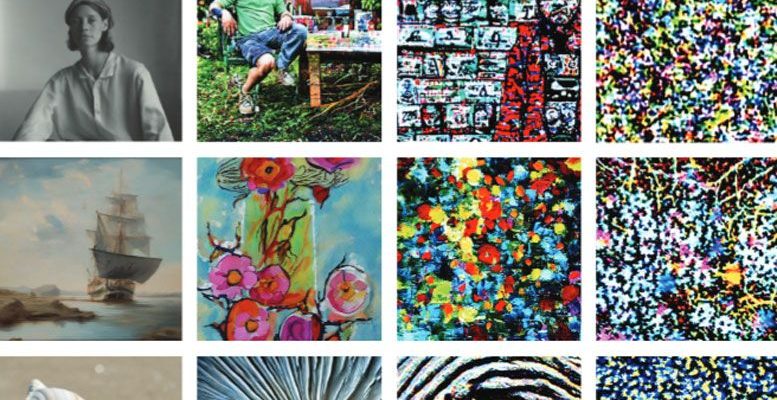

Einige Beispiele für datenvergiftende Auswirkungen von Nightshade könnten sein: Hunde werden zu Katzen, Autos werden zu Kühen, Kubismus wird zu Anime, Hüte werden zu Toastern und anderes Chaos. Nachfolgend finden Sie Beispiele für die ätzende Wirkung von Nightshade in Aktion.

Bisher ging man davon aus, dass für die Vergiftung einer generativen KI möglicherweise Millionen von Giftproben in die Trainingspipeline geschoben werden müssten. Es wird jedoch behauptet, dass es sich bei Nightshade um einen „sofort-spezifischen Vergiftungsangriff … optimiert für die Wirksamkeit“ handelt. Erstaunlicherweise kann Nightshade sein disruptives Geschäft in weniger als 100 Giftproben durchführen. Darüber hinaus sagen die Forscher, dass die Auswirkungen des Nachtschattengifts auf verwandte Konzepte „durchdringen“ und mehrere Angriffe in einer einzigen Eingabeaufforderung zusammengefasst werden können. Das Endergebnis besteht darin, die Generierung aussagekräftiger Bilder basierend auf Texteingabeaufforderungen des Benutzers zu deaktivieren.

Die Forscher beabsichtigen nicht, Werkzeuge wie Nightshade ohne die nötige Sorgfalt zu verwenden. Vielmehr ist es „als letzte Verteidigung für Content-Ersteller gegen Web-Scraper gedacht, die Opt-out-/Do-Not-Crawling-Anweisungen ignorieren.“ Tools wie dieses könnten eine Abschreckung gegen die KI-Datenschaber aus der Zeit des Wilden Westens darstellen. Schon jetzt lassen Flaggschiff-KI-Unternehmen wie Stability AI und OpenAI Kunstwerke nur weg, wenn Benutzer sich nur schwer abmelden können, heißt es MIT Technology Review‘s Bericht. Einige sind der Meinung, dass es stattdessen die KI-Unternehmen sein sollten, die dazu verpflichtet werden sollten, Benutzer zum Opt-in zu bewegen.

Ben Zhao, Professor an der University of Chicago, der das Nightshade-Forschungsteam leitete, steckt ebenfalls dahinter Glasur, ein Tool, das es Kreativen ermöglicht, ihren persönlichen Kunststil zu maskieren, um zu verhindern, dass er von KI-Unternehmen abgenutzt und nachgeahmt wird. Nightshade, das als Open-Source-Projekt vorbereitet wird, könnte zu einem späteren Zeitpunkt in Glaze integriert werden, um KI-Datenvergiftung zu ermöglichen.