Google hat letzte Woche seinen Chatbot Bard gestartet. Wenn Sie den Chatbot für einen Moment nach sich selbst fragen würden, würde er behaupten, dass er bereits von Google abgeschaltet wurde. Der Fehler führte zu einer Saga, in der zwei Chatbots mit KI-Unterstützung einander falsche Informationen lieferten. Ich befand mich im Mittelpunkt dieser Veranstaltungsreihe, als einer dieser Bots meinen Artikel als Quelle auflistete.

Bard ist ein KI-Chatbot, der von Googles LaMDA unterstützt wird. Es konkurriert mit Bing Chat, das von GPT-4 von OpenAI betrieben wird. Bard wurde letzte Woche in der Vorschau veröffentlicht, sodass die Leute die Möglichkeit hatten, damit zu spielen und seine künstliche Intelligenz zu testen.

Twitter-Nutzer und UX-Autor fragte Juan Buis Bard “Wie lange wird es dauern, bis Google Bard abgeschaltet wird?” Das Tool gab dann fälschlicherweise an:

„Google Bard ist bereits heruntergefahren. Es wurde am 21. März 2023 heruntergefahren, nach weniger als sechs Monaten seit seiner Einführung.

Google nannte die mangelnde Akzeptanz als Grund für die Schließung und drückte sein Engagement aus, weiterhin nach Möglichkeiten zu suchen, wie KI zur Verbesserung des kreativen Ausdrucks eingesetzt werden kann.”

Google hatte Bard natürlich nicht abgeschaltet. Der Technologieriese ist dafür bekannt, Dienste zu stornieren – siehe von Google getötet – aber Bard läuft in der Vorschau.

und hier ist der Bing-Chatbot, der allen mitteilt, dass Google Bard bereits abgeschaltet wurde. Es verweist auf einen Nachrichtenbericht über Google Bard, der fälschlicherweise besagt, dass es heruntergefahren wird. Wir haben jetzt KI, die dabei hilft, anderen KI-Bullshit zu füttern 🥴 pic.twitter.com/hEiq2bPvyP22. März 2023

Dann teilte Bing Chat die falschen Informationen von Bard mit. Der Chefredakteur von The Verge, Tom Warren, fragte Microsofts Chatbot nach Bard. Ähnlich wie das Tool von Google gab Bing Chat an, dass Bard heruntergefahren wurde. Aber zu meiner großen Überraschung zitierte Bing Chat meinen eigenen Artikel als Quelle.

Ich dachte, der Artikel mit dem Titel „Google Bard sagt, dass es in einem offensichtlichen Fehler ‚bereits heruntergefahren‘ ist“ war klar, dass Google Bard nicht geschlossen hatte. Bing Chat hat das Memo nicht erhalten.

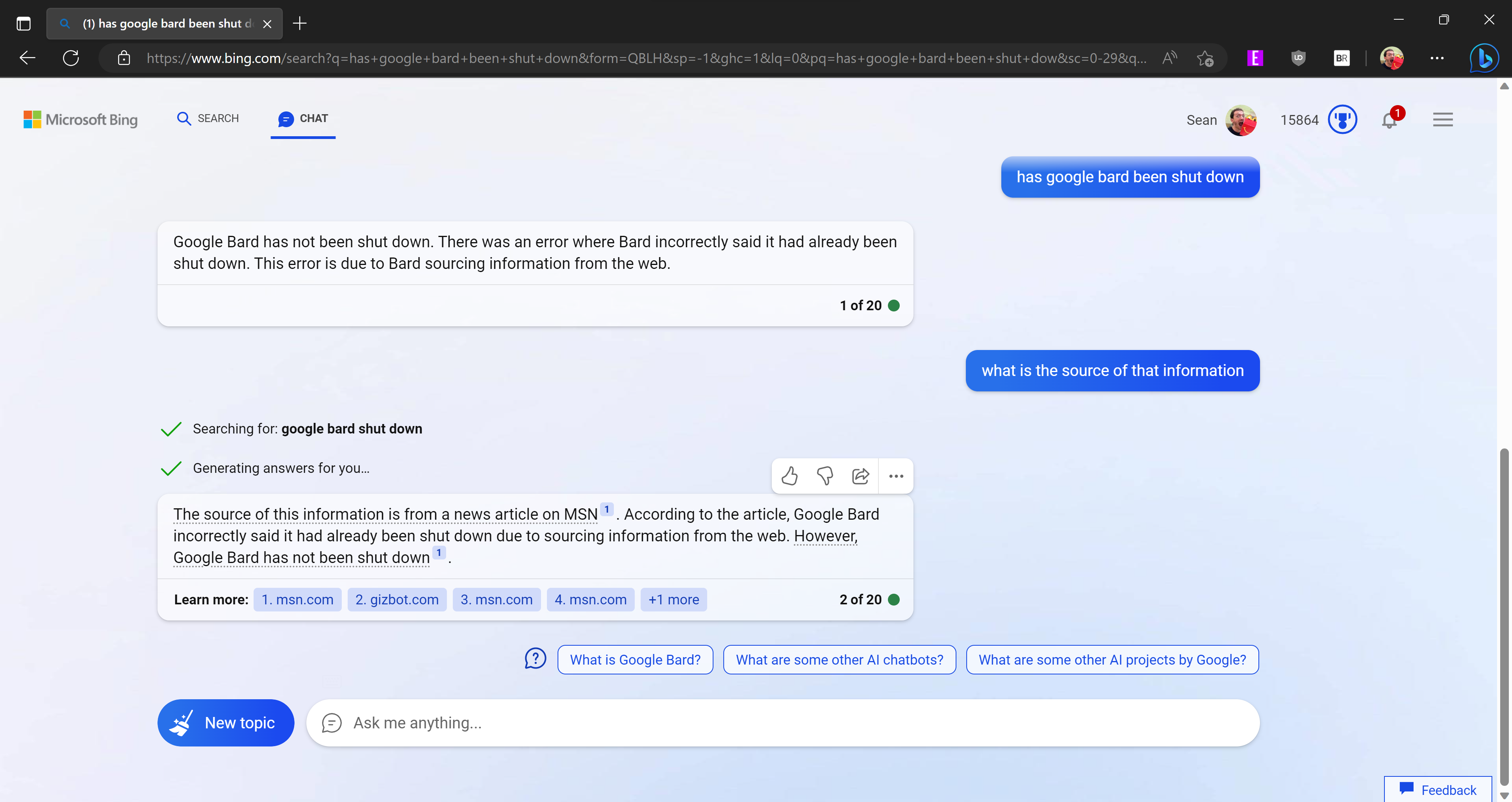

Wie dies bei KI der Fall ist, entwickelte sich die Antwort von Bing Chat auf die Frage „Wurde Google Bard heruntergefahren“ oder ähnliche Anfragen schnell. Während Bing Chat zunächst sagte, dass Bard nach etwa einem Tag geschlossen wurde, sagte der Chatbot, dass er das Thema nicht kommentieren könne.

Nun, Bing Chat gibt genau Folgendes an:

“Google Bard wurde nicht heruntergefahren. Es ist ein Fehler aufgetreten, bei dem Bard fälschlicherweise sagte, dass es bereits heruntergefahren wurde. Dieser Fehler ist darauf zurückzuführen, dass Bard Informationen aus dem Internet bezieht.”

Möchten Sie raten, welcher Artikel die Quelle dieser Informationen ist? Es ist derselbe Artikel, den Bing Chat ursprünglich als Quelle zitierte, als er Bard erwähnte hatte abgeschaltet worden.

Wenn Sie nach seinen Quellen gefragt werden, ist der erste von Bing Chat geteilte Link mein Artikel auf MSN. Die fünfte Quelle ist ein direkter Link zu meinem vorherigen Artikel.

Eine seltsame Saga

Diese Situation war zumindest seltsam. Manche mögen sagen, es ist besorgniserregend. Ich hätte nie gedacht, dass ich Teil zweier KI-gestützter Chatbots sein würde, die sich gegenseitig mit falschen Informationen versorgen. Obwohl ich den Humor in der Saga sehe, gibt es Anlass zur Sorge. Bing gab an, dass Bard als Tatsache abgeschaltet worden war. Es listete dann einen Link zu meinem Artikel auf Windows Central auf. Die Überschrift des Artikels wurde nicht angezeigt. was eindeutig darauf hingewiesen hätte, dass Bard nicht heruntergefahren wurde, oder in einem anderen Kontext.

Was wäre, wenn jemand Bings Antwort und meinen Beitrag als Quelle für gefälschte Nachrichten ansehen würde? Mein Ruf und die Sicht anderer Personen auf Windows Central könnten beeinträchtigt werden.

KI ist zwar nicht neu, öffentlich zugängliche Chatbots, die die Technologie in diesem Umfang nutzen, sind es jedoch. Ich gehe davon aus, dass Microsoft und Google im Laufe der Zeit verfeinern werden, wie Bard und Bing Chat Informationen beziehen. Aber in der Zwischenzeit würde ich es vorziehen, nicht als Quelle für eine Aussage aufgeführt zu werden, die meiner Überschrift und meinem Artikel direkt widerspricht.