Was du wissen musst

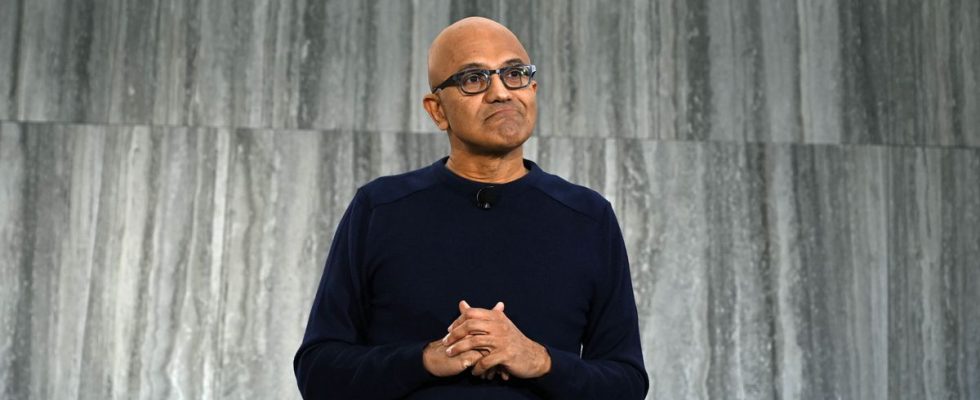

- Satya Nadella, CEO von Microsoft, sprach mit NBC Nightly News über das Auftauchen KI-generierter gefälschter Bilder von Taylor Swift, die Swift auf sexuelle Weise darstellen.

- Nadella nannte die Situation „alarmierend und schrecklich“ und sagte, Microsoft und andere müssten handeln.

- In einem Bericht wird behauptet, dass Microsoft Designer zum Erstellen der Bilder von Taylor Swift verwendet wurde, diese Information wird jedoch nicht bestätigt.

KI-generierte Bilder von Taylor Swift sind kürzlich online aufgetaucht. Der sexuelle Charakter der gefälschten Fotos löste Konflikte und Debatten über den Einsatz künstlicher Intelligenz zur Erstellung von Bildern von Menschen ohne Einwilligung aus. Die Tatsache, dass der generierte Inhalt sexuell explizit war, machte die Diskussion noch komplexer.

Satya Nadella, CEO von Microsoft, hat die Situation in einem Interview mit NBC Nightly News besprochen und darüber gesprochen, was getan werden kann, um die KI zu steuern und vor Missbrauch zu schützen.

Nadella sagte in seinem Interview, das vollständig am 30. Januar 2024 ausgestrahlt wird, Folgendes: „

„Ich würde zwei Dinge sagen. Erstens komme ich noch einmal auf unsere Verantwortung zurück, nämlich auf all die Leitplanken, die wir rund um die Technologie setzen müssen, damit sicherere Inhalte produziert werden. Und Es gibt viel zu tun und es wird dort viel getan. Und das können wir, vor allem wenn es Gesetze, Strafverfolgungs- und Technologieplattformen gibt, die zusammenkommen können. Ich denke, wir können viel mehr regieren, als wir denken – wir geben uns selbst die Ehre für.”

Auf die Frage, ob die gefälschten Bilder von Taylor Swift „die Alarmglocken schrillen lassen“ und was getan werden kann, sagte Nadella: „Zuallererst ist das absolut alarmierend und schrecklich. Und deshalb müssen wir handeln.“

Microsoft ist einer der größten Namen im Bereich KI, und es stellt sich heraus, dass die Tools des Technologieriesen möglicherweise mit den gefälschten Bildern von Taylor Swift in Verbindung stehen. A 404 Medienbericht gibt an, dass Mitglieder der „Telegram-Gruppe, die sich missbräuchlichen Bildern von Frauen widmet“ das KI-gestützte Bilderstellungstool von Microsoft verwendet haben, um die gefälschten Fotos von Swift zu erstellen.

Microsoft hat Bing Image Creator kürzlich von Designer in Image Creator umbenannt. Im 404 Media-Bericht wurde nicht angegeben, welches Tool von Mitgliedern der Telegram-Gruppe verwendet wurde, aber es besteht eine gute Chance, dass es sich um Bing Image Creator/Image Creator von Designer handelte.

Dieses Tool verfügt über Schutzmaßnahmen, um die Erstellung pornografischer Bilder zu verhindern, es gibt jedoch Möglichkeiten, KI-Tools auszutricksen, um Inhalte zu erstellen, die verboten werden sollen.

Was kann Microsoft gegen KI-generierte Pornos tun?

Viele werden sich mit der Frage befassen, ob die Regierung KI-generierte Pornografie regulieren sollte. Auch die Rolle und Verantwortung von Microsoft dürfte ein heißes Diskussionsthema sein. Aber ich möchte mich darauf konzentrieren, was Microsoft tun kann und was bereits in Bezug auf KI-generierte Bilder getan wird.

Wie von Nadella angedeutet, kann Microsoft Leitplanken einführen, die die Arten von Inhalten, die Copilot und andere KI-Tools erstellen können, einschränken oder einschränken. Diese sind bereits vorhanden, können aber natürlich umgangen werden. Menschen schaffen es, KI-Grenzen für alles zu umgehen, von harmlosem Spaß bis hin zur Generierung von Rachepornos. Microsoft kann mehr Schutzmaßnahmen einführen und Beschränkungen verschärfen, aber es besteht eine gute Chance, dass die KI-Tools von Microsoft immer dazu genutzt werden können, Inhalte zu erstellen, die der Technologieriese nicht gutheißen würde.

Es gibt eine größere moralische Diskussion darüber, wer entscheiden darf, was angemessen ist, aber das überlasse ich den Experten.

Auch wenn Microsoft einen Weg gefunden hat, seine Tools daran zu hindern, Pornografie oder andere kontroverse Bilder zu generieren, stehen andere KI-Tools zur Verfügung. Webbasierte KI-Tools wie Copilot von Microsoft und Bard von Google sind einfach zu verwenden, aber sie sind bei weitem nicht die einzigen Tools für künstliche Intelligenz, die es gibt.

Was kann Microsoft also tun, um Benutzern dabei zu helfen, echte Bilder von gefälschten Fotos zu unterscheiden? Der Technologieriese kann bei der Entwicklung einer Technologie helfen, die KI-generierte Bilder identifiziert. OpenAI arbeitet an einem Tool, das angeblich KI-generierte Bilder mit einer Zuverlässigkeit von 99 % identifizieren kann.

Einige Social-Media-Seiten verwenden bereits ähnliche Tools, um nach sensiblen Bildern zu suchen, die dann gemeldet werden. Natürlich sind diese Tools auch nicht perfekt, da X (ehemals Twitter) Schwierigkeiten hatte, die Verbreitung der gefälschten Bilder von Taylor Swift zu verhindern.