Apple Vision Pro steht kurz vor der Markteinführung und die Konkurrenz um das Gerät nimmt zu. Von der Meta Quest 3, die ein ähnliches Erlebnis zu einem günstigeren Preis bietet, bis hin zur Xreal Air 2, die Software verwendet, um Ihnen in ihrer Standard-AR-Brille räumliche Berechnungen zu ermöglichen, stehen Unternehmen Schlange, um es mit Cupertino aufzunehmen.

Und jetzt stehen zwei weitere Unternehmen mit großen Ideen an der Reihe. Von Patently Apple berichtet, Google verwendet seine Radartechnologie aus dem Pixel 4 wieder als bahnbrechende Methode zur Erkennung von Handgesten und Samsung hat zwei neue Bildsensoren entwickelt die Eingaben und Tiefenerkennung drastisch verbessern.

Zurück zum Radar

Einige der erfolgreichsten Gadgets kommen von Unternehmen, die alte Technik aus schlechten Geräten übernehmen und sie auf weitaus bessere Weise wiederverwenden. Durch die Rückkehr der „Soli“-Radarlösung von Pixel 4 zur Verwendung in einem XR-Headset liegt Google meiner Meinung nach auf der richtigen Spur.

Die Methode des Apple Vision Pro zur Verfolgung von Handgesten ist im Prinzip eher einfach: Stecken Sie eine Menge Kameras in die Unterseite, um zu sehen, was Sie tun, und machen Sie Feierabend. Ja, ich weiß, dass im Hintergrund eine Menge Softwarearbeit und Berechnungen stattfinden, damit dies funktioniert, aber das passiert auf Hardwareebene.

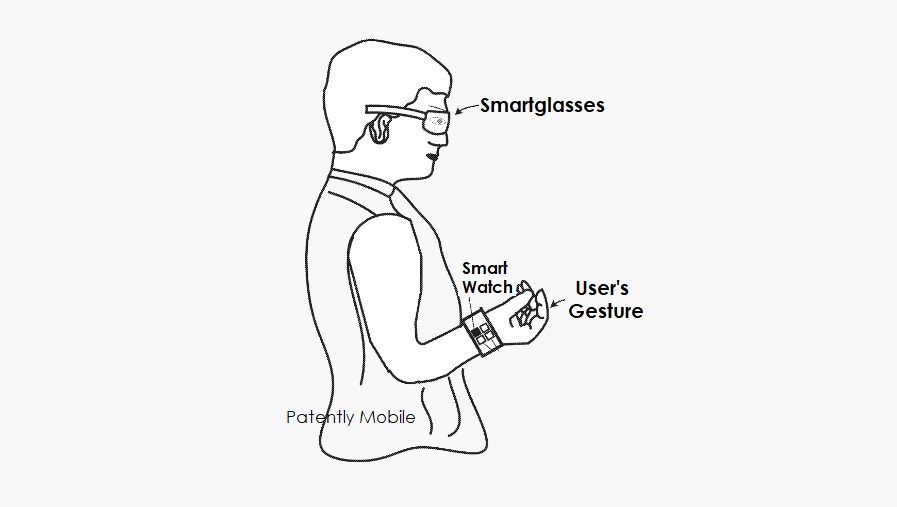

Das jüngste Patent von Google zeigt eine Neuerfindung der Methode, dies zu erreichen, indem dieselbe Radartechnologie, die dem Pixel 4 all seine seltsamen berührungslosen Gestensteuerungen verliehen hat, in eine Smartwatch integriert wird. Mit diesem Band kann das Headset Gesteneingaben mithilfe des Radars sowie kleinste Bewegungen in Muskeln oder Bändern von bis zu 3 mm lesen.

Was ist der Hauptvorteil, wenn man die ganze Technik am Handgelenk trägt? Dadurch wird die Größe des Headsets selbst drastisch reduziert. Die kräftige Variante von Apple muss über größere Abmessungen verfügen, damit alle darin enthaltenen Kameras und Sensoren Platz finden. Dies könnte die Tragbarkeit des Google-Headsets, das irgendwann im Jahr 2024 oder später auf den Markt kommen könnte, erheblich verbessern.

Dinge anders sehen

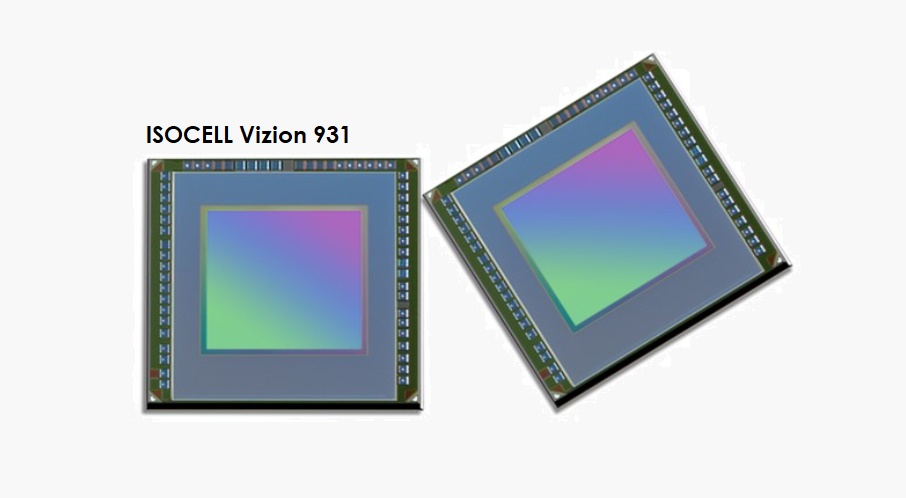

Mittlerweile verfolgt Samsung bei Bildsensoren einen traditionelleren Ansatz und hat einen neuen Sensortyp erfunden, um seine Bemühungen um XR-Headsets der nächsten Generation zu unterstützen. Insbesondere die ISOCELL-Version 931, ein neuer Sensor, der wie das menschliche Auge funktioniert – mit einem Rolling-Shutter, der alle Pixel gleichzeitig dem Licht aussetzt,

Dadurch kann der Sensor Augen, Gesichtsausdrücke und Handgesten genau verfolgen und sogar die Iris zur Gerätesicherheit erkennen. Das ist jedoch noch nicht alles, denn Samsung hat auch den ISOCELL Vizion 63D vorgestellt, der ähnlich funktioniert, wie Fledermäuse im Dunkeln navigieren – mit einem indirekten Flugzeitsensor, der Entfernung und Tiefe messen kann.

Mit der Kombination dieser Sensoren können Sie davon ausgehen, dass Samsung dem Wettbewerb mit Apple Vision Pro nahe kommt, mit einem iTOF-Sensor, der 3D-Umgebungen für Augmented Reality abbildet und die Sensoren den Stromverbrauch des Systems um bis zu 40 % reduziert.