Forscher der University of California und Intel haben entwickelte einen komplexen Algorithmus Das nutzt KI und einige clevere Routinen, um neue Frames zu extrapolieren, mit angeblich geringerer Eingabelatenz als aktuelle Frame-Generierungsmethoden, und das alles unter Beibehaltung einer guten Bildqualität. Es gibt noch keine Anzeichen dafür, dass Intel plant, das System für seine Arc-GPUs zu implementieren, aber wenn die Arbeit fortgesetzt wird, werden wir wahrscheinlich in naher Zukunft eine Intel-basierte Frame-Generation haben.

Angekündigt auf der diesjährigen Siggraph Asien Veranstaltung in Australien (via Wccftech) wurde eine Gruppe von Forschern der University of California von Intel gesponsert und unterstützt, um ein System zu entwickeln, das künstlich Frames erstellt, um die Leistung von Spielen und anderen Anwendungen, die Rendering durchführen, zu steigern.

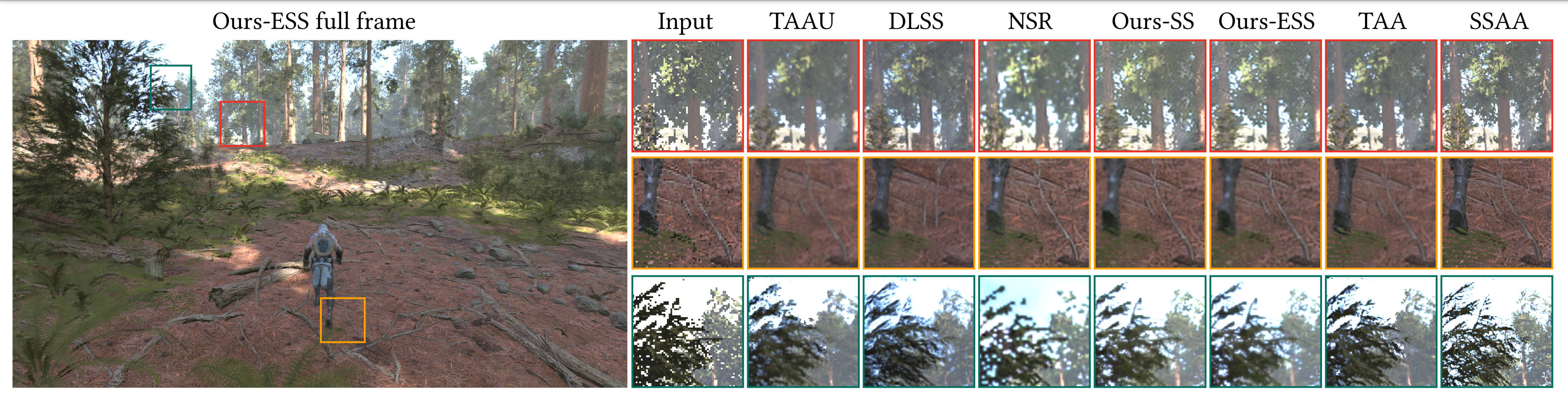

Dies wird allgemein als Frame-Generierung bezeichnet und ist uns allen bekannt, seit Nvidia es im Jahr 2022 in sein DLSS-3-Paket aufgenommen hat. Dieses System verwendet ein Deep-Learning-Neuronales Netzwerk zusammen mit einer ausgefallenen optischen Flussanalyse, um zwei gerenderte Frames zu untersuchen erzeugen ein völlig neues, das dazwischen eingefügt wird. Technisch gesehen handelt es sich hierbei um Frame-Interpolation, die in der Welt der Fernsehgeräte seit Jahren eingesetzt wird.

Anfang dieses Jahres bot uns AMD seine Version der Frame-Generierung in FSR 3 an, aber anstatt sich auf die KI zu verlassen, um die ganze schwere Arbeit zu erledigen, entwickelten die Ingenieure den Mechanismus so, dass er vollständig über Shader funktioniert.

Allerdings haben sowohl AMD als auch Nvidia ein kleines Problem mit ihren Frame-Generierungstechnologien, und zwar durch eine erhöhte Latenz zwischen den Eingaben eines Spielers und deren anschließender Anzeige in Aktion auf dem Bildschirm. Dies liegt daran, dass zwei Vollbilder gerendert werden müssen Erste bevor das interpolierte Bild erzeugt und dann in die Frame-Kette eingefügt werden kann.

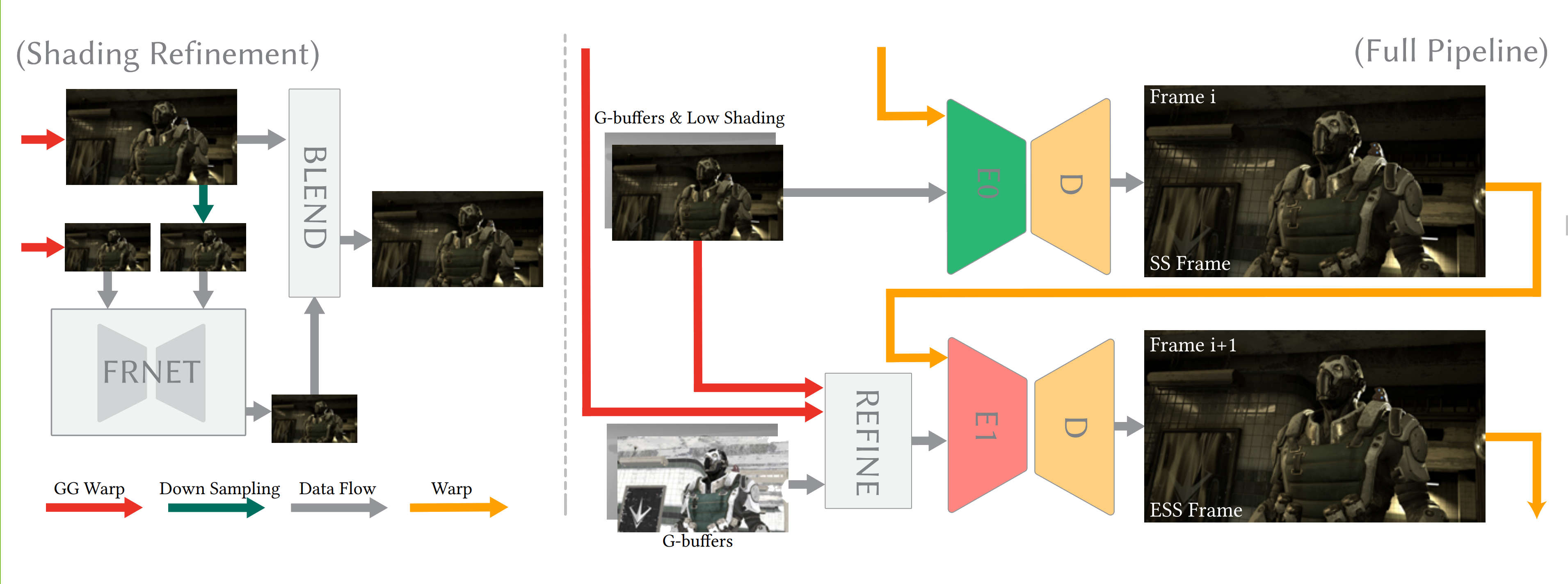

Die von Intel und UoC vorgeschlagene neue Methode ist etwas anders. Erstens ist es so drei Methoden, alle zusammengefasst in einem langen Algorithmus. In der Anfangsphase wird auf die Verwendung von Bewegungsvektoren oder optischen Flussanalysen verzichtet und stattdessen auf eine clevere Mathematik zurückgegriffen, um Geometriepuffer zu untersuchen, die während des Renderns vorheriger Frames erstellt wurden.

In dieser Phase wird ein teilweise vollständiger neuer Frame erstellt, der dann zusammen mit anderen Daten in die nächste Phase des gesamten Prozesses eingespeist wird. Hier wird ein kleines neuronales Netzwerk verwendet, um die fehlenden Teile zu ergänzen. Die Ausgaben der Stufen eins und zwei durchlaufen dann den letzten Schritt, an dem ein weiteres neuronales Netzwerk beteiligt ist.

Es ist alles viel zu komplex, um hier ins Detail zu gehen, aber das Ergebnis ist das Einzige, was zählt: Ein generierter Rahmen extrapoliert aus vorherigen Frames kopiert und eingefügt nach ihnen. Es wird immer noch eine gewisse Eingabelatenz geben, aber theoretisch sollte sie geringer sein als bei den Methoden von AMD und Nvidia, aber echte Frames werden unmittelbar nach dem Rendern angezeigt.

Auch wenn das alles ein wenig zu schön klingt, um wahr zu sein, gibt es bei all dem und seiner Leistung einen bemerkenswerten Vorbehalt. Die Forscher testeten mit einer GeForce RTX 3090, wie lange die Ausführung des Algorithmus dauern würde TensorRT um mit den neuronalen Netzen umzugehen.

Beginnend mit 540p und dem endgültigen generierten Frame mit 1080p dauerte der Vorgang 4,1 Millisekunden. Das ist sehr schnell, obwohl in der Forschungsarbeit auch darauf hingewiesen wird, dass der Algorithmus ab 1080p 13,7 ms benötigte, was einer Leistung von 72 fps entspricht.

An der ganzen Sache wird eindeutig noch mehr Arbeit geleistet und jede Implementierung würde ein zusätzliches System erfordern, um das Tempo der echten und gefälschten Frames zu verwalten, sonst würden die FPS in die Höhe schnellen.

Und wenn Intel es tatsächlich auf den Markt bringt, bedeutet die Tatsache, dass es zwei neuronale Netze betreibt, dass jede GPU mit dedizierter Matrix-Hardware ein klarer Vorteil wäre (also Intel und Nvidia).

Eines ist jedoch sicher: Upscaling und Frame-Generierung werden bleiben und in Zukunft immer wichtiger für die Zusammenarbeit von Grafikkarten und Spielen werden.

Im Moment sind Sie vielleicht kein Fan von ihnen, aber irgendwann wird der Zeitpunkt kommen, an dem Sie sie nicht mehr in Aktion sehen können. Sie werden das Spiel einfach genießen, entweder mit Mega-Grafik oder superhohen Bildraten.