Was du wissen musst

- Der Erfolg von Microsoft und OpenAI hat Google dazu veranlasst, in einem beschleunigten Zeitrahmen im KI-Bereich zu konkurrieren.

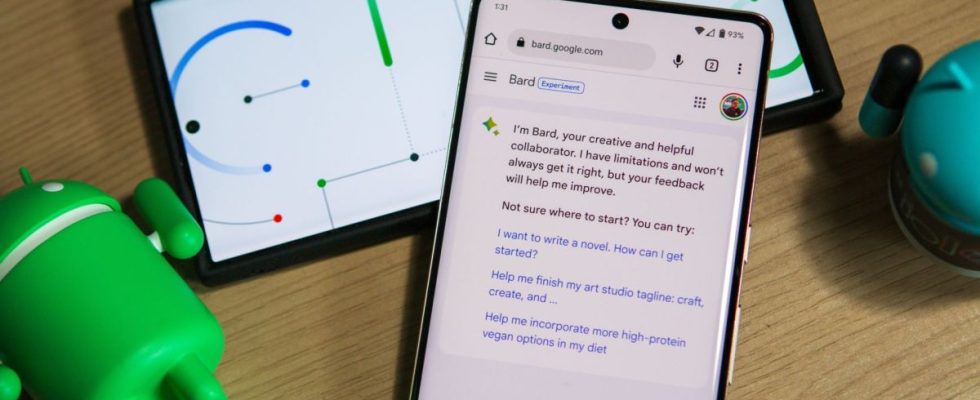

- Google hat kürzlich seinen eigenen KI-Chatbot Bard in der Vorschau gestartet.

- Laut einem Bericht von Bloomberg warnten Mitarbeiter Google davor, dass Bard „schlimmer als nutzlos“ sei und Ratschläge gebe, die „zu schweren Verletzungen oder zum Tod führen könnten“.

Googles Chatbot Bard ist wieder einmal in den Schlagzeilen, aus einem Grund, über den der Technologieriese wahrscheinlich nicht erfreut ist. Laut einem Bericht von Bloomberg, warnten Google-Mitarbeiter den Technologieriesen, dass Bard ein „pathologischer Lügner“ sei. Mehr als nur das Teilen falscher Informationen, die relativ harmlos sein könnten, gab Bard Berichten zufolge Ratschläge, die bei Aktivitäten wie Tauchen und Landen eines Flugzeugs „wahrscheinlich zu schweren Verletzungen oder zum Tod führen würden“.

Bereits im Februar 2023 soll ein Google-Mitarbeiter eine interne Nachricht gesendet haben, die lautete: „Bard ist schlimmer als nutzlos: Bitte nicht starten.“ Fast 7.000 Menschen sollen diese Botschaft gesehen haben, von denen viele ihrer Meinung zustimmten.

Jen Gennai, Leiterin der KI-Governance bei Google, hat laut Bloomberg im März eine Risikobewertung ihres Teams außer Kraft gesetzt. Bard wurde kurz darauf in der Vorschau der Öffentlichkeit vorgestellt.

Dem Bericht zufolge wurde Gennais Entscheidung in Zusammenarbeit mit einer Gruppe hochrangiger Führungskräfte getroffen, die “feststellten, dass es angemessen sei, einen begrenzten experimentellen Start mit fortgesetzter Vorschulung, verbesserten Leitplanken und angemessenen Haftungsausschlüssen voranzutreiben”.

Das beschleunigte Tempo von Google im KI-Rennen ist zumindest teilweise auf die Veröffentlichung von ChatGPT durch OpenAI und die Integration von KI in Dienste wie Bing durch Microsoft zurückzuführen. Im vergangenen Dezember hat Googles oberste Führung Berichten zufolge einen „Code Red“ verschickt und seine Bemühungen im Bereich der künstlichen Intelligenz beschleunigt. Dieser Kurswechsel erforderte von Google einige Kompromisse in Sachen Ethik.

Berichten zufolge sagte Gennai, dass Google, wenn es um „Fairness“ geht, „bei 80, 85 Prozent oder so liegen könnte“. Diese Zahlen beziehen sich auf einen Schwellenwert, den Google-Produkte erreichen müssen, bevor sie veröffentlicht werden. Einige Produkte, wie zum Beispiel die zur Kindersicherheit, müssen eine 100-%-Schwelle erreichen.

Google sagte gegenüber Bloomberg bezüglich Bard Folgendes:

„Wir investieren weiterhin in die Teams, die daran arbeiten, unsere KI-Prinzipien auf unsere Technologie anzuwenden.“