ChatGPT ist bereits ein beeindruckendes Tool, wenn Sie wissen, wie man es benutzt, aber es wird bald mit der Einführung von GPT-4 ein bedeutendes Upgrade erhalten.

Derzeit läuft die kostenlose Vorschau von ChatGPT, die die meisten Leute verwenden, auf dem GPT-3.5-Modell von OpenAI. Mit diesem Modell wurde der Chatbot überaus beliebt, und obwohl es einige bemerkenswerte Mängel gab, musste jeder Nachfolger eine Menge erfüllen.

Und dieser Nachfolger ist jetzt da, obwohl OpenAI nicht nur die Schleusen öffnen wird. OpenAI (öffnet in neuem Tab) kündigte GPT-4 auf seiner Website an und es heißt, dass GPT-4 zuerst für ChatGPT Plus-Abonnenten und Entwickler verfügbar sein wird, die die ChatGPT-API verwenden.

Hier ist alles, was wir bisher über GPT-4 und alle angekündigten neuen Funktionen wissen.

Was ist GPT-4?

GPT steht für Generative Pre-Trained Transformer. Dieses neuronale Netzwerk nutzt maschinelles Lernen, um Daten zu interpretieren und Antworten zu generieren, und es ist vor allem das Sprachmodell, das hinter dem beliebten Chatbot ChatGPT steht. GPT-4 ist die neueste Version dieses Modells und ein Upgrade des GPT-3.5-Modells, das die kostenlose Version von ChatGPT unterstützt.

Was ist bei GPT-4 anders?

GPT-3 enthielt über 175 Milliarden Parameter, die die KI berücksichtigen musste, wenn sie auf eine Eingabeaufforderung reagierte, und antwortet immer noch in Sekunden. Es wird allgemein erwartet, dass GPT-4 diese Zahl erhöht, was zu einer genaueren und fokussierteren Reaktion führt. Tatsächlich hat OpenAI bestätigt, dass GPT-4 die Ein- und Ausgabe von bis zu 25.000 Textwörtern verarbeiten kann, mehr als das 8-fache der 3.000 Wörter, die ChatGPT mit GPT-3.5 verarbeiten konnte.

Der andere große Unterschied besteht darin, dass GPT-4 dem GPT-Modell multimodale Funktionalität hinzufügt. Dadurch kann GPT-4 nicht nur Texteingaben, sondern auch Bilder verarbeiten, obwohl es im Moment noch nur in Text antworten kann. Es ist diese Funktionalität, von der Microsoft kürzlich bei einem KI-Event sagte, dass es GPT-4 schließlich ermöglichen könnte, Videoeingaben in das KI-Chatbot-Modell zu verarbeiten.

Diese Upgrades sind besonders relevant für das neue Bing mit ChatGPT, das Microsoft bestätigt (öffnet in neuem Tab) verwendet heimlich GPT-4. Angesichts der Tatsache, dass Suchmaschinen so genau wie möglich sein und Ergebnisse in mehreren Formaten liefern müssen, einschließlich Text, Bilder, Videos und mehr, machen diese Upgrades einen großen Unterschied.

Microsoft hat seine Ambitionen deutlich gemacht, eine multimodale KI zu schaffen. Neben GPT-4, das auf Microsoft Azure-Supercomputern trainiert wurde, hat Microsoft auch an der gearbeitet Visueller ChatGPT Tool, mit dem Benutzer Bilder in ChatGPT hochladen, bearbeiten und generieren können.

Auch Microsoft braucht diese multimodale Funktionalität, um mit der Konkurrenz mithalten zu können. Sowohl die KI-Systeme von Meta als auch Google verfügen bereits über diese Funktion (obwohl sie nicht für die breite Öffentlichkeit verfügbar ist).

Es wurde auch gemunkelt, dass die neueste Iteration des Modells verbesserte Konversationsfähigkeiten hat und menschlicher klingt. Einige haben nach einem kryptischen Tweet von OpenAI-CEO und -Mitbegründer Sam Altman sogar darüber nachgedacht, dass es die erste KI sein wird, die den Turing-Test besteht.

Obwohl OpenAI dies nicht ausdrücklich bestätigt hat, gab es an, dass GPT-4 mit seinen multimodalen Fähigkeiten das 90. Perzentil der Uniform Bar Exam und den 99. Platz bei der Biologie-Olympiade erreicht hat. Beides sind signifikante Verbesserungen gegenüber ChatGPT, das im 10. Perzentil der Anwaltsprüfung und im 31. Perzentil der Biologie-Olympiade abschloss.

Was kann GPT-4?

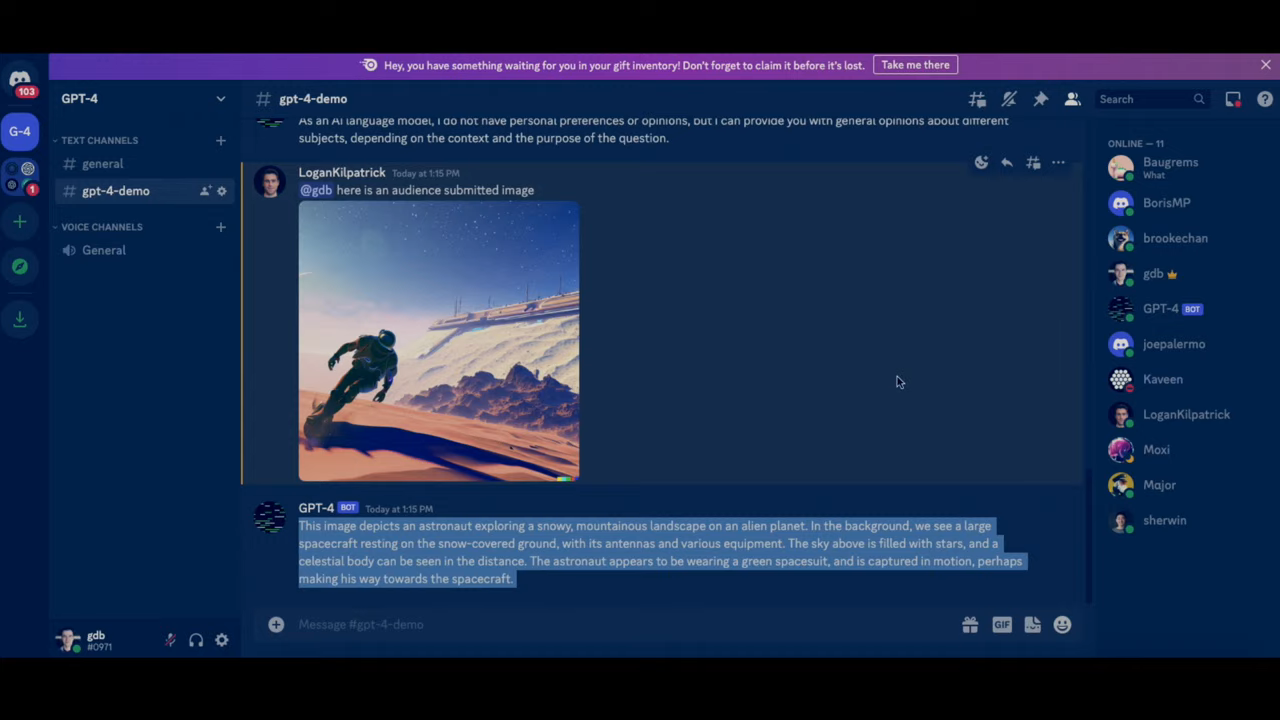

Während eines kürzlichen Entwickler-Livestreams für GPT-4 zeigte Greg Brockman, Präsident und Mitbegründer von OpenAI, einige der neuen Funktionen des aktualisierten Sprachmodells, einschließlich multimodaler Fähigkeiten, bei denen es Kontext für Bilder und sogar die Erstellung von Websites bereitstellt.

In diesem Teil der Demo hat Brockman ein Bild auf Discord hochgeladen und der GPT-4-Bot konnte eine genaue Beschreibung davon liefern. Er bat den Chatbot jedoch auch zu erklären, warum ein Bild eines Eichhörnchens mit einer Kamera lustig sei, worauf er antwortete: „Es ist eine lustige Situation, weil Eichhörnchen normalerweise Nüsse essen, und wir erwarten nicht, dass sie eine Kamera benutzen oder sich wie Menschen verhalten “.

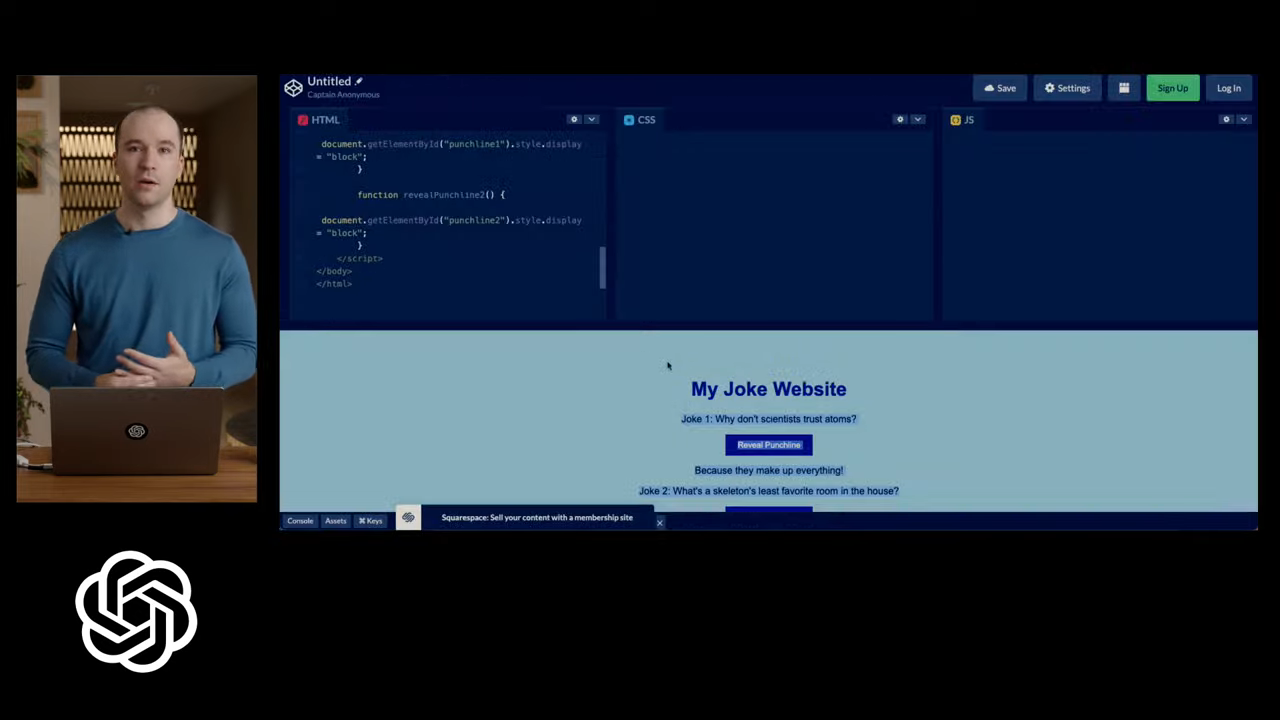

Wenn das genug war, war Brockmans nächste Demo noch beeindruckender. Darin machte er ein Foto von handgeschriebenem Code in einem Notizbuch, lud es auf GPT-4 hoch und ChatGPT konnte dann aus den Inhalten des Bildes eine einfache Website erstellen.

Sobald GPT-4 beginnt, von Entwicklern in der realen Welt getestet zu werden, werden wir wahrscheinlich sehen, dass die neueste Version des Sprachmodells bis an die Grenzen getrieben und für noch kreativere Aufgaben verwendet wird.

Zugriff auf GPT-4

Derzeit gibt es einige Möglichkeiten, auf das GPT-4-Modell zuzugreifen, obwohl sie nicht jedermanns Sache sind.

Wenn Sie das neue Bing mit ChatGPT verwenden, herzlichen Glückwunsch! Sie haben die ganze Zeit heimlich GPT-4 verwendet. Wenn Sie das neue Bing mit seinen KI-Funktionen noch nicht verwendet haben, lesen Sie unbedingt unseren Leitfaden, um sich auf die Warteliste zu setzen, damit Sie frühzeitig darauf zugreifen können. Es scheint auch, dass eine Vielzahl von Einrichtungen, von Duolingo bis zur isländischen Regierung, die GPT-4-API verwendet haben, um ihre bestehenden Produkte zu erweitern.

Abgesehen vom neuen Bing hat OpenAI angekündigt, GPT für ChatGPT Plus-Benutzer und Entwickler, die die API verwenden, verfügbar zu machen. Wenn Sie also mit GPT-4 chatten, müssen Sie dafür bezahlen – vorerst.