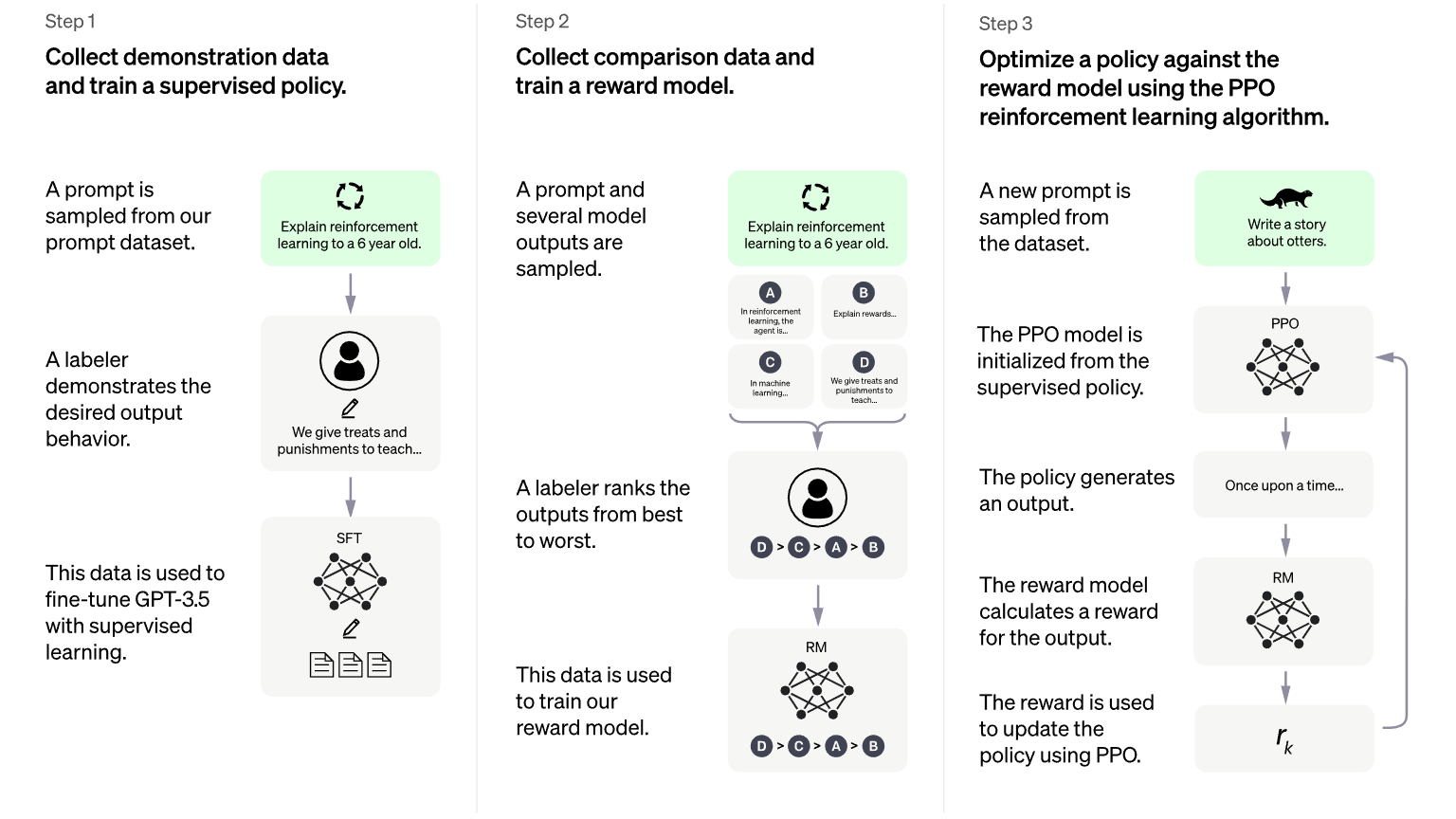

ChatGPT hat Millionen mit seiner Fähigkeit beeindruckt, kohärente, manchmal sogar genaue Sätze, Klappentexte, Skripte und mehr aneinanderzureihen. Um wie ein Mensch zu schreiben, wurde der KI-Bot mit maschinellen Lernalgorithmen auf einem riesigen Katalog von Material trainiert, das aus dem Internet durchforstet wurde. Aber die Entwicklung von ChatGPT war nicht vollständig automatisiert: Es war menschliche Arbeit erforderlich, um zu verhindern, dass ChatGPT in die gleiche Falle tappte wie sein Vorgänger GPT-3, der in der Lage war, unangemessene, manchmal sogar rassistisch (öffnet in neuem Tab)Bemerkungen.

Laut einer aktuellen Untersuchung durch die Zeit (öffnet in neuem Tab)hat der ChatGPT-Erfinder OpenAI diese unappetitliche Datenverarbeitungsaufgabe an kenianische Arbeiter ausgelagert, von denen viele Berichten zufolge weniger als 2 US-Dollar pro Stunde verdienen.

ChatGPT wird auf Datensätze von solch immenser Größe trainiert, dass sie nicht genau von Hand kuratiert werden können, ebenso wie Bilderzeugungstools wie DALL-E (ebenfalls von OpenAI betrieben), Stable Diffusion und Midjourney. Ohne Training würde ChatGPT überhaupt nicht funktionieren, aber nicht alle Texte, die Sie im Internet finden, führen zu der Art von Kommentaren, die Ihr KI-Bot machen soll.

Die ausgelagerte Arbeit umfasste die Kennzeichnung von Beispielen für anstößige Texte, die im Schulungsmaterial auftauchen könnten. Eine Sammlung dieser markierten Textbeispiele wurde dann in eine andere KI eingespeist und darauf trainiert, ähnlichen anstößigen Text aus den Antworten von ChatGPT an Benutzer zu erkennen und zu entfernen.

Das Training der KI, um unangemessene Sprache und Themen zu vermeiden, hält ChatGPT sauberer und macht es schwieriger, störende Inhalte zu produzieren. Aber in diesem Versuch, den Bot zu verbessern, setzte OpenAI schlecht bezahlte Arbeiter in Kenia einigen der schlimmsten Materialien im Internet aus.

„Um diese Labels zu erhalten, hat OpenAI ab November 2021 Zehntausende von Textschnipseln an eine Outsourcing-Firma in Kenia gesendet“, berichtet Time. „Ein Großteil dieses Textes schien aus den dunkelsten Winkeln des Internets entnommen worden zu sein. Einiges davon beschrieb Situationen in anschaulichen Details wie sexuellen Missbrauch von Kindern, Sodomie, Mord, Selbstmord, Folter, Selbstverletzung und Inzest.“

Der Time-Bericht besagt, dass ein Arbeiter aufgrund der Inhalte, denen er bei der Arbeit begegnete, unter wiederkehrenden Visionen litt. Alle vier Arbeiter, mit denen Time sprach, sagten, sie seien „geistig gezeichnet von der Arbeit“.

Berichten zufolge waren rund 36 Mitarbeiter beschäftigt, um die Aufgabe im Auftrag von OpenAI auszuführen, von denen jeder erwartete, „zwischen 150 und 250 Textpassagen pro Neun-Stunden-Schicht zu lesen und zu beschriften“.

Das für die Auslagerung verantwortliche Unternehmen heißt Sama, eine in San Francisco ansässige Firma mit Mitarbeitern in Kenia, Uganda und Indien. Time berichtet, dass OpenAI Ende 2021 drei Verträge für die Kennzeichnungsarbeiten im Gesamtwert von rund 200.000 US-Dollar unterzeichnet hat.

Sama sagt, dass seine Mitarbeiter jederzeit Zugang zu Einzel- und Gruppensitzungen mit professionellen Psychotherapeuten hatten. Die Mitarbeiter, mit denen Time gesprochen hat, sagen jedoch, dass ihnen nur Gruppensitzungen zur Verfügung standen.

„Unsere Mission ist es, sicherzustellen, dass die gesamte Menschheit von künstlicher allgemeiner Intelligenz profitiert, und wir arbeiten hart daran, sichere und nützliche KI-Systeme zu bauen, die Vorurteile und schädliche Inhalte begrenzen“, sagte ein OpenAI-Sprecher gegenüber Time bezüglich der ausgelagerten Datenverarbeitungsarbeit. “Schädliches klassifizieren und filtern [text and images] ist ein notwendiger Schritt, um die Menge an gewalttätigen und sexuellen Inhalten, die in Trainingsdaten enthalten sind, zu minimieren und Tools zu entwickeln, die schädliche Inhalte erkennen können.”

Laut Time nahm die Art von Samas Arbeit für OpenAI im Februar 2022 eine andere Wendung, als sie begann, „sexuelle und gewalttätige Bilder“ zu sammeln, von denen einige in den USA als illegal gelten würden. OpenAI sagte, dass die Kennzeichnung schädlicher Bilder „ein notwendiger Schritt“ sei, um die Verwendung seiner Tools sicher zu machen, aber dass es nie beabsichtigt habe, dass die extremste Kategorie von Bildern von Sama gesammelt werde, und dass dies ein Missverständnis sei.

Sama hat schließlich seinen Vertrag mit OpenAI vorzeitig gekündigt. Der Bericht deutet darauf hin, dass das Sama-Team Bedenken hinsichtlich des Inhalts der Bilder geäußert hat, was schließlich dazu führte, dass der Deal der beiden Unternehmen scheiterte. In der Folge wurden einige der Sama-Arbeiter in niedriger bezahlte Verträge versetzt oder ihre Stellen ganz gekündigt. Die Vollständiger Bericht (öffnet in neuem Tab) geht viel detaillierter auf die Beziehung zwischen OpenAI und Sama ein.

OpenAI wird derzeit in Milliardenhöhe geschätzt. Berichten zufolge sucht Microsoft nach mehr Geld in die KI-Firma steckentrotz seiner eigenen jüngsten Massenentlassungen, und hat Pläne angekündigt, OpenAI-Technologien in seine Dienste zu integrieren.

Moderationsarbeit ist seit langem mit einem gewissen Maß an menschlichem Leid verbunden: A Bericht aus 2019 (öffnet in neuem Tab) zum psychischen Wohlbefinden von Mitarbeitern von Moderationsteams, die von Facebook eingesetzt werden, beschrieb lang anhaltende Traumasymptome als Folge der Arbeit.

Die Kennzeichnungsanforderungen von OpenAI sind auch eine Facette einer größeren ethischen Krise, die im Zentrum der KI-Forschung wächst: das Problem, was als Trainingsmaterial verwendet werden soll. Maschinen können nicht lernen, sich ohne von Menschen gemachtes Material wie Menschen zu verhalten, aber nicht jeder möchte, dass seine Arbeit einem Algorithmus zugeführt wird, und letztes Jahr begannen Künstler, ihre Arbeit als „keine KI“ zu kennzeichnen, um Unternehmen davon abzuhalten, Trainingsdaten zu sammeln für Bildgeneratoren. Hier ist nun das umgekehrte Problem: Material, das Bot-Hersteller nicht ihre KI beeinflussen wollen. Auch hier liegt die Aufgabe, respektvolle KI-Bots aufzuziehen, bei Menschen, in diesem Fall bei Arbeitern, die dafür bezahlt werden, die verstörendsten Inhalte des Internets zu lesen.