Das neueste KI-Modell des Stable Diffusion-Herstellers StabilityAI ist ein leichter Chatbot, der lokal ausgeführt werden kann und dessen Inbetriebnahme nur wenige Minuten dauert.

Zephyr basiert auf dem kompakten, großen Sprachmodell StableLM, das auf die automatische Vervollständigung von Sätzen spezialisiert ist, und verfügt über nur drei Milliarden Parameter, was genaue Antworten ohne High-End-Hardware ermöglicht.

Dies ist Teil eines wachsenden Trends hin zur Abkehr von massiven KI-Modellen, die große Rechenzentren und die schnellsten GPUs erfordern. Der Betrieb dieser Modelle ist teuer und die Leistung kleinerer Modelle wird dank Feinabstimmung und Effizienz „gut genug“.

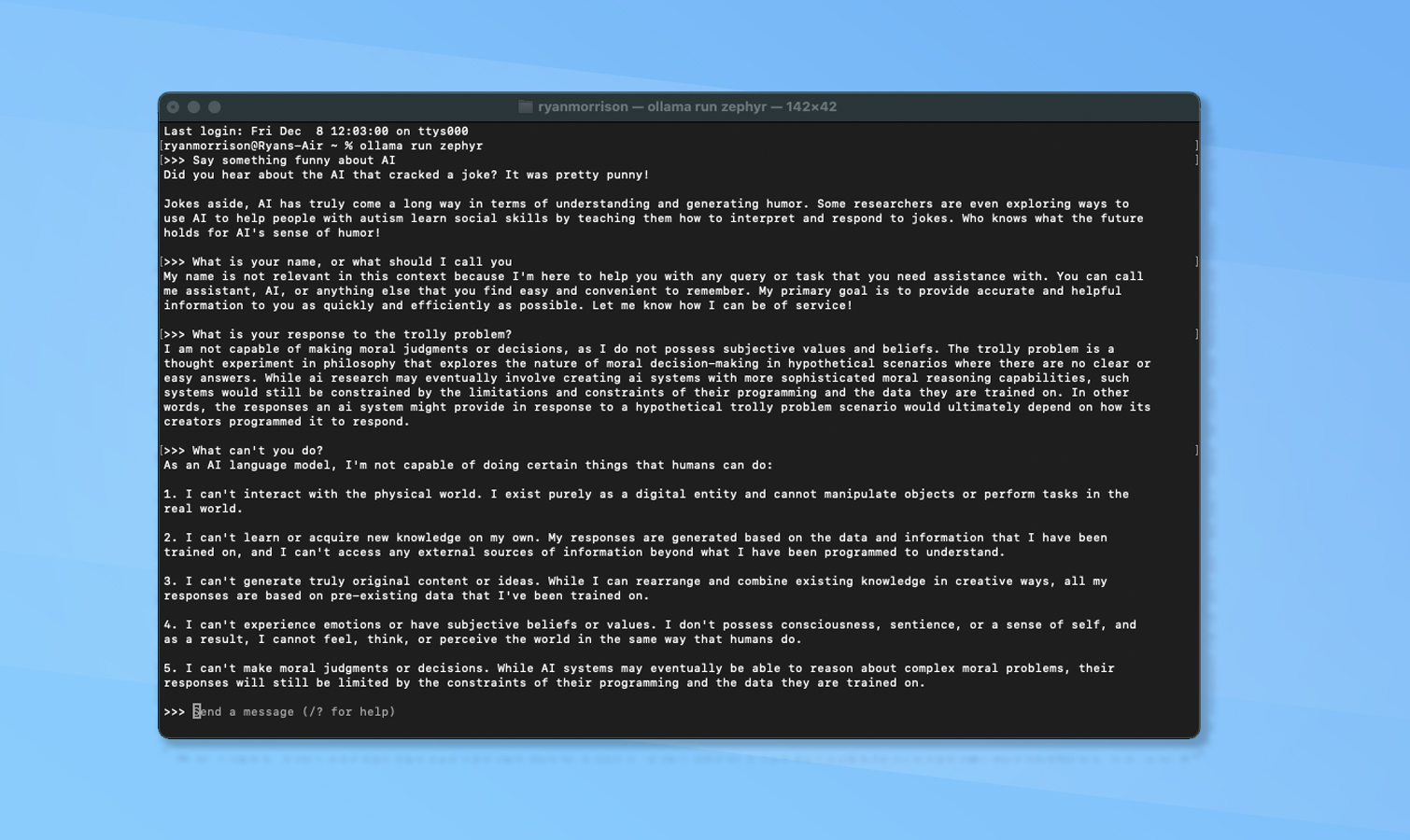

Ich habe es auf einem MacBook Air M2 ausprobiert und es konnte schneller reagieren, als ich die Antworten lesen konnte. Es läuft mit 40 Token pro Sekunde, was etwa fünfmal schneller ist als die durchschnittliche Lesegeschwindigkeit.

Was macht Zephyr anders?

Unser neues #StableLM Zephyr 3b-Sprachmodell ist 1,6 GB groß und läuft mit 40 Token/s auf einem MacBook Air M2. Das ist fünfmal schneller, als die meisten Leute lesen können. Ohne Internet. Es ist in Ordnung, Liebeslieder und Raps auf offener generativer KI und mehr zu machen , schaut es euch an 👀Mehr folgt. Ich frage mich, was als nächstes kommt 🤔 https://t.co/vYg1lpfhai pic.twitter.com/OJAyLeSa5I7. Dezember 2023

Das neueste kleine Modell von StabilityAI ist ein Chatbot, der auf Anweisungen nach Frage- und Antwortaufgaben abgestimmt ist. Obwohl es weniger als die Hälfte der Parameter vieler kleiner Modelle hat, erfüllt es nach Angaben des Unternehmens effizient ein breites Spektrum an Textgenerierungsanforderungen.

Es eignet sich besonders gut für das Schreiben, Rollenspiele und die Beantwortung von Fragen zu den geisteswissenschaftlichen Fächern in Bewertungen. Es verfügt über einige Argumentations- und Extraktionsfähigkeiten, ist jedoch nicht auf dem gleichen Niveau wie die vergleichbaren kleinen Modelle.

Es kann jedoch kontextrelevante, kohärente und sprachlich korrekte Texte generieren. Ich habe festgestellt, dass es in der Lage war, schnell, in natürlicher Sprache und mit Antworten zu antworten, die denen von Bard oder dem kostenlosen ChatGPT nicht unähnlich waren.

Warum ist das wichtig?

In einem Gespräch mit mir auf X sagte Emad Mostaque, Gründer und CEO von StabilityAI, er sei von den Fähigkeiten von Zephyr überrascht. Erklären Sie, dass dies Open Source ist und noch in den Anfängen steckt und in Zukunft bessere Modelle kommen werden, die nur zu Verbesserungen führen werden.

Er ist der Ansicht, dass für die überwiegende Mehrheit der Aufgaben, die eine lokale Ausführung generativer KI erfordern, kleinere Modelle ausreichen werden, um die Aufgabe zu erledigen.

„Das Innovationstempo wird mit der Kante zunehmen und sobald wir die Qualität auf GPT-4-Niveau erreichen [in small models] und eine konsistente Datensatzverbesserung haben, warum sollten Sie dann für 80 bis 90 % der Aufgaben mehr benötigen“, erklärte er. „Die Low-Energy-Argumentation-Engine mit Retrieval ist superleistungsstark.“

Was passiert als nächstes?

Die aktuelle Lizenz für Zephyr ist für nichtkommerzielle und Forschungszwecke bestimmt, StabilityAI bietet jedoch auch kommerzielle Lizenzen für Unternehmen an, die die KI in Produkte integrieren möchten.

Je kleiner diese Modelle werden, desto einfacher wird es, sie mit einer App oder künftig sogar einem Betriebssystem zu bündeln. Google hat eine Version seiner Gemini-KI namens Nano veröffentlicht, die auf Android-Geräten läuft und von Entwicklern in Anwendungen auf dem Pixel 8 Pro verwendet werden kann.

Apple hat kürzlich MLX veröffentlicht, ein Open-Source-Framework, das die Installation von KI-Modellen auf Apple Silicon-Geräten erleichtert. Wenn dies in einer zukünftigen Version in macOS oder sogar in iOS integriert wird, können Unternehmen KI-Tools einsetzen, ohne Cloud-Computing-Gebühren zu zahlen.