Die Space-Zoom-Funktion von Samsung für Galaxy-Handys wurde diese Woche erneut unter die Lupe genommen (oder vielleicht das Teleskop), nachdem in einem Reddit-Beitrag behauptet wurde, dass der Softwareprozess die Herstellung zusätzlicher Details beinhaltet. Samsung hat nun auf die Vorwürfe reagiert und die Behauptungen in Form eines offiziellen Zitats neu bestritten Blogeintrag (öffnet in neuem Tab).

Wir haben Samsung direkt gefragt, ob Mondfotos, die mit Telefonen wie dem Samsung Galaxy S23 Ultra aufgenommen wurden, die Überlagerung zusätzlicher Details oder Texturen beinhalten, die auf den Originalfotos nicht vorhanden sind. In einer offiziellen Erklärung sagte Samsung: „Wenn ein Benutzer ein Foto vom Mond aufnimmt, erkennt die KI-basierte Szenenoptimierungstechnologie den Mond als Hauptobjekt und macht mehrere Aufnahmen für die Multi-Frame-Komposition, wonach die KI die Details verbessert die Bildqualität und die Farben. Es werden keine Bildüberlagerungen auf das Foto angewendet”.

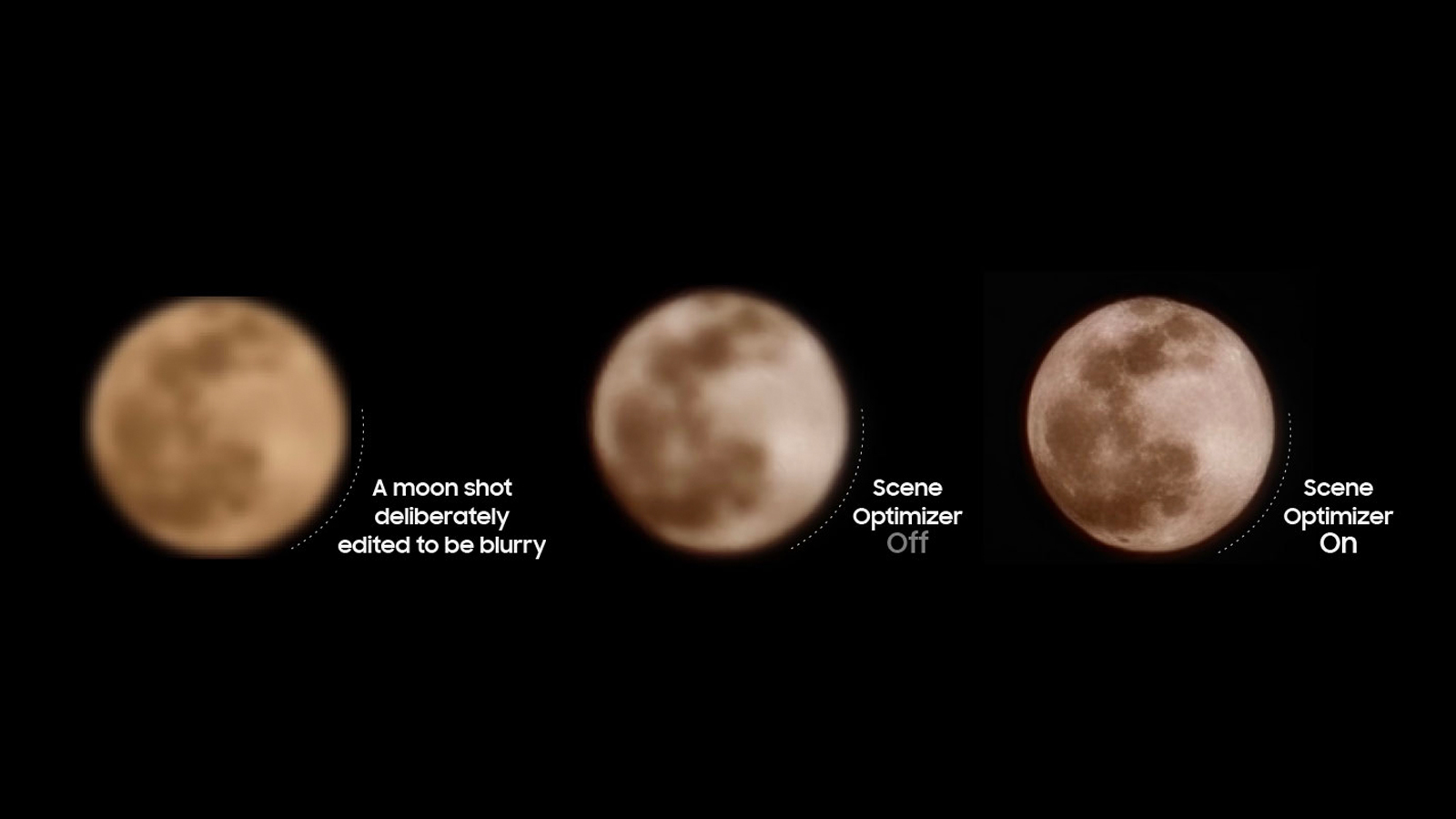

Samsung fügte hinzu, dass dieser Vorgang nicht obligatorisch ist, und erklärte, dass „Benutzer den AI-basierten Scene Optimizer deaktivieren können, wodurch automatische Detailverbesserungen für alle aufgenommenen Fotos deaktiviert werden“. Dadurch wird es jedoch unmöglich, die Art von Ergebnissen zu erzielen, die möglich sind, wenn die Szenenoptimierung aktiviert ist, da die Funktion weit über das Anpassen der Belichtung hinausgeht.

Diese Kommentare spiegeln wider, was Samsung zuvor über seine Space Zoom-Mondaufnahmen gesagt hat, die in ein neues Format umformatiert wurden Blogeintrag (öffnet in neuem Tab) das ist ähnlich dem, das wir zuvor auf a gesehen haben Samsung-Community-Board (öffnet in neuem Tab).

Der Beitrag wiederholt, dass die Mondaufnahmen auf „auf Deep Learning basierender KI-Technologie“ basieren, dass dies jedoch verwendet wird, um „verbleibendes Rauschen zu beseitigen und die Bilddetails zu verbessern“, anstatt zusätzliche Details zu kopieren und einzufügen, die nicht von der Kamera erfasst werden. Interessanterweise bezeichnet Samsung die Ergebnisse mehrmals als “Bilder vom Mond” und nicht als Fotos, was auf die künstliche Natur der Verarbeitung hinweist.

Nur eine weitere verrückte Mondaufnahme mit dem Samsung Galaxy S23 Ultra. Kein Stativ, nicht einmal Space Zoom in voller Stärke. #SamsungGalaxyS23Ultra pic.twitter.com/PFngh8vcBE5. März 2023

Wo bleibt uns das also? Die langweilige Antwort ist, dass sich die gesamte Fotografie auf einer gleitenden Skala zwischen der sogenannten „echten“ Art – Photonen, die auf einen Kamerasensor treffen und in ein elektrisches Signal umgewandelt werden – und der „falschen“ Art befindet, die Samsung in diesem Zusammenhang erneut vorgeworfen wird neuste Kontroverse.

KI-gestützte Modi wie der neueste Scene Optimizer von Samsung, der seit dem Samsung Galaxy S21 Mondaufnahmen wie die folgende produziert, treiben die Fotografie zweifellos in Richtung des künstlicheren Endes dieser Skala. Das liegt daran, dass es Multi-Frame-Synthese, Deep Learning und das, was Samsung auf mysteriöse Weise als „Detail Improvement Engine“ bezeichnet, verwendet, um die beeindruckenden Endergebnisse zu erzielen.

Wir wissen immer noch nicht genau, was in dieser Engine passiert, und man kann mit Fug und Recht sagen, dass zusätzliche Monddetails aus den sehr begrenzten Informationen heraufbeschworen werden, die von der Kamera Ihrer Galaxie erfasst werden. Samsung bestreitet jedoch immer noch, dass dieses Detail einfach auf Space Zoom-Mondfotos angewendet oder überlagert wird.

Bezeichnenderweise nickt Samsung am Ende seines Blog-Beitrags der Reddit-Kontroverse zu, in der es heißt, dass „es den Scene Optimizer weiter verbessert, um mögliche Verwirrungen zu reduzieren, die zwischen dem Fotografieren des echten Mondes und einem Bild des Mondes“.

Analyse: eine Debatte mit verschwommenen Rändern

Die Antwort von Samsung ist nicht detailliert genug, um die Debatte darüber zu beenden, ob seine Space Zoom-Fotos „gefälscht“ sind oder nicht, da dies wirklich Ansichtssache ist. Aber es widerspricht dem Vorschlag, dass es einfach zusätzliche Details und Texturen massenhaft über Ihre Aufnahmen schlägt.

Das Problem bei der Debatte ist, dass jedes digitale Foto – selbst eine Rohdatei – eine Art Fälschung ist. Während des Demosaicing-Prozesses, wenn die Rot-, Grün- und Blauwerte der Pixel eines Sensors erstellt werden, errät ein Prozess namens Interpolation einfach den wahrscheinlichsten Wert benachbarter Pixel.

Sobald Sie der Mischung Multi-Frame-Verarbeitung und KI-Schärfung hinzufügen, ist klar, dass jedes Foto zu einem großen Teil künstlich ist (und auf Vermutungen basiert). Aber die Frage, die diese Debatte aufwirft, ist, ob Samsungs Handys sich an den Punkt bewegt haben, an dem einige seiner Fotos – insbesondere seine Mondaufnahmen – sich vollständig vom Akt des Einfangens von Photonen gelöst haben.

Das ist eine Debatte, die wahrscheinlich nie beigelegt werden wird. KI-Algorithmen füllen Details basierend auf Mustern aus, die sie sehen, wenn sie auf einem riesigen Datensatz ähnlicher Fotos trainiert werden, aber Samsung sagt, dass es kein vorheriges Bild des Mondes abruft, um es über Ihre verschwommenen Aufnahmen zu legen. Ob dieser Vorgang für Sie akzeptabel ist oder nicht, müssen Sie entscheiden, wenn Sie das nächste Mal einen herrlichen Vollmond sehen und nur Ihr Galaxy-Smartphone zur Hand haben.