Nvidia hat gerade auf seiner Computex-Keynote ACE for Games angekündigt, eine Version davon Omniverse Avatar Cloud Engineum NPCs im Spiel in Echtzeit zu animieren und ihnen eine Stimme zu geben.

CEO Jensen Huang erklärte, dass ACE for Games Text-to-Speech, natürliches Sprachverständnis – oder in Huangs Worten „im Grunde ein großes Sprachmodell“ – und automatische Gesichtsanimation integriert. Alles unter dem Dach von ACE.

Im Wesentlichen hört ein von der KI erstellter NPC auf die Eingaben eines Spielers, z. B. wenn er dem NPC eine Frage stellt, und generiert dann eine charakterinterne Antwort, spricht den Dialog laut aus und animiert das Gesicht des NPCs, während er ihn sagt.

Huang demonstrierte die Technologie auch in einer Echtzeit-Demo, die in Unreal Engine 5 mit dem KI-Startup Convai erstellt wurde. Es spielt in einer Cyberpunk-Umgebung, was natürlich der Fall ist (tut mir leid, Katie), und zeigt einen Spieler, wie er einen Ramen-Laden betritt und mit dem Besitzer spricht. Der Besitzer hat keinen Skriptdialog, sondern antwortet in Echtzeit auf die Fragen des Spielers und schickt ihn auf eine provisorische Mission.

Sie können sich die Demo selbst ansehen Hier.

Es ist ziemlich beeindruckend und bietet zweifellos einen Ausblick darauf, wie Spiele diese Technologie in Zukunft nutzen könnten. Wie Huang sagte: „KI wird ein sehr großer Teil der Zukunft von Videospielen sein.“

Natürlich würde er das sagen. Nvidia ist das Unternehmen, das mit dem Verkauf seiner KI-Beschleuniger am meisten vom plötzlichen Anstieg der KI-Nachfrage profitieren wird. Und wir haben bereits einige grundlegende Integrationen von ChatGPT in Spiele gesehen, beispielsweise als Chris es zu seinem Skyrim-Begleiter hinzufügte und es ein einfaches Rätsel nicht lösen konnte. Aber diese neue ACE-Plattform sieht viel ausgefeilter und echtzeitfähig aus.

Was wir nicht wissen, ist, was nötig war, um die ACE for Games-Demo auszuführen, nur dass dort auch Raytracing und DLSS ausgeführt wurden. Es könnte mehr als eine durchschnittliche GeForce-GPU erfordern, um jetzt zu laufen, oder eine cloudbasierte Komponente erforderlich sein. Huang ging etwas zurückhaltend auf die Details ein, aber ich bin mir sicher, dass wir noch mehr über dieses Tool hören werden, da einige Spiele tatsächlich versuchen, es zu nutzen.

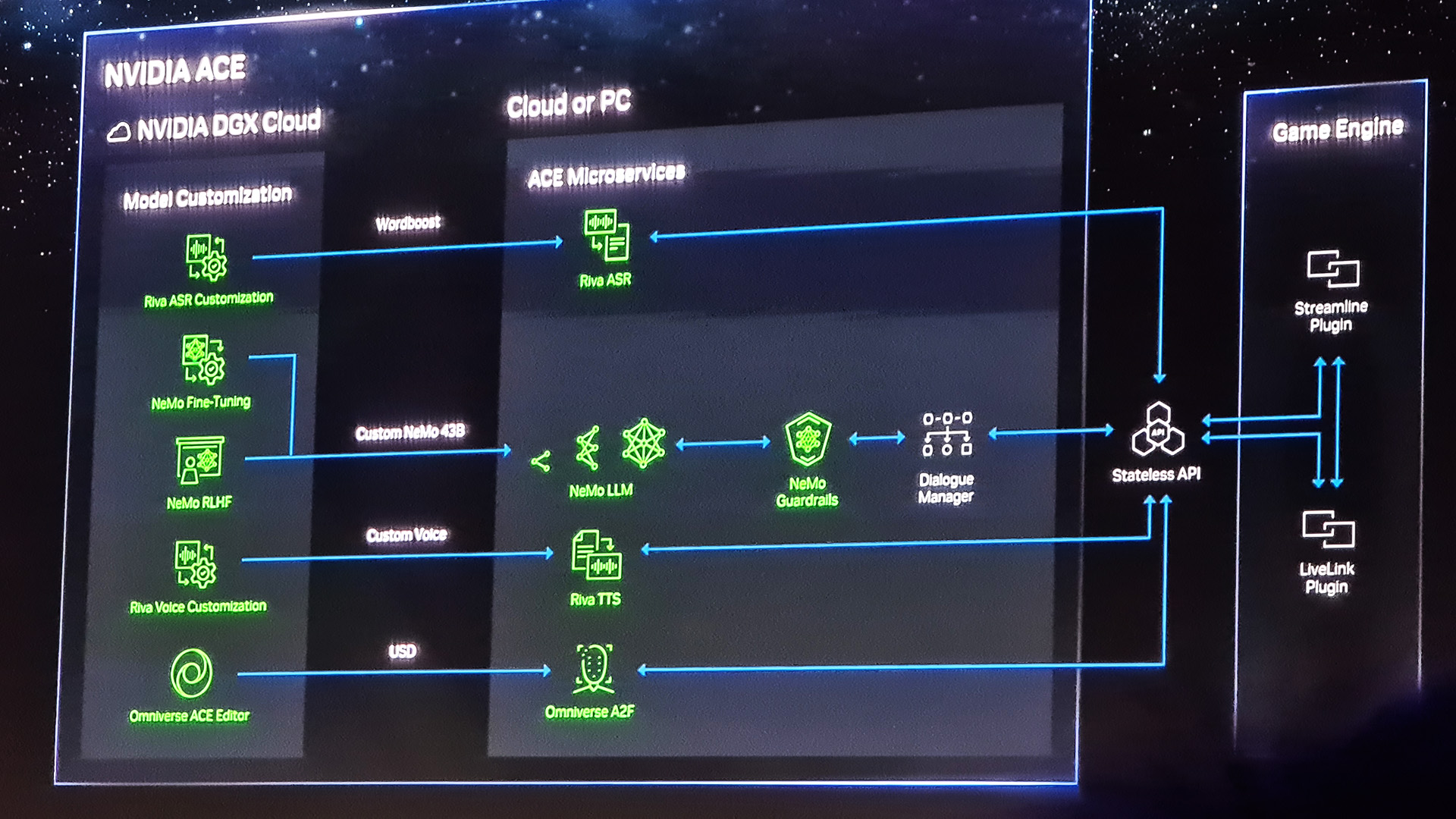

„Die neuronalen Netze, die NVIDIA ACE for Games ermöglichen, sind für unterschiedliche Fähigkeiten optimiert, mit unterschiedlichen Kompromissen bei Größe, Leistung und Qualität. Der ACE for Games-Foundry-Service wird Entwicklern dabei helfen, Modelle für ihre Spiele zu verfeinern und sie dann über NVIDIA DGX Cloud bereitzustellen.“ GeForce RTX-PCs oder vor Ort für Echtzeit-Inferenzen“, sagt Nvidia.

„Die Modelle sind auf Latenz optimiert – eine entscheidende Voraussetzung für immersive, reaktionsschnelle Interaktionen in Spielen.“

Die Latenz wird hier ein großes Problem sein. Ich würde es hassen, dem NPC-Äquivalent einer unangenehmen Pause ausgesetzt zu sein, während die Antwort aus der Cloud geladen wird.

Bisher hat Nvidia zwei Spiele bestätigt, die die Gesichtsanimationstechnologiekomponente von ACE for Games namens Audio2Face verwenden. Das sind STALKER 2: Heart of Chernobyl und Fallen Leaf, aber hoffentlich bekommen wir einige Beispiele der gesamten Plattform zusammen. Ich würde die Technologie gerne außerhalb einer Demo in Aktion sehen.