Die Einführungsveranstaltung von AMD für seine neue KI-Plattform MI300X wurde von einigen der größten Namen der Branche unterstützt, darunter Microsoft, Meta, OpenAI und viele mehr. Diese großen Drei sagten alle, sie hätten vor, den Chip zu verwenden.

AMDs CEO Lisa Su hat den MI300X vergrößert, und beschreibt ihn als den komplexesten Chip, den das Unternehmen jemals produziert hat. Insgesamt enthält es 153 Milliarden Transistoren, deutlich mehr als die 80 Milliarden von Nvidias alles erobernder H100-GPU.

Es besteht außerdem aus nicht weniger als 12 Chiplets auf einer Mischung aus 5-nm- und 6-nm-Knoten und verwendet das laut AMD fortschrittlichste Gehäuse der Welt. Die Basisschicht des Chips besteht aus vier großen IO-Chips, darunter Infinity-Cache, PCIe Gen 5, HBM-Schnittstellen und Infinity Fabric. Hinzu kommen acht CDNA 3-Beschleuniger-Chiplets oder „XCDs“ für insgesamt 1,3 Petaflops reine FP16-Rechenleistung.

Auf beiden Seiten dieser gestapelten Chips befinden sich acht HBM3-Speichermodule für insgesamt 192 GB Speicher. Also, ja, dieses Ding ist ein Monster.

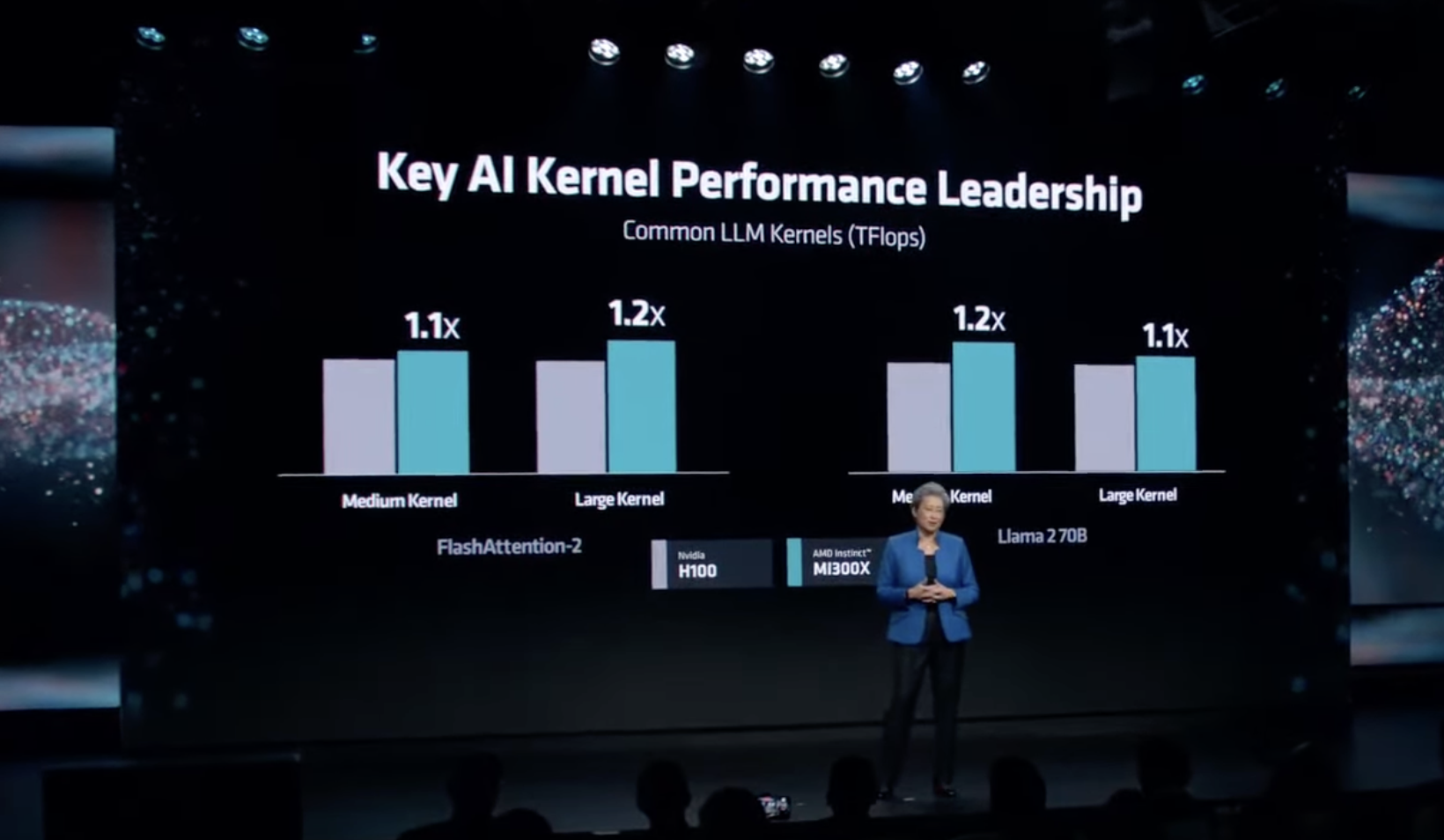

Insgesamt gibt AMD an, dass der MI300X über die 2,4-fache Speicherkapazität, die 1,6-fache Speicherbandbreite und die 1,3-fache reine Rechenleistung des Nvidia H100 verfügt. In tatsächlichen KI-Trainings- und Inferenz-Benchmarks behauptet AMD im Allgemeinen, dass MI300X etwa 1,2-mal schneller als H100 ist.

Solange der MI300X auf der Hardwareseite weitgehend konkurrenzfähig ist, spielen die feineren Details seines Vergleichs wahrscheinlich keine so große Rolle. Denn wohl wichtiger wird der Software-Support sein. Nvidias CUDA-Plattform wird bisher weitaus besser unterstützt als AMDs ROCm, letzterer muss also noch viel beweisen.

Es ist erwähnenswert, dass Nvidia mehr Software-Ingenieure als Hardware-Ingenieure beschäftigt, was Bände darüber aussagt, welchen Wert und welche Bedeutung Nvidia beimisst.

Allerdings hat AMD betont, dass der MI300X aufgrund seines Speicherkapazitätsvorteils viel mehr leisten kann als der H100 von Nvidia. Ein vollständig aufgebauter Serverknoten aus acht MI300X liefert 1,5 TB Speicher gegenüber den 640 GB des entsprechenden Nvidia H100 GHX-Knotens.

Wie erfolgreich der MI300X sein wird, bleibt abzuwarten. Obwohl es offensichtlich vielversprechend ist, dass Unternehmen wie Microsoft, Meta und OpenAI die große KI-Einführung von AMD unterstützen, wissen wir nicht, welche Chips sie jeweils tatsächlich kaufen werden.

Wie wir berichteten, kaufte schätzungsweise allein Microsoft im letzten abgeschlossenen Quartal Nvidia H100-GPUs im Wert von 5 Milliarden Pfund. Was aus dieser Veranstaltung nicht klar hervorgeht, ist, ob Unternehmen wie Microsoft planen, Milliarden für AMD auszugeben, oder ob es bei ihrem Engagement zu diesem Zeitpunkt genauso sehr darum geht, Nvidia mit dem Anschein der Kaufbereitschaft für ein Konkurrenzprodukt auf Trab zu halten, wie es tatsächlich darum geht Kauf wirklich bedeutender Mengen der neuen GPU von AMD.

Ebenso ist AMD bei seinen Umsatzprognosen für den MI300X sehr konservativ. Aber spiegelt das seine wahren Ambitionen wider, oder versucht es, die Erwartungen niedrig zu halten und sie dann zu übertreffen? Beobachten Sie diesen Bereich wie immer.

Was dies alles für PC-Spiele bedeutet, ist ebenso, wenn nicht sogar noch unklarer. Wenn AMD mit KI-Chips ernsthaft Geld verdienen kann, dann ist das theoretisch eine bessere Position, um in Gaming-GPU-Technologie zu investieren. Andererseits könnte es auch die Aufmerksamkeit von AMD ablenken und ihm den Zugang zu hochmodernen Fertigungskapazitäten bei seinem wichtigsten Foundry-Partner TSMC verwehren.

Das alles bedeutet, dass wir einfach abwarten müssen, wie es weitergeht. Generell glauben wir, dass eine gute Leistung von AMD im KI-Bereich für PC-Spieler von Vorteil sein wird, wenn dadurch AMD gesünder und stärker wird. Aber es spielen auch so viele Variablen eine Rolle, dass es ziemlich schwierig ist, sicher zu sein. Wenn Sie mehr erfahren möchten, können Sie dies tun Sehen Sie sich hier die gesamte Auftaktveranstaltung an.