Die Rechenleistung der Welt ist besser damit bedient, Anwendungen für künstliche Intelligenz wie ChatGPT und Google Bard zu entwickeln, als Kryptowährungen zu schürfen. Das ist laut Nvidia, das seine GPUs lieber für Spiele und KI verwenden würde.

Michael Kagan, Chief Technology Officer von Nvidia, hat erklärt, dass das Unternehmen nie Kryptowährungen angenommen und versucht hat, seine RTX-30-Grafikchips einzuschränken, um ihre Verwendung für das Mining einzuschränken.

„All dieses Krypto-Zeug brauchte eine parallele Verarbeitung und [Nvidia] ist das Beste, also haben die Leute es einfach so programmiert, dass es für diesen Zweck verwendet werden kann“, sagte er dem Wächter (öffnet in neuem Tab). „Sie haben eine Menge Zeug gekauft, und dann ist es schließlich zusammengebrochen, weil es nichts Nützliches für die Gesellschaft bringt. KI schon.“

Trotz der Zurückhaltung von Nvidia, mit Krypto-Enthusiasten in Kontakt zu treten, hat sich das Unternehmen zweifellos gut aus dem Bullenmarkt von Bitcoin und Ethereum geschlagen. Aller Wahrscheinlichkeit nach verkaufte es eine ganze Menge GPUs an diejenigen, die digitale Währungen schürfen wollten.

„Das habe ich nie geglaubt [crypto] ist etwas, das der Menschheit etwas Gutes tun wird“, fügte Kagan hinzu. „Weißt du, die Leute machen verrückte Sachen, aber sie kaufen deine Sachen, du verkaufst ihnen Sachen. Aber Sie lenken das Unternehmen nicht um, um zu unterstützen, was auch immer es ist.“

Die Revolution antreiben

Während Kryptowährungen Probleme haben (Ethereum kann nicht mehr abgebaut werden und die Zeit- und Leistungsanforderungen für Bitcoin sind unerschwinglich), ist die KI-Revolution in vollem Gange. Das war gut für Nvidia. Laut UBS-Analyst Timothy Arcuri verwendete OpenAI (das Unternehmen hinter ChatGPT) 10.000 der GPUs des Unternehmens, um das Modell zu trainieren.

Auf die Frage, wie viele Nvidia-GPUs in seiner Entwicklung verwendet wurden, direkt an den Chatbot, gab ChatGPT die folgende Antwort zurück: „Die genaue Anzahl und Art der GPUs, die während meines Schulungsprozesses verwendet wurden, werden nicht öffentlich bekannt gegeben, aber es ist bekannt, dass das OpenAI-Team verwendete eine groß angelegte transformatorbasierte Sprachmodellarchitektur und trainierte mich mit einem riesigen Textdatensatz.“

Derzeit übernehmen Zehntausende von Nvidias A100- und H100-Tensor-Core-GPUs das Training und die Inferenz von KI-Modellen wie ChatGPT, die über den Azure-Clouddienst von Microsoft laufen.

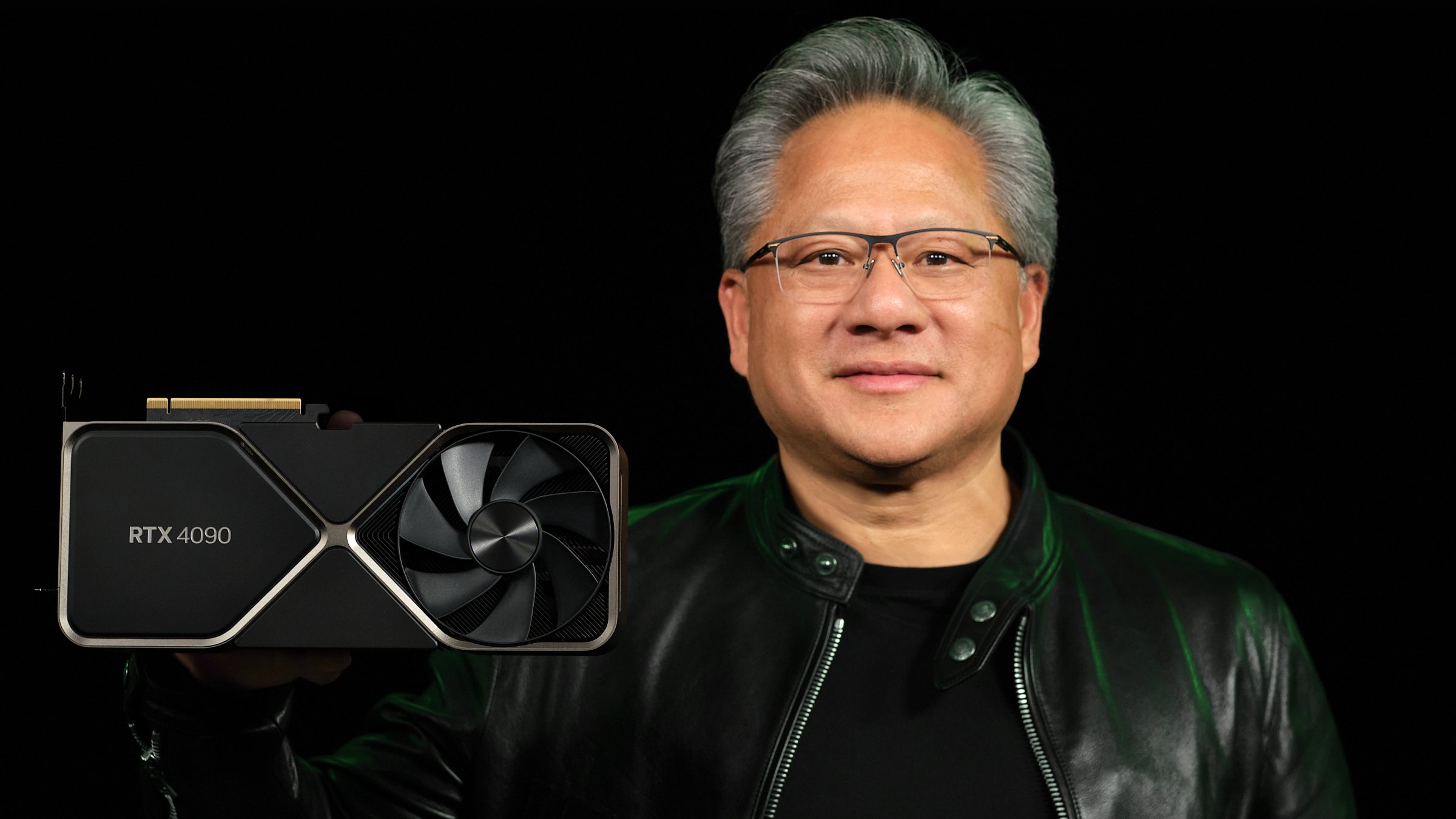

Unterdessen sagte Jensen Huang, CEO von Nvidia, es sei der Motor, der „den iPhone-Moment der KI“ auf der Jahreskonferenz des Unternehmens letzte Woche antreibe.