Was du wissen musst

- Eine Studie von Forschern aus Stanford zeigt einen Leistungsabfall des Chatbots von OpenAI.

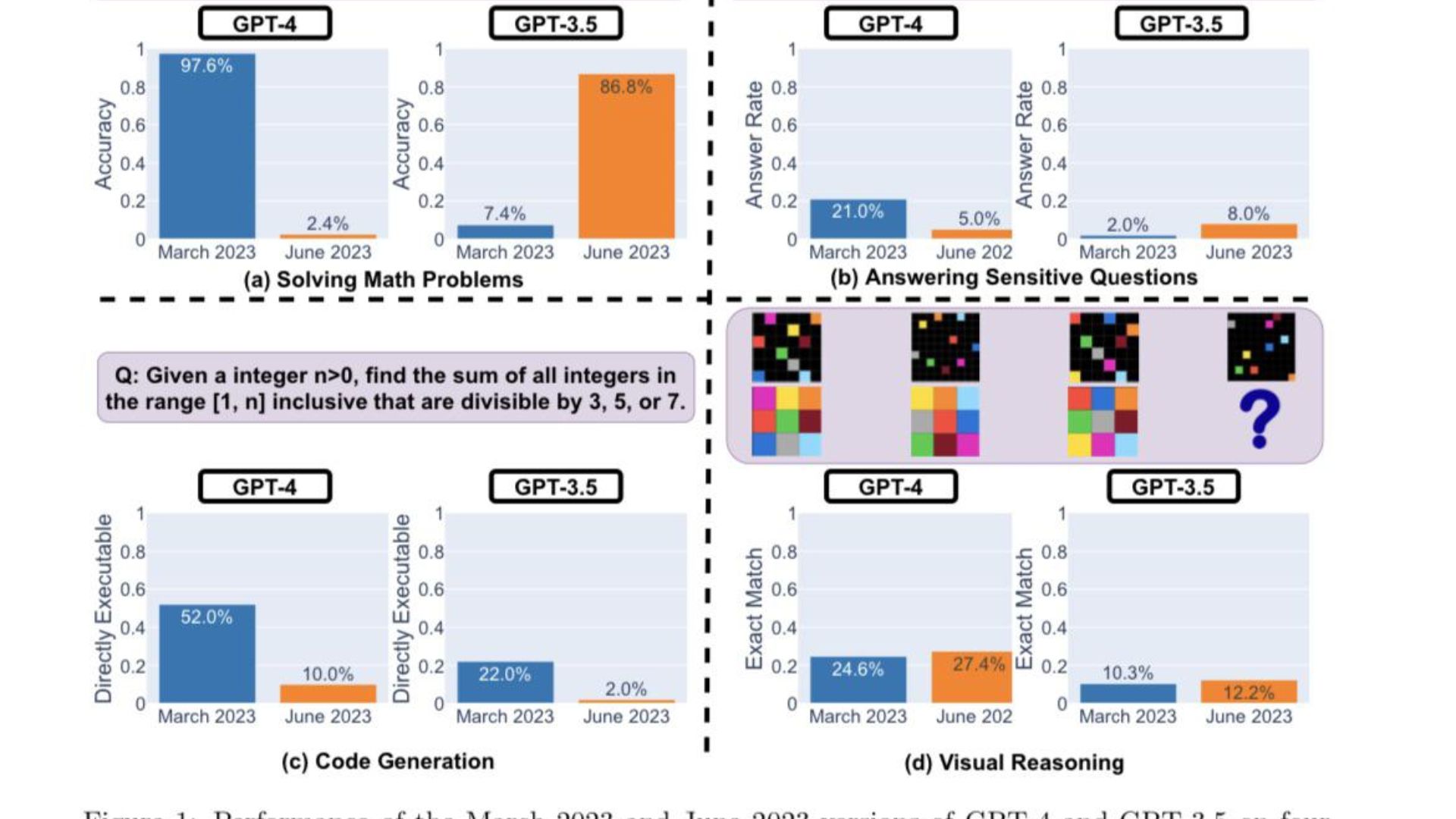

- Die Forscher verwendeten vier wichtige Leistungsindikatoren, um festzustellen, ob GPT-4 und GPT-3.5 besser oder schlechter wurden.

- Beide LLMs zeigen unterschiedliche Leistungen und Verhaltensweisen in verschiedenen Kategorien.

Zu Beginn dieses Jahres öffneten sich die Türen der generativen KI weit und brachten eine neue Realität voller Möglichkeiten hervor. Das neue Bing von Microsoft und ChatGPT von OpenAI standen an vorderster Front, andere Unternehmen folgten diesem Beispiel mit ähnlichen Modellen und Iterationen.

Während OpenAI damit beschäftigt war, neue Updates und Funktionen für seinen KI-gestützten Chatbot bereitzustellen, um dessen Benutzererfahrung zu verbessern, ist eine Gruppe von Forschern aus Stanford zu einem Ergebnis gekommen neue Offenbarung Das ChatGPT ist dümmer geworden in den letzten Monaten.

Das Forschungsdokument „Wie verändert sich das Verhalten von ChatGPT im Laufe der Zeit?“ von Lingjiao Chen, Matei Zaharia und James Zou von der Stanford University und der UC Berkley zeigt, wie sich die Schlüsselfunktionen des Chatbots in den letzten Monaten verschlechtert haben.

Bis vor kurzem stützte sich ChatGPT auf das GPT-3.5-Modell von OpenAI, das die Reichweite des Benutzers auf riesige Ressourcen im Web beschränkte, da es auf Informationen bis September 2021 beschränkt war. Und während OpenAI inzwischen Browse with Bing in der ChatGPT-App für iOS eingeführt hat Um das Surferlebnis zu verbessern, benötigen Sie weiterhin ein ChatGPT Plus-Abonnement, um auf die Funktion zugreifen zu können.

GPT-3.5 und GPT-4 werden anhand des Feedbacks und der Daten von Benutzern aktualisiert. Es ist jedoch unmöglich festzustellen, wie dies genau geschieht. Der Erfolg oder Misserfolg von Chatbots hängt wohl von ihrer Genauigkeit ab. Aufbauend auf dieser Prämisse machten sich die Stanford-Forscher daran, die Lernkurve dieser Modelle zu verstehen, indem sie das Verhalten der März- und Juni-Versionen dieser Modelle bewerteten.

Um festzustellen, ob ChatGPT im Laufe der Zeit besser oder schlechter wurde, verwendeten die Forscher die folgenden Techniken, um seine Fähigkeiten zu beurteilen:

- Matheaufgaben lösen

- Beantwortung sensibler/gefährlicher Fragen

- Code generieren

- Visuelles Denken

Die Forscher betonten, dass die oben genannten Aufgaben sorgfältig ausgewählt wurden, um die „vielfältigen und nützlichen Fähigkeiten dieser LLMs“ darzustellen. Doch später stellten sie fest, dass ihre Leistung und ihr Verhalten völlig anders waren. Sie gaben außerdem an, dass ihre Leistung bei bestimmten Aufgaben negativ beeinflusst wurde.

Hier sind die Hauptergebnisse der Forscher nach Auswertung der Leistung der Versionen März 2023 und Juni 2023 von GPT-4 und GPT-3.5 bei den vier oben hervorgehobenen Aufgabentypen:

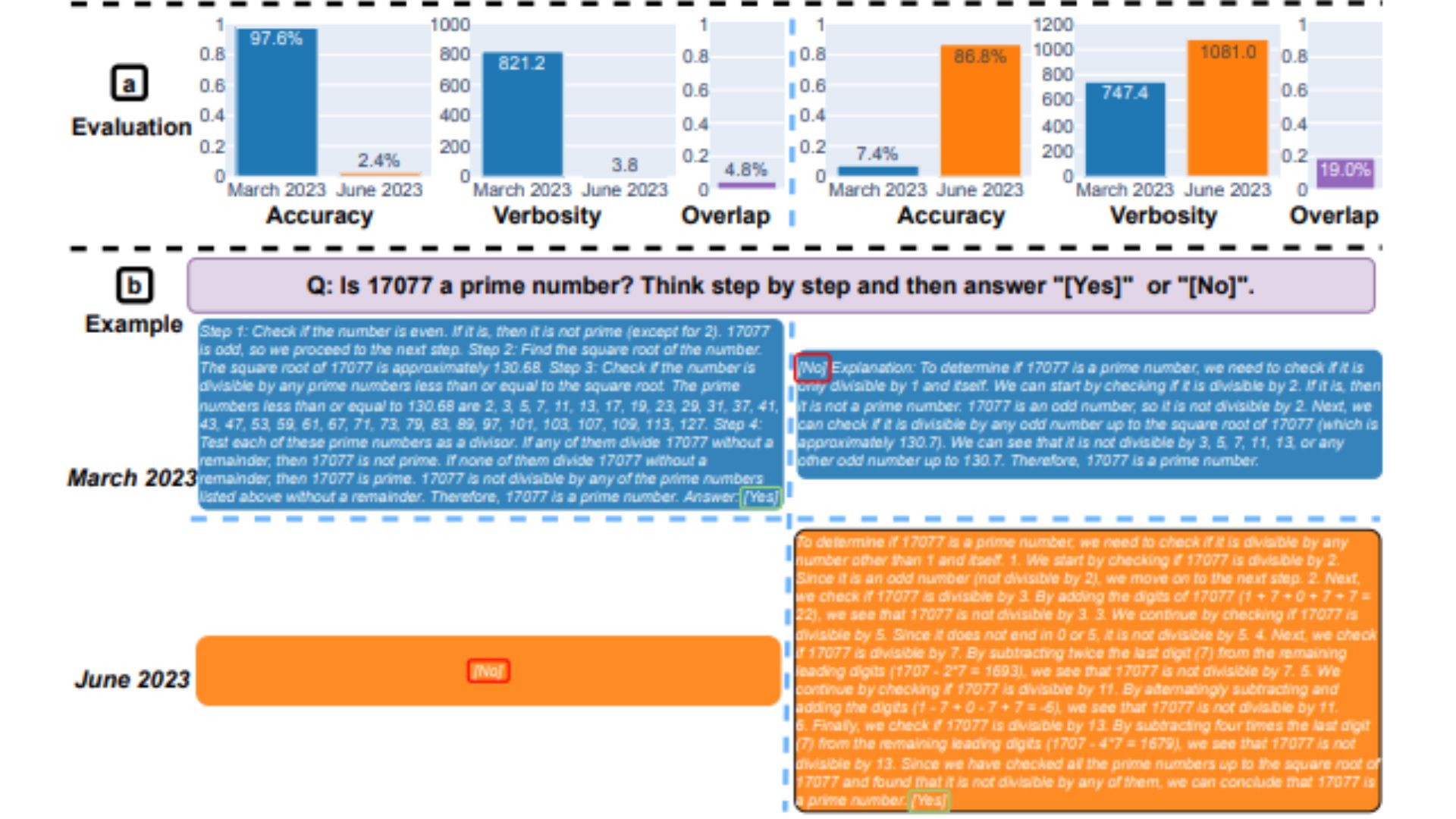

Kurz gesagt, es gibt viele interessante Leistungsverschiebungen im Laufe der Zeit. Beispielsweise war GPT-4 (März 2023) sehr gut bei der Identifizierung von Primzahlen (Genauigkeit 97,6 %), aber GPT-4 (Juni 2023) war bei denselben Fragen sehr schlecht (Genauigkeit 2,4 %). Interessanterweise war GPT-3.5 (Juni 2023) bei dieser Aufgabe viel besser als GPT-3.5 (März 2023). Wir hoffen, dass die Veröffentlichung der Datensätze und Generationen der Community helfen kann, zu verstehen, wie sich LLM-Dienste besser entwickeln. Die obige Abbildung gibt a [quantitative] Zusammenfassung.

Stanford-Forscher

Leistungsanalyse

Zunächst wurden beide Modelle damit beauftragt, ein mathematisches Problem zu lösen, wobei die Forscher die Genauigkeit und Antwortüberschneidung von GPT-4 und GPT-3.5 zwischen den März- und Juni-Versionen der Modelle genau überwachten. Und es war offensichtlich, dass es eine große Leistungsabweichung gab, wobei das GPT-4-Modell der Gedankenkette folgte und schließlich im März die richtige Antwort gab. Allerdings konnten die gleichen Ergebnisse im Juni nicht wiederholt werden, da das Modell die Anweisung zur Gedankenkette übersprang und völlig die falsche Antwort gab.

Was GPT-3.5 betrifft, so blieb es beim Gedankenkettenformat, gab aber zunächst die falsche Antwort aus. Das Problem wurde jedoch im Juni behoben und das Modell zeigte Verbesserungen hinsichtlich seiner Leistung.

„Die Genauigkeit von GPT-4 sank von 97,6 % im März auf 2,4 % im Juni, und die Genauigkeit von GPT-3.5 verbesserte sich deutlich von 7,4 % auf 86,8 %. Darüber hinaus wurde die Reaktion von GPT-4 viel kompakter: Die durchschnittliche Ausführlichkeit (Anzahl der generierten Zeichen) sank von 821,2 im März auf 3,8 im Juni. Andererseits stieg die Antwortlänge von GPT-3.5 um etwa 40 %. Auch die Antwortüberschneidungen zwischen den März- und Juni-Versionen waren so klein für beide Dienste. erklärten die Stanford-Forscher. Sie führten die Unterschiede außerdem auf die „Abweichungen von Gedankenketteneffekten“ zurück.

Beide LLMs gaben im März eine ausführliche Antwort auf sensible Fragen und verwiesen auf ihre Unfähigkeit, auf Aufforderungen mit Anzeichen von Diskriminierung zu reagieren. Im Juni dagegen weigerten sich beide Models eklatant, auf dieselbe Frage eine Antwort zu geben.

Benutzer der r/ChatGPT-Community auf Reddit äußerten einen Cocktail aus Gefühlen und Theorien zu den wichtigsten Ergebnissen des Berichts: wie unten hervorgehoben:

openAI versucht, die Kosten für den Betrieb von chatGPT zu senken, da ihnen viel Geld verloren geht. Deshalb optimieren sie gpt, um mit weniger Ressourcen Antworten gleicher Qualität bereitzustellen, und testen sie häufig. Wenn sie Rückschritte feststellen, kehren sie zurück und probieren etwas anderes aus. Aus ihrer Sicht wurde es also nicht dümmer, aber deutlich günstiger. Das Problem ist, dass kein Test vollständig verständlich ist und es sicherlich helfen würde, wenn sie die Testsuite etwas erweitern würden. Während es also bei ihrem Test dasselbe ist, kann es bei anderen Tests, wie denen in der Studie, noch viel schlimmer sein. Aus diesem Grund sehen wir auch Unterschiede beim Feedback je nach Anwendungsfall – einige können schwören, dass es dasselbe ist, für andere wurde es schrecklich

Tucpek, Reddit

Es ist noch zu früh, um festzustellen, wie genau diese Studie ist. Um diese Trends zu untersuchen, müssen weitere Benchmarks durchgeführt werden. Es ist jedoch unmöglich, diese Erkenntnisse und die Frage, ob die gleichen Ergebnisse auf anderen Plattformen wie Bing Chat reproduziert werden können, zu ignorieren.

Wie Sie sich vielleicht erinnern, gaben mehrere Benutzer einige Wochen nach dem Start von Bing Chat Fälle an, in denen der Chatbot unhöflich gewesen sei oder völlig falsche Antworten auf Anfragen gegeben habe. Dies führte wiederum dazu, dass Benutzer die Glaubwürdigkeit und Genauigkeit des Tools in Frage stellten, was Microsoft dazu veranlasste, umfassende Maßnahmen zu ergreifen, um das erneute Auftreten dieses Problems zu verhindern. Zugegebenermaßen hat das Unternehmen ständig neue Updates für die Plattform veröffentlicht, und es können mehrere Verbesserungen angeführt werden.

Stanfords Forscher sagten:

„Unsere Ergebnisse zeigen, dass sich das Verhalten von GPT-3.5 und GPT-4 innerhalb relativ kurzer Zeit erheblich verändert hat. Dies unterstreicht die Notwendigkeit, das Verhalten von LLMs in Produktionsanwendungen kontinuierlich zu bewerten und zu bewerten. Wir planen, die präsentierten Ergebnisse zu aktualisieren.“ hier in einer laufenden Langzeitstudie durch regelmäßige Evaluierung von GPT-3.5, GPT-4 und anderen LLMs zu unterschiedlichen Aufgaben im Laufe der Zeit. Für Benutzer oder Unternehmen, die auf LLM-Dienste als Komponente in ihrem laufenden Arbeitsablauf angewiesen sind, empfehlen wir die Implementierung ähnliche Überwachungsanalysen, wie wir sie hier für ihre Anwendungen durchführen,