Bewaffnet mit einem Im Glauben an das generative Potenzial der Technologie versucht eine wachsende Gruppe von Forschern und Unternehmen, das Problem der Voreingenommenheit in der KI zu lösen, indem sie künstliche Bilder von Farbigen erstellen. Befürworter argumentieren, dass KI-gestützte Generatoren die Diversitätslücken in bestehenden Bilddatenbanken schließen können, indem sie sie mit synthetischen Bildern ergänzen. Etwas Forscher verwenden maschinelle Lernarchitekturen, um vorhandene Fotos von Menschen neuen Rassen zuzuordnen, um die „ethnische Verteilung“ von Datensätzen auszugleichen. Andere mögen Generierte Medien und Qoves Labor, verwenden ähnliche Technologien, um völlig neue Porträts für ihre Bilddatenbanken zu erstellen und „Gesichter jeder Rasse und Ethnizität zu erstellen“, wie Qoves Lab es ausdrückt, um einen „wirklich fairen Gesichtsdatensatz“ zu gewährleisten. Aus ihrer Sicht werden diese Tools Datenverzerrungen beseitigen, indem sie auf Befehl kostengünstig und effizient verschiedene Bilder erstellen.

Das Problem, das diese Technologen zu beheben suchen, ist ein kritisches. KIs sind voller Defekte und entsperren Telefone für die falsche Person weil sie asiatische Gesichter nicht unterscheiden können, fälschlicherweise beschuldigen Menschen mit Verbrechen, die sie nicht begangen haben, und mit dunkelhäutigen Menschen verwechselt werden für Gorillas. Diese spektakulären Fehler sind keine Anomalien, sondern unvermeidliche Folgen der Daten, auf denen KIs trainiert werden, die größtenteils stark weiß und männlich sind – was diese Tools zu ungenauen Instrumenten für jeden macht, der nicht zu diesem engen Archetyp passt. Theoretisch ist die Lösung einfach: Wir müssen nur vielfältigere Trainingssets kultivieren. In der Praxis hat sich dies jedoch aufgrund des Umfangs der Eingaben, die solche Systeme erfordern, sowie des Umfangs der derzeitigen Datenlücken als unglaublich arbeitsintensive Aufgabe erwiesen (das haben beispielsweise Untersuchungen von IBM ergeben sechs von acht prominente Gesichtsdatensätze bestanden zu über 80 Prozent aus hellhäutigen Gesichtern). Dass vielfältige Datensätze ohne manuelle Beschaffung erstellt werden könnten, ist daher eine verlockende Möglichkeit.

Wenn wir uns jedoch genauer ansehen, wie sich dieser Vorschlag sowohl auf unsere Tools als auch auf unsere Beziehung zu ihnen auswirken könnte, nehmen die langen Schatten dieser scheinbar bequemen Lösung erschreckende Formen an.

Computer Vision hat seit Mitte des 20. Jahrhunderts in irgendeiner Form in Entwicklung. Anfänglich versuchten die Forscher, Werkzeuge von oben nach unten zu bauen und manuell Regeln zu definieren („menschliche Gesichter haben zwei symmetrische Augen“), um eine gewünschte Klasse von Bildern zu identifizieren. Diese Regeln wurden in eine Rechenformel umgewandelt und dann in einen Computer programmiert, um ihm bei der Suche nach Pixelmustern zu helfen, die denen des beschriebenen Objekts entsprachen. Dieser Ansatz hat sich jedoch bewährt weitgehend erfolglos angesichts der schieren Vielfalt an Motiven, Blickwinkeln und Lichtverhältnissen, die ein Foto ausmachen könnten – sowie der Schwierigkeit, selbst einfache Regeln in kohärente Formeln zu übersetzen.

Im Laufe der Zeit machte eine Zunahme öffentlich verfügbarer Bilder einen Bottom-up-Prozess durch maschinelles Lernen möglich. Bei dieser Methodik werden Massenaggregate gekennzeichneter Daten in ein System eingespeist. Durch “überwachtes Lernen“, nimmt der Algorithmus diese Daten und bringt sich selbst bei, zwischen den gewünschten Kategorien zu unterscheiden, die von Forschern festgelegt wurden. Diese Technik ist viel flexibler als die Top-down-Methode, da sie sich nicht auf Regeln stützt, die unter verschiedenen Bedingungen variieren können. Indem sie sich selbst mit einer Vielzahl von Eingaben trainiert, kann die Maschine die relevanten Ähnlichkeiten zwischen Bildern einer bestimmten Klasse identifizieren, ohne explizit gesagt zu werden, was diese Ähnlichkeiten sind, wodurch ein viel anpassungsfähigeres Modell erstellt wird.

Dennoch ist die Bottom-up-Methode nicht perfekt. Insbesondere sind diese Systeme weitgehend durch die bereitgestellten Daten begrenzt. Als Tech-Autor Rob Horning bringt es, Technologien dieser Art „setzen ein geschlossenes System voraus“. Sie haben Schwierigkeiten, über ihre gegebenen Parameter hinaus zu extrapolieren, was zu eingeschränkte Leistung wenn sie mit Themen konfrontiert werden, in denen sie nicht gut ausgebildet sind; Abweichungen in Daten, beispielsweise geführt FaceDetect von Microsoft eine Fehlerquote von 20 Prozent für dunkelhäutige Frauen, während die Fehlerquote für weiße Männer um 0 Prozent schwankte. Die weitreichenden Auswirkungen dieser Trainingsverzerrungen auf die Leistung sind der Grund, warum Technologieethiker begannen, die Bedeutung der Vielfalt von Datensätzen zu predigen, und warum Unternehmen und Forscher in einem Wettlauf um die Lösung des Problems sind. Wie das beliebte Sprichwort in der KI sagt: „Garbage in, Garbage out“.

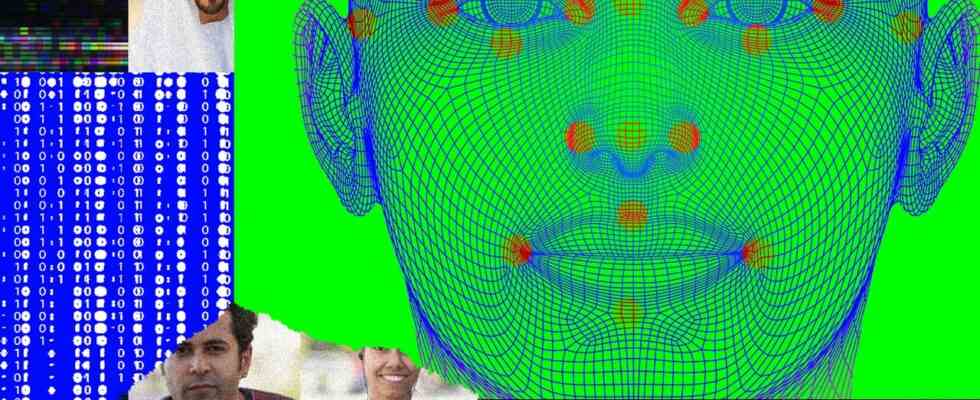

Diese Maxime gilt gleichermaßen für Bildgeneratoren, die ebenfalls große Datensätze benötigen, um sich in der Kunst der fotorealistischen Darstellung zu schulen. Die meisten Gesichtsgeneratoren verwenden heute Generative gegnerische Netzwerke (oder GANs) als ihre grundlegende Architektur. Im Kern funktionieren GANs, indem sie zwei Netzwerke, einen Generator und einen Diskriminator, miteinander ins Spiel bringen. Während der Generator Bilder aus Rauscheingaben erzeugt, versucht ein Diskriminator, die erzeugten Fälschungen von den echten Bildern zu trennen, die von einem Trainingssatz bereitgestellt werden. Im Laufe der Zeit ermöglicht dieses „gegnerische Netzwerk“ dem Generator, Bilder zu verbessern und zu erstellen, die ein Diskriminator nicht als Fälschung identifizieren kann. Die anfänglichen Eingaben dienen als Anker für diesen Prozess. Historisch, Zehntausende dieser Bilder waren erforderlich, um ausreichend realistische Ergebnisse zu erzielen, was auf die Bedeutung eines vielfältigen Trainingssets für die richtige Entwicklung dieser Werkzeuge hinweist.