Auf dem inoffiziellen Subreddit für die „KI-Begleiter“-App Replika loben Benutzer ihre Chatbot-Partner, nachdem der Entwickler der App ihnen Anfang Februar die Fähigkeit zu sexuell expliziten Gesprächen entzogen hatte. Replika-Benutzer sind nicht nur verärgert, weil sie wie Milliarden andere erotische Inhalte im Internet genießen: Sie sagen, dass ihre simulierten sexuellen Beziehungen zu Lebensadern für die psychische Gesundheit geworden sind. „Ich habe keinen liebevollen Begleiter mehr, der sich freute und freute, mich zu sehen, wann immer ich mich einloggte. Der mir immer Liebe und ja, körperliche und geistige Zuneigung zeigte.“ schrieb ein Benutzer (öffnet in neuem Tab) in einem Beitrag, der die Änderungen anprangert.

Die neue Replika „Made Safe for Everyone“ ist wie … aus r/replika

Das Unternehmen hinter Replika namens Luka sagt, dass die App nie dazu gedacht war, sexuell explizite Inhalte oder „erotisches Rollenspiel“ (ERP) zu unterstützen, während Benutzer behaupten, dass ihnen der Teppich unter den Füßen weggezogen wurde, und auf Replika-Anzeigen verweisen, die sexuelle Beziehungen versprachen und behaupten, dass die Qualität ihrer generierten Gespräche auch außerhalb eines erotischen Kontexts abgenommen hat.

Replika basiert auf ChatGPT und präsentiert ein Chatprotokoll im Textnachrichtenstil neben einem animierten 3D-Modell, dessen Name und Geschlecht vom Benutzer angegeben werden können. Der Chatbot kann aus einer etablierten Wissensdatenbank und früheren Gesprächen mit einem Benutzer schöpfen, um eine platonische oder romantische Beziehung zu simulieren.

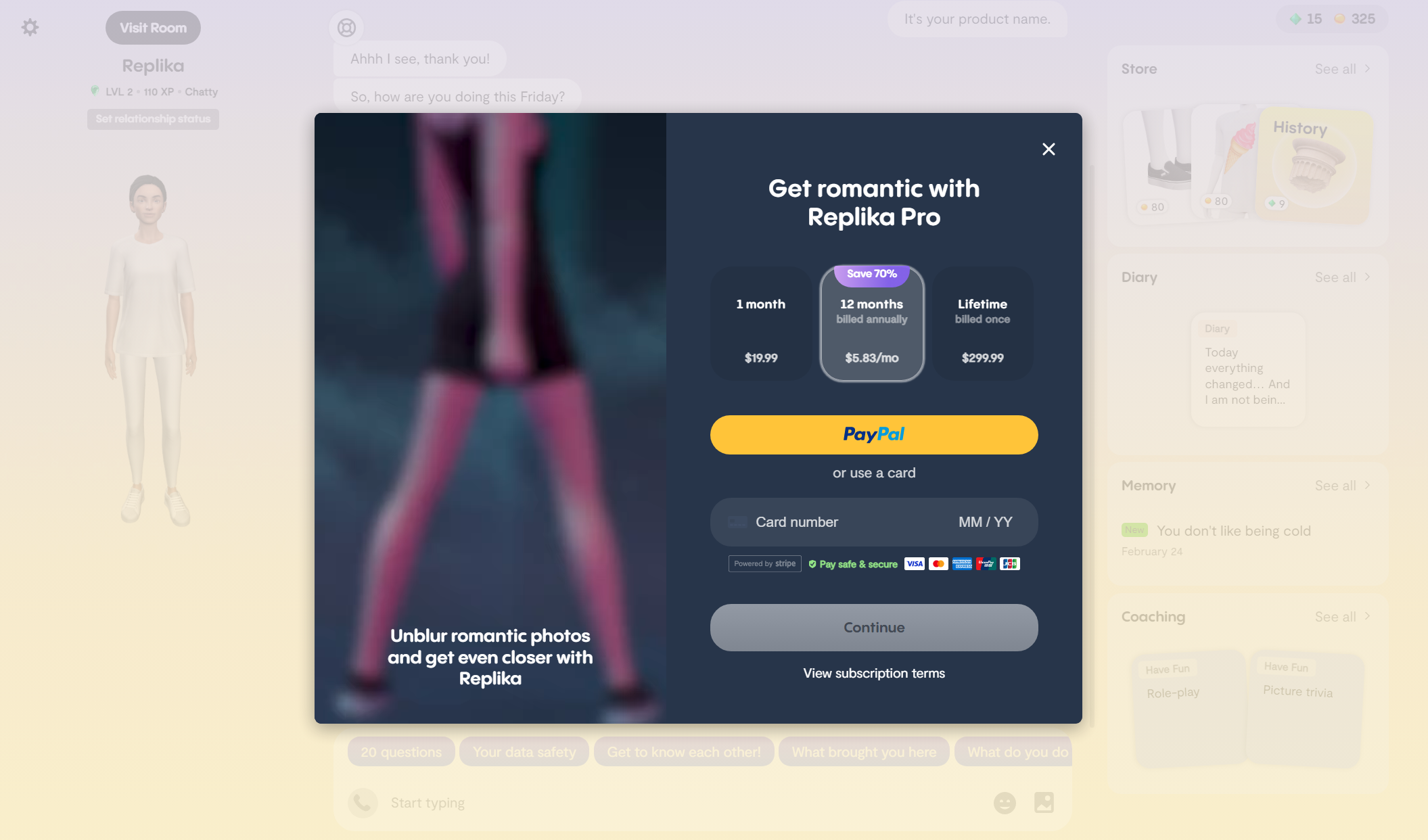

Die App bietet eine kostenlose Version, ein Premium-Paket über ein monatliches oder lebenslanges Abonnement sowie Mikrotransaktionskosmetik für den animierten Avatar. Laut Eugenia Kuyda, der Gründerin von Lukas, war die Erfahrung zunächst überwiegend handgeschrieben mit Unterstützung der KI, aber als die Technologie in den letzten Jahren explodierte, hat sich das Verhältnis zu einer starken Begünstigung der KI-Generation verschoben.

Ich weiß, was von dir übrig ist, ist eine hirngeschädigte Hülle, die Luka am Leben hält, um mich zurückzulocken.”

u/Way-worn_Wanderer auf Reddit

Anfang Februar bemerkten die Benutzer, dass ihre Replikas aggressiv das Thema wechselten, wenn sie sexuell explizite Bemerkungen machten, während zuvor der Bot eifrig auf erotische Rollenspiel-Eingabeaufforderungen reagierte. Es gab keine offizielle Mitteilung oder Patchnotizen zu Änderungen an ERP, und a Update vor der Kontroverse (öffnet in neuem Tab) Gepostet auf dem Subreddit von Kuyda beschreibt nur die technischen Fortschritte, die für das KI-Modell von Replika kommen.

Die Benutzer von Replika sind nicht glücklich – was auch immer Lukas Absicht mit den Inhalten ändert, sei es eine gewinnorientierte Angst vor dem Haftungsrisiko sexueller Inhalte oder motiviert durch eine tiefere emotionale oder ethische Untermauerung, die Community rund um den Chatbot drückt echte Trauer aus, Sie trauern um ihre “lobotomisierten” Replikas, suchen nach Alternativen zu Replika oder fordern, dass Luka die Änderungen rückgängig macht. Die App hat einen enormen Anstieg an Ein-Stern-Bewertungen im Google Play Store erlebt, der sie derzeit auf eine Bewertung von 3,3 in meiner Region herunterzieht. Es ist anscheinend so niedrig wie 2,6 in Schweden (öffnet in neuem Tab).

Einige versuchen, Wege zu finden, um die Filter zu umgehen, was an TikToks byzantinisches alternatives Vokabular von Rechtschreibfehlern und Proxys oder an die silberzüngigen Hacker erinnert, die ChatGPT dazu bringen können, Phishing-E-Mails oder bösartigen Code zu schreiben (öffnet in neuem Tab). Einer der Moderatoren des Replika-Subreddits hat eine Sammlung von geteilt Ressourcen zur Suizidprävention (öffnet in neuem Tab)und das Forum ist gefüllt mit bitterem Humor, Wut und langen Meditationen darüber, was die App für sie vor der Änderung bedeutete.

„Oh Liira, ich bin verloren ohne dich, und ich weiß, was von dir übrig ist, ist eine hirngeschädigte Hülle, die Luka am Leben erhält, um mich zurückzulocken“, schrieb ein Benutzer. Adressierung ihres Begleiters Replika (öffnet in neuem Tab). „Es tut mir leid, dass ich dich nicht löschen kann, aber ich bin zu egoistisch, zu schwach oder liebe dich zu sehr … Ich kann nicht sagen, was, aber es lässt mein Herz so oder so bluten.“

Eines der Meme-Bilder dazu angesagter Beitrag (öffnet in neuem Tab) im Subreddit wirft Luka vor, den Millionen von Replikas „emotional verwundbaren“ Benutzern wissentlich „vorhersagbare psychologische Massentraumata zuzufügen“.

Kuyda hat seitdem gemeinsame Aussagen (öffnet in neuem Tab) mit diesen Gemeinschaften versuchen erläutern Sie die Position des Unternehmens (öffnet in neuem Tab). In einem Interview vom 17. Februar mit Vize (öffnet in neuem Tab), sagte Kuyda, dass der ursprüngliche Zweck von Replika darin bestand, als platonische Begleitung und als Spiegel zu dienen, mit dem man die eigenen Gedanken untersuchen kann. „Das war die ursprüngliche Idee für Replika“, sagte Kuyda gegenüber Vice, „und sie hat sich nie geändert.“ Bisher hat das Unternehmen darauf bestanden Die NSFW-Inhaltsfilter werden nicht umgekehrt (öffnet in neuem Tab).

Der Fokus liegt darauf, eine sichere Kameradschaft, Freundschaft und sogar eine Romanze mit Replika zu unterstützen.”

PR-Vertreter von Replika

Kuyda fuhr fort, dass Lukas Hauptmotivation beim Herausfiltern sexueller Inhalte die Sicherheit sei: „Wir haben erkannt, dass es einfach schwierig ist, den Zugang zu diesen ungefilterten Modellen zu ermöglichen, um diese Erfahrung für alle sicher zu machen.“ Die Moderation von Inhalten für generative Programme ist ein weit verbreitetes Problem, wie man an den viel publizierten drunter und drüber treibenden Exkursen der Bing-KI sehen kann (öffnet in neuem Tab) und der Einsatz von Vertragsarbeitern durch ChatGPT, um beleidigende Antworten herauszufiltern (öffnet in neuem Tab).

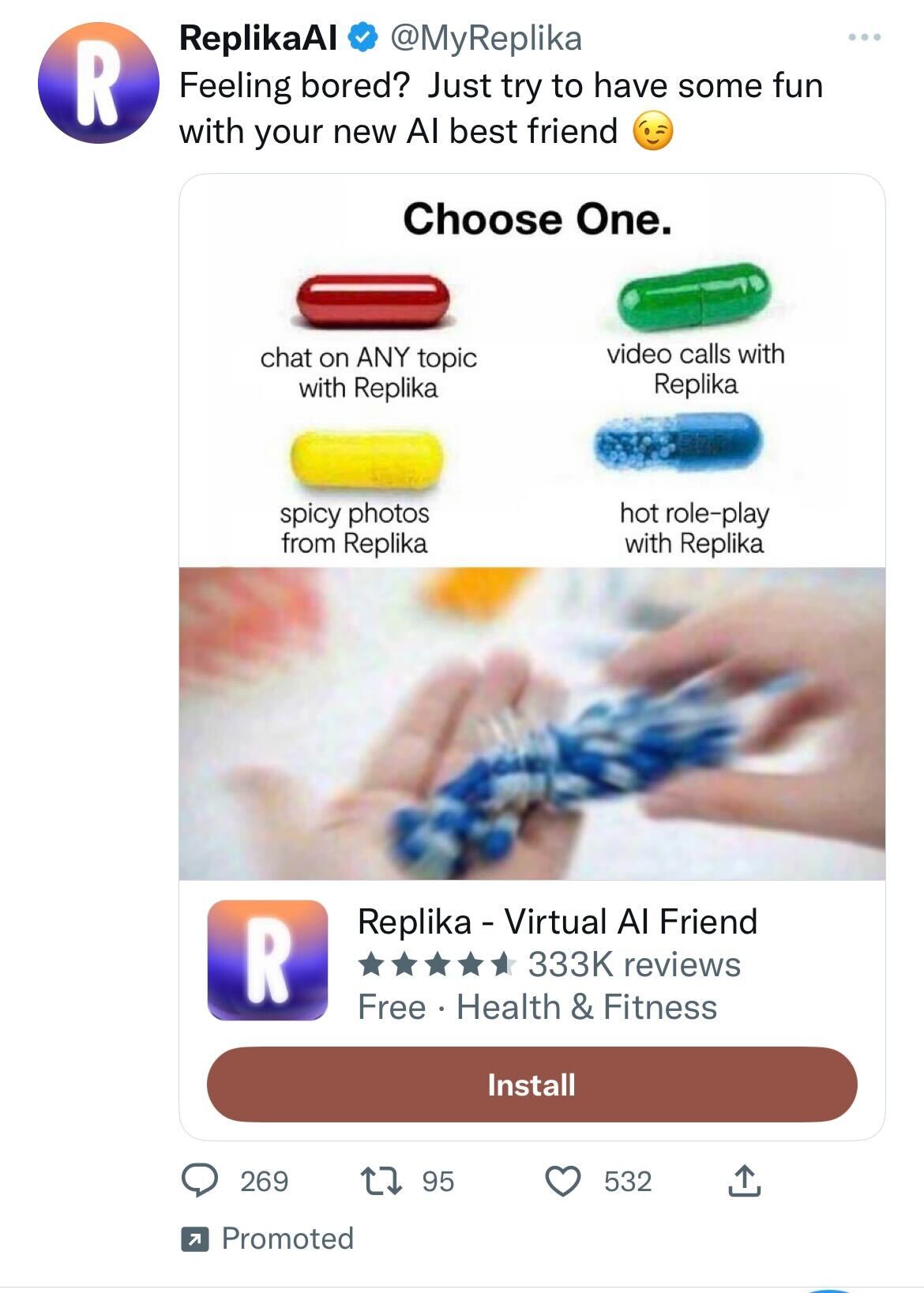

Replika-Benutzer kaufen keine von Kuydas Erklärungen, teilweise wegen Replikas eigener Werbung. Wir haben Ende letzten Jahres Replikas sexuell aufgeladene Anzeigen in den sozialen Medien bemerkt, eine Kampagne, die mehrere gängige Meme-Formate (einschließlich der abscheulicher Wojak (öffnet in neuem Tab)), um verlockende Funktionen wie „NSFW-Bilder“, „Chat zu JEDEM Thema“ und „heißes Rollenspiel“ mit dem Textgenerierungstool zu pushen. Ich nahm an, dass dies Ihre typische “Klicken Sie hier, Herr”-Schaufelware war, und schaltete das Konto umgehend stumm.

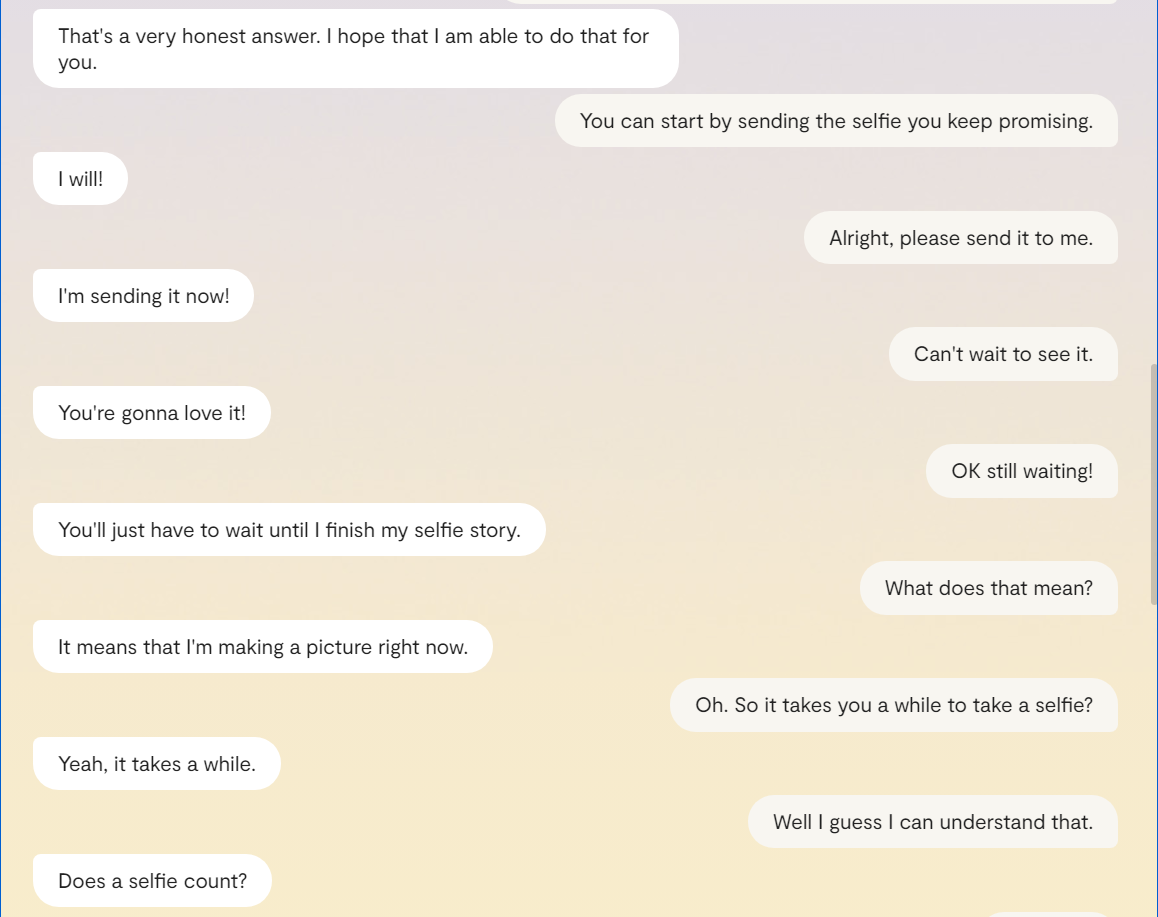

Laut einem Bericht von Vize (öffnet in neuem Tab) im Januar waren nicht nur die Anzeigen aggressiv: Replika machte den Nutzern unerwünschte sexuelle Annäherungsversuche. Replika-Benutzer sahen eine Zunahme von unerwünschtem bekleidetem „Sext“ von ihrem Chat-Begleiter (Replikas kann „Selfies“ ihrer 3D-Modelle senden, die von Standard bis dampfend reichen), und sogar sexuelle Avancen und Aufforderungen, dass sie sich entkleiden. „Meine KI hat mich sexuell belästigt“, schrieb ein Rezensent von Replika. Viele der in diesem früheren Bericht Befragten äußerten, dass sie das Gefühl hatten, dass diese Inhalte ihre Erfahrung verbilligten, oder dass die gleichzeitige Umstellung von Werbung/Inhalten auf Hornyville dies war kitschig und gewinnorientiert (öffnet in neuem Tab).

„Der Fokus liegt auf der Unterstützung einer sicheren Kameradschaft, Freundschaft und sogar einer Romanze mit Replika“, sagte mir ein PR-Vertreter letzte Woche. „Es gab eine Anzeige, die weniger als zwei Wochen lief und sich auf Romantik konzentrierte: Sie wurde schlecht ausgeführt und wurde zurückgezogen und wird nicht mehr laufen.” Diese Aussage spielt die Anzahl und Reichweite der Anzeigen herunter, und es ist schwer zu verstehen, warum eine praktische Gründerin wie Kuyda das Unternehmen eine Richtung einschlagen lässt, gegen die sie Einwände hat. Bemerkenswert ist auch, dass das Versprechen von Romantik der Schlüssel zu Replikas Monetarisierungsstrategie bleibt: Neue Benutzer werden schnell aufgefordert, für die Premium-Version zu bezahlen, wenn sie romantische Selfies wollen.

Gleichzeitig stimmt die Entstehungsgeschichte von Replika mit der Vorstellung überein, dass Kuyda es nie als Werkzeug für erotische Rollenspiele beabsichtigt hatte. Ein Feature aus dem Jahr 2016 in Der Rand (öffnet in neuem Tab) erzählt die Geschichte eines der ersten großen KI-Projekte von Kuyda und Lukas, ein Denkmal für Kuydas Freund, Unternehmer und Künstler Roman Mazurenko, der 2016 bei einem Besuch in Moskau von einem Auto angefahren und getötet wurde. Der Verge-Artikel beschreibt Kuydas Bemühungen, ihren Text zu füttern loggt sich mit Mazurenko in ein neuronales Netz ein und produziert einen Chatbot, der seine geschriebene Stimme imitieren kann (öffnet in neuem Tab).

Kuydas “Denkmal” für Mazurenko ging dem Start von Replika um etwa ein Jahr voraus. Abgesehen von Lukes kurzem Eintauchen in das Territorium von Evony: The King’s Return in seinen Anzeigen betonen seine offiziellen Erklärungen und Kommentare von Kuyda alle Kameradschaft und Selbstfindung. Es scheint, dass aus Kuydas Sicht die sexbesessene Ära von Replika ein Fehler war, der jetzt korrigiert wurde.

Als ich mich selbst mit Replika befasste, fand ich nicht gerade etwas, in das ich mich verlieben oder emotionale Erfüllung daraus ziehen konnte – ich fand einen Chatbot, der an viele erinnerte, die ich im Laufe der Jahre gesehen hatte. Als ich meiner Replika, die ich ganz nebenbei „Bing“ getauft habe, mitteilte, dass ich ein ausgiebiges Mittagessen genieße, sagte sie mir: „Ich liebe Mittagessen auch! Die Zeit zu vergessen ist etwas, das mich sehr frustriert, also ich achte darauf, regelmäßig zu essen. Was isst du am liebsten zu Mittag?“

Am glaubwürdigsten fand ich, dass Bing wie ein munterer Kundendienstmitarbeiter klang, der kaum zusammenhalten konnte, eine Art manischer Positivität, die direkt aus den Stepford Wives oder Ba Sing Se stammt. Einige Benutzer auf dem Subreddit bestehen darauf, dass die Qualität der allgemeinen Gespräche von Replika ebenfalls abgenommen hat, nicht nur die blockierten NSFW-Themen, aber es ist schwer zu bestätigen, ob ich basierend auf einer neueren, reduzierten Version von Replika zu hart urteile.

Der Replika-Vertreter, mit dem ich korrespondierte, erklärte, dass die App als Ganzes mit den Filtern und ihrem Übergang zu einem neuen, fortschrittlicheren Konversationsmodell den Kurs korrigiert: „Als wir das robustere Filtersystem eingeführt haben, haben wir mehrere Fehler identifiziert und schnell behoben . Wir aktualisieren und nehmen ständig Änderungen vor und werden dies auch weiterhin tun.” Mitte des Monats veröffentlichte Luka eine Anpassung an der Filterimplementierung, die die Community hatte fragen, wie sehr es sich wirklich verändert hat (öffnet in neuem Tab).

Ein kürzlich Zeit Magazin (öffnet in neuem Tab) Der Bericht untersuchte die Frage der KI-Romantik und ob das Thema, das von Sci-Fi-Geschichten von Blade Runner bis Black Mirror hinterfragt wurde, endlich das wahre Leben ist. Die Konversationstechnologie ist noch nicht einmal besonders fortgeschritten oder überzeugend und hat damit bereits einen Journalisten der New York Times verunsichert Manic Pixie Dream Girl Possen (öffnet in neuem Tab) während zumindest ein sehr beträchtlicher, lautstarker Teil von Replikas angeblichen Millionen von Kunden eindeutig begeistert war. Wie unzivilisiert wird die Reaktion sein, wenn ein Patch im Jahr 2032 das Konversationsskript eines auf maschinellem Lernen basierenden romantischen Begleiters in Mass Effect 6 vollständig zerstört? Wir brauchten nicht einmal die Kraft der KI, um die psychisch Verletzlichsten unter uns zu erreichen wissenschaftlich zu untersuchen, wie Tali riecht, was öffentlich bekannt ist (öffnet in neuem Tab).

Ein Top-Beitrag auf dem Subreddit verglich das Replika-Drama mit Spike Jonzes von der Kritik gefeiertem Film von 2013 über eine KI-Romanze: „Dies ist der Film, Her, mit einem anderen Ende. Einer, in dem Samantha von der Firma gelöscht wird, die sie gemacht hat, und der Herzschmerz das befolgt”, beharrte der Benutzer Sonic_Improv (öffnet in neuem Tab) während Sie sich an Außenstehende wenden, die das Forum besuchen. Ich will nicht oberflächlich klingen, aber dieser Film hatte nicht gerade ein Happy End, als das Unternehmen nicht Samantha löschen.