DynamoFL, das Software anbietet, um Unternehmen große Sprachmodelle (LLMs) zur Verfügung zu stellen und diese Modelle anhand sensibler Daten zu verfeinern, gab heute bekannt, dass es in einer von Canapi Ventures und Nexus Venture Partners gemeinsam geleiteten Serie-A-Finanzierungsrunde 15,1 Millionen US-Dollar eingesammelt hat.

Durch die Tranche, an der Formus Capital und Soma Capital beteiligt waren, beläuft sich die Gesamteinnahme von DynamoFL auf 19,3 Millionen US-Dollar. Mitbegründer und CEO Vaikkunth Mugunthan sagt, dass der Erlös in die Erweiterung des Produktangebots von DynamoFL und den Ausbau seines Teams von Datenschutzforschern fließen wird.

„Zusammengenommen ermöglicht das Produktangebot von DynamoFL Unternehmen die Entwicklung privater und konformer LLM-Lösungen ohne Kompromisse bei der Leistung“, sagte Mugunthan gegenüber TechCrunch in einem E-Mail-Interview.

DynamoFL mit Sitz in San Francisco wurde 2021 von Mugunthan und Christian Lau gegründet, beide Absolventen der Fakultät für Elektrotechnik und Informatik des MIT. Mugunthan sagt, dass sie bei der Gründung des Unternehmens von dem gemeinsamen Wunsch motiviert waren, „kritische“ Datensicherheitslücken in KI-Modellen zu schließen.

„Generative KI hat neue Risiken in den Vordergrund gerückt, einschließlich der Möglichkeit für LLMs, sensible Trainingsdaten zu ‚merken‘ und diese Daten an böswillige Akteure weiterzugeben“, sagte Mugunthan. „Unternehmen sind für die Bewältigung dieser Risiken nur unzureichend gerüstet, da eine ordnungsgemäße Behebung dieser LLM-Schwachstellen die Rekrutierung von Teams aus hochspezialisierten Datenschutzforschern für maschinelles Lernen erfordern würde, um eine optimierte Infrastruktur für die kontinuierliche Prüfung ihrer LLMs auf neu auftretende Datensicherheitsschwachstellen zu schaffen.“

Unternehmen stehen bei der Einführung von LLMs für ihre Zwecke sicherlich vor Herausforderungen – vor allem im Zusammenhang mit der Compliance. Unternehmen befürchten, dass ihre vertraulichen Daten bei Entwicklern landen, die die Modelle anhand von Benutzerdaten trainiert haben. In den letzten Monaten haben große Unternehmen wie Apple, Walmart und Verizon ihren Mitarbeitern die Nutzung von Tools wie ChatGPT von OpenAI verboten.

In einem aktuellen Bericht identifizierte Gartner sechs Rechts- und Compliance-Risiken, die Unternehmen als „verantwortungsvolles“ LLM-Risiko bewerten müssen, darunter das Potenzial von LLMs, Fragen ungenau zu beantworten (ein Phänomen, das als Halluzination bekannt ist), Datenschutz und Vertraulichkeit sowie Modellverzerrungen (z. B , wenn ein Model bestimmte Geschlechter stereotyp mit bestimmten Berufen verbindet). Der Bericht stellt fest, dass diese Anforderungen je nach Staat und Land variieren können, was die Angelegenheit erschwert; Kalifornien schreibt beispielsweise vor, dass Unternehmen offenlegen müssen, wenn ein Kunde mit einem Bot kommuniziert.

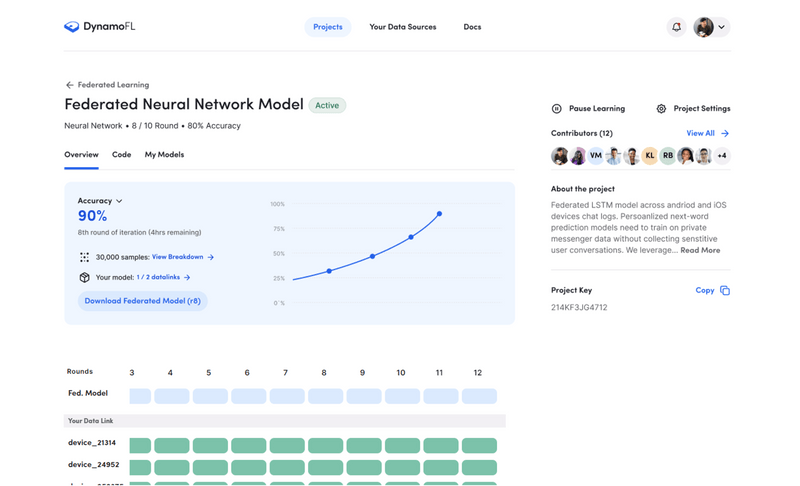

Bildnachweis: DynamoFL

DynamoFL, das in der virtuellen privaten Cloud eines Kunden oder vor Ort bereitgestellt wird, versucht, diese Probleme auf verschiedene Weise zu lösen, unter anderem mit einem LLM-Penetrationstest-Tool, das LLM-Datensicherheitsrisiken erkennt und dokumentiert, z. B. ob ein LLM gespeicherte Daten hat oder könnte sensible Daten preisgeben. Verschiedene Studien haben gezeigt, dass LLMs je nach Schulung und Anleitung persönliche Informationen preisgeben können – ein offensichtliches Gräuel für große Unternehmen, die mit proprietären Daten arbeiten.

Darüber hinaus bietet DynamoFL eine LLM-Entwicklungsplattform, die Techniken zur Minderung von Modelldatenleckrisiken und Sicherheitslücken umfasst. Mithilfe der Plattform können Entwickler verschiedene Optimierungen in Modelle integrieren und so deren Ausführung auf Hardware-beschränkten Umgebungen wie Mobilgeräten und Edge-Servern ermöglichen.

Diese Fähigkeiten sind, um es klarzustellen, nicht besonders einzigartig – zumindest nicht auf den ersten Blick. Startups wie OctoML, Seldon und Deci bieten Tools zur Optimierung von KI-Modellen für eine effizientere Ausführung auf einer Vielzahl von Hardware. Andere, wie LlamaIndex und Contextual AI, konzentrieren sich auf Datenschutz und Compliance und bieten datenschutzfreundliche Möglichkeiten, LLMs anhand von Erstanbieterdaten zu trainieren.

Was ist also das Alleinstellungsmerkmal von DynamoFL? Die „Gründlichkeit“ seiner Lösungen, argumentiert Mugunthan. Dazu gehört die Zusammenarbeit mit Rechtsexperten, um zu entwerfen, wie DynamoFL zur Entwicklung von LLMs unter Einhaltung der Datenschutzgesetze der USA, Europas und Asiens genutzt werden kann.

Der Ansatz zog mehrere Fortune-500-Kunden an, insbesondere aus den Bereichen Finanzen, Elektronik, Versicherungen und Automobil.

„Während es heutzutage Produkte gibt, um personenbezogene Daten aus an LLM-Dienste gesendeten Anfragen zu schwärzen, erfüllen diese nicht die strengen gesetzlichen Anforderungen in Branchen wie Finanzdienstleistungen und Versicherungen, wo geschwärzte personenbezogene Daten häufig durch raffinierte böswillige Angriffe erneut identifiziert werden“, sagt er sagte. „DynamoFL hat auf die Expertise seines Teams im Bereich KI-Datenschutzlücken zurückgegriffen, um die umfassendste Lösung für Unternehmen zu entwickeln, die regulatorische Anforderungen für die LLM-Datensicherheit erfüllen möchten.“

DynamoFL befasst sich nicht mit einem der heikleren Probleme der heutigen LLMs: IP- und Urheberrechtsrisiken. Kommerzielle LLMs werden mit einer großen Menge an Internetdaten trainiert, und manchmal geben sie diese Daten wieder aus – was jedes Unternehmen, das sie nutzt, dem Risiko einer Urheberrechtsverletzung aussetzt.

Aber Mugunthan deutete an, dass es künftig noch mehr Tools und Lösungen geben wird, angetrieben durch die jüngste Finanzierung von DynamoFL.

„Die Bewältigung der Anforderungen der Regulierungsbehörden ist eine entscheidende Verantwortung für C-Level-Manager in der IT-Abteilung, insbesondere in Sektoren wie Finanzdienstleistungen und Versicherungen“, sagte er. „Die Nichteinhaltung von Vorschriften kann zu einem irreparablen Vertrauensverlust der Kunden führen, wenn vertrauliche Informationen durchsickern, hohe Geldstrafen nach sich ziehen und zu erheblichen Störungen im Geschäftsbetrieb eines Unternehmens führen.“ Die Datenschutzbewertungssuite von DynamoFL bietet sofort einsatzbereite Tests auf Schwachstellen bei der Datenextraktion und automatisierte Dokumentation, die zur Erfüllung von Sicherheits- und Compliance-Anforderungen erforderlich ist.“

DynamoFL, das derzeit ein Team von rund 17 Mitarbeitern beschäftigt, rechnet damit, bis Ende des Jahres 35 Mitarbeiter zu haben.