Nvidia, das mit seinen rechenzentrumsorientierten Rechen-GPUs in einem Quartal gerade über 10 Milliarden US-Dollar verdient hat, plant demnach, die Produktion solcher Produkte im Jahr 2024 mindestens zu verdreifachen Die Financial Times, in dem Quellen mit Sachkenntnis zitiert werden. Der Schritt ist sehr ehrgeizig und wenn es Nvidia gelingt, ihn durchzuziehen und die Nachfrage nach seinen A100, H100 und anderen Rechen-CPUs für Anwendungen im Bereich der künstlichen Intelligenz (KI) und des Hochleistungsrechnens (HPC) weiterhin stark bleibt, könnte dies unglaubliche Einnahmen für das Unternehmen bedeuten .

Die Nachfrage nach Nvidias Flaggschiff-Rechner-GPU H100 ist so groß, dass sie laut FT bis weit ins Jahr 2024 ausverkauft sind. Das Unternehmen beabsichtige, die Produktion seiner GH100-Prozessoren um mindestens das Dreifache zu steigern, behauptet die Unternehmensseite und beruft sich dabei auf drei Personen, die mit Nvidias Plänen vertraut sind. Die prognostizierten H100-Lieferungen für 2024 liegen zwischen 1,5 und 2 Millionen, was einen deutlichen Anstieg gegenüber den erwarteten 500.000 Einheiten in diesem Jahr darstellt.

Da das CUDA-Framework von Nvidia auf KI- und HPC-Workloads zugeschnitten ist, gibt es Hunderte von Anwendungen, die nur auf den Rechen-GPUs von Nvidia funktionieren. Während sowohl Amazon Web Services als auch Google über ihre eigenen benutzerdefinierten KI-Prozessoren für KI-Training und Inferenz-Workloads verfügen, müssen sie auch Unmengen an Nvidia-Rechen-GPUs kaufen, da ihre Kunden ihre Anwendungen darauf ausführen möchten.

Es wird jedoch nicht einfach sein, das Angebot an Nvidia H100-Rechen-GPUs, der Supercomputing-Plattform GH200 Grace Hopper und darauf basierenden Produkten zu erhöhen. Nvidias GH100 ist ein komplexer Prozessor, der eher schwer herzustellen ist. Um seine Leistung zu verdreifachen, müssen mehrere Engpässe beseitigt werden.

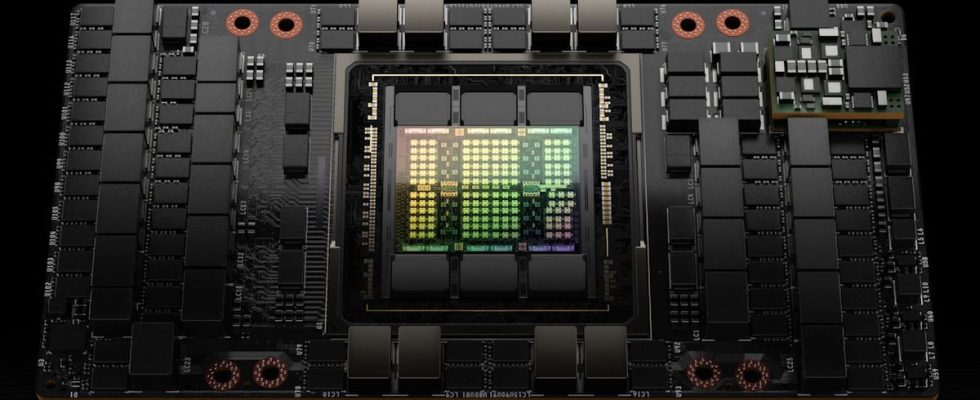

Erstens ist die GH100-Rechen-GPU ein riesiges Stück Silizium mit einer Größe von 814 mm^2, sodass es ziemlich schwierig ist, sie in großen Mengen herzustellen. Auch wenn die Ausbeuten des Produkts mittlerweile recht hoch sein dürften, muss sich Nvidia noch eine Menge 4N-Wafer-Lieferungen von TSMC sichern, um die Produktion seiner GH100-basierten Produkte zu verdreifachen. Eine grobe Schätzung geht davon aus, dass TSMC und Nvidia höchstens 65 Chips pro 300-mm-Wafer bekommen können.

Um 2 Millionen solcher Chips herzustellen, wären somit fast 31.000 Wafer erforderlich – sicherlich möglich, aber es ist ein beträchtlicher Bruchteil der gesamten Waferproduktion der 5-nm-Klasse von TSMC, die etwa 150.000 pro Monat beträgt. Und diese Kapazität teilen sich derzeit AMD CPU/GPU, Apple, Nvidia und andere Unternehmen.

Zweitens setzt GH100 auf HBM2E- oder HBM3-Speicher und nutzt die CoWoS-Verpackung von TSMC, sodass Nvidia auch hier die Versorgung sicherstellen muss. Derzeit hat TSMC Schwierigkeiten, die Nachfrage nach CoWoS-Verpackungen zu befriedigen.

Drittens muss Nvidia genügend HBM-Speicherpakete von Unternehmen wie Micron, Samsung und SK Hynix erhalten, da H100-basierte Geräte HBM2E-, HBM3- oder HBM3E-Speicher verwenden.

Schließlich müssen Nvidias H100-Rechenkarten oder SXM-Module irgendwo installiert werden, sodass Nvidia sicherstellen muss, dass seine Partner auch mindestens die dreifache Leistung ihrer KI-Server erbringen, was ein weiteres Problem darstellt.

Aber wenn Nvidia alle erforderlichen H100-GPUs liefern kann, wird das Unternehmen im nächsten Jahr mit Sicherheit einen enormen Gewinn aus diesem Unterfangen erzielen.