Während Intels Habana Gaudi eine einigermaßen konkurrenzfähige Leistung bietet und mit dem Habana SynapseAI-Softwarepaket geliefert wird, bleibt sie im Vergleich zu Nvidias CUDA-fähigen Rechen-GPUs hinterher. Dies, gepaart mit der begrenzten Verfügbarkeit, ist der Grund, warum Gaudi bei großen Sprachmodellen (LLMs) wie ChatGPT nicht so beliebt war.

Jetzt, da der KI-Ansturm groß ist, wird Intels Habana in breiterem Umfang eingesetzt. Amazon Web Services entschied sich, Intels Gaudi der 1. Generation mit PyTorch und DeepSpeed auszuprobieren, um LLMs zu trainieren, und die Ergebnisse waren vielversprechend genug, um DL1-EC2-Instanzen kommerziell anzubieten.

Das Training großer Sprachmodelle (LLMs) mit Milliarden von Parametern stellt eine Herausforderung dar. Sie benötigen spezielle Trainingstechniken, die die Speicherbeschränkungen eines einzelnen Beschleunigers und die Skalierbarkeit mehrerer zusammenarbeitender Beschleuniger berücksichtigen. Forscher von AWS nutzten DeepSpeed, eine Open-Source-Deep-Learning-Optimierungsbibliothek für PyTorch, die darauf ausgelegt ist, einige der LLM-Trainingsherausforderungen zu mildern und die Modellentwicklung und -schulung zu beschleunigen, sowie auf Intel Habana Gaudi basierende Amazon EC2 DL1-Instanzen für ihre Arbeit. Die erzielten Ergebnisse sehen sehr vielversprechend aus.

Die Forscher bauten mithilfe von AWS Batch einen verwalteten Rechencluster auf, der aus 16 dl1.24xlarge-Instanzen mit jeweils acht Habana Gaudi-Beschleunigern und 32 GB Speicher sowie einem vollständig vermaschten RoCE-Netzwerk zwischen Karten mit einer gesamten bidirektionalen Verbindungsbandbreite von jeweils 700 Gbit/s bestand. Darüber hinaus war der Cluster mit vier AWS Elastic Fabric-Adaptern mit einer Gesamtverbindung von 400 Gbit/s zwischen den Knoten ausgestattet.

Auf der Softwareseite verwendeten die Forscher DeepSpeed ZeRO1-Optimierungen, um das BERT 1.5B-Modell mit verschiedenen Parametern vorab zu trainieren. Ziel war es, die Trainingsleistung und Kosteneffizienz zu optimieren. Um die Modellkonvergenz sicherzustellen, wurden Hyperparameter angepasst und die effektive Chargengröße pro Beschleuniger auf 384 festgelegt, mit Mikrobatches von 16 pro Schritt und 24 Schritten der Gradientenakkumulation.

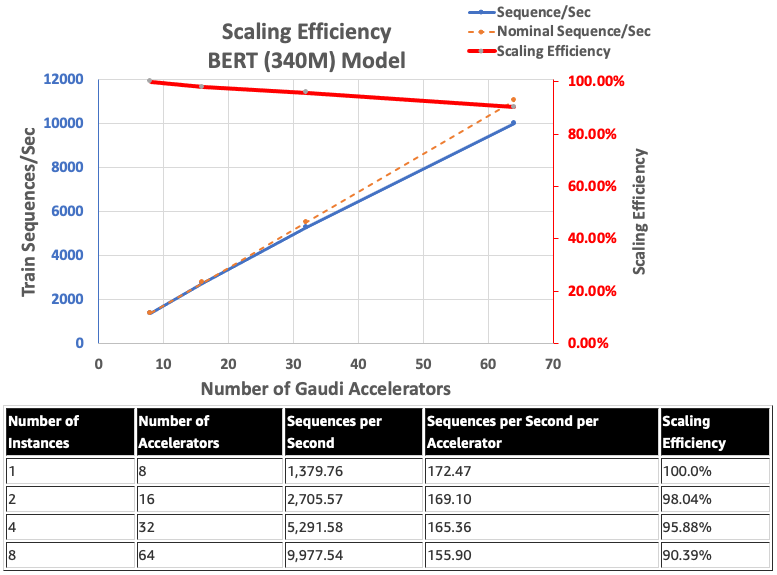

Die Skalierungseffizienz von Intel HabanaGaudi ist tendenziell relativ hoch und fällt nie unter 90 %, wobei acht Instanzen und 64 Beschleuniger ein BERT-340-Millionen-Modell ausführen.

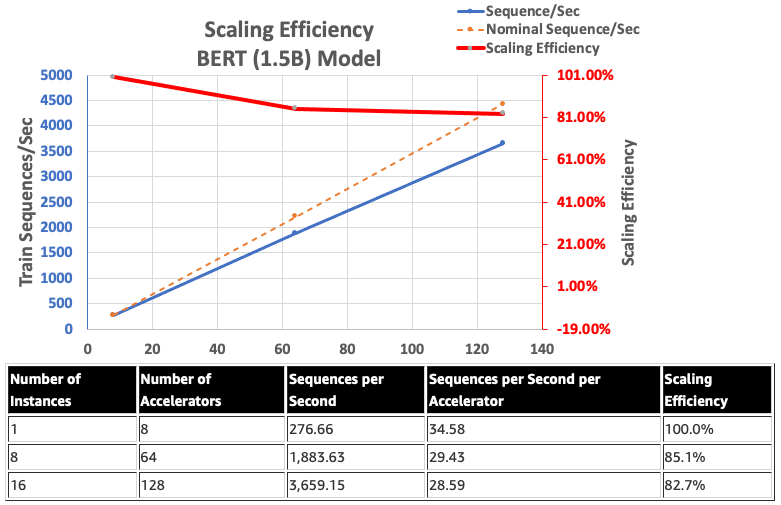

Mithilfe der nativen BF16-Unterstützung von Gaudi reduzierten die AWS-Forscher gleichzeitig den Speicherbedarf und steigerten die Trainingsleistung im Vergleich zum FP32, um 1,5 Milliarden BERT-Modelle zu ermöglichen. Mithilfe von DeepSpeed ZeRO Stufe 1-Optimierungen für ein BERT-Modell mit 340 Millionen bis 1,5 Milliarden Parametern erreichten sie eine Skalierungseffizienz von 82,7 % über 128 Beschleuniger hinweg.

Im Allgemeinen fanden AWS-Forscher heraus, dass mit der richtigen Habana SynapseAI v1.5/v1.6-Software mit DeepSpeed und mehreren Habana Gaudi-Beschleunigern ein BERT-Modell mit 1,5 Milliarden Parametern innerhalb von 16 Stunden vorab trainiert werden konnte und Konvergenz in einem Netzwerk von 128 erreicht wurde Gaudi-Beschleuniger, die eine Skalierungseffizienz von 85 % erreichen. Die Architektur kann im bewertet werden AWS-Workshop.