Bei GenAI kann viel schief gehen – insbesondere bei GenAI von Drittanbietern. Es erfindet Dinge. Es ist voreingenommen und giftig. Und es kann gegen Urheberrechtsbestimmungen verstoßen. Laut einer aktuellen Umfrage von MIT Sloan Management Review und Boston Consulting Group sind KI-Tools von Drittanbietern für über 55 % der KI-bezogenen Ausfälle in Unternehmen verantwortlich.

Daher ist es nicht gerade verwunderlich, dass einige Unternehmen noch zögern, die Technologie einzuführen.

Aber was wäre, wenn GenAI mit einer Garantie ausgestattet wäre?

Das ist die Geschäftsidee, die Karthik Ramakrishnan, ein Unternehmer und Elektroingenieur, vor einigen Jahren hatte, als er als leitender Manager bei Deloitte arbeitete. Er war Mitbegründer zweier „AI-first“-Unternehmen, Gallop Labs und Blu Trumpet, und erkannte schließlich, dass Vertrauen – und die Fähigkeit, Risiken zu quantifizieren – die Einführung von KI behinderten.

„Derzeit sucht fast jedes Unternehmen nach Möglichkeiten, KI zu implementieren, um die Effizienz zu steigern und mit dem Markt Schritt zu halten“, sagte Ramakrishnan gegenüber TechCrunch in einem E-Mail-Interview. „Um dies zu erreichen, wenden sich viele an Drittanbieter und implementieren deren KI-Modelle, ohne die Qualität der Produkte vollständig zu verstehen … KI schreitet so schnell voran, dass sich die Risiken und Schäden ständig weiterentwickeln.“

Also tat sich Ramakrishnan mit Dan Adamson zusammen, einem Experten für Suchalgorithmen und zweifachen Startup-Gründer Armilla KIdas Unternehmenskunden Garantien für KI-Modelle bietet.

Sie fragen sich vielleicht, wie Armilla dies erreichen kann, wenn man bedenkt, dass die meisten Modelle Black Boxes sind oder auf andere Weise hinter Lizenzen, Abonnements und APIs geschützt sind? Ich hatte die gleiche Frage. Durch Benchmarking, war Ramakrishnans Antwort – und einen sorgfältigen Ansatz bei der Kundenakquise.

Armilla nimmt ein Modell – ob Open Source oder proprietär – und führt Bewertungen durch, um „seine Qualität zu überprüfen“, basierend auf der globalen KI-Regulierungslandschaft. Das Unternehmen testet Dinge wie Halluzinationen, rassistische und geschlechtsspezifische Vorurteile und Fairness, allgemeine Robustheit und Sicherheit anhand einer Reihe theoretischer Anwendungen und Anwendungsfälle und nutzt dabei seine interne Bewertungstechnologie.

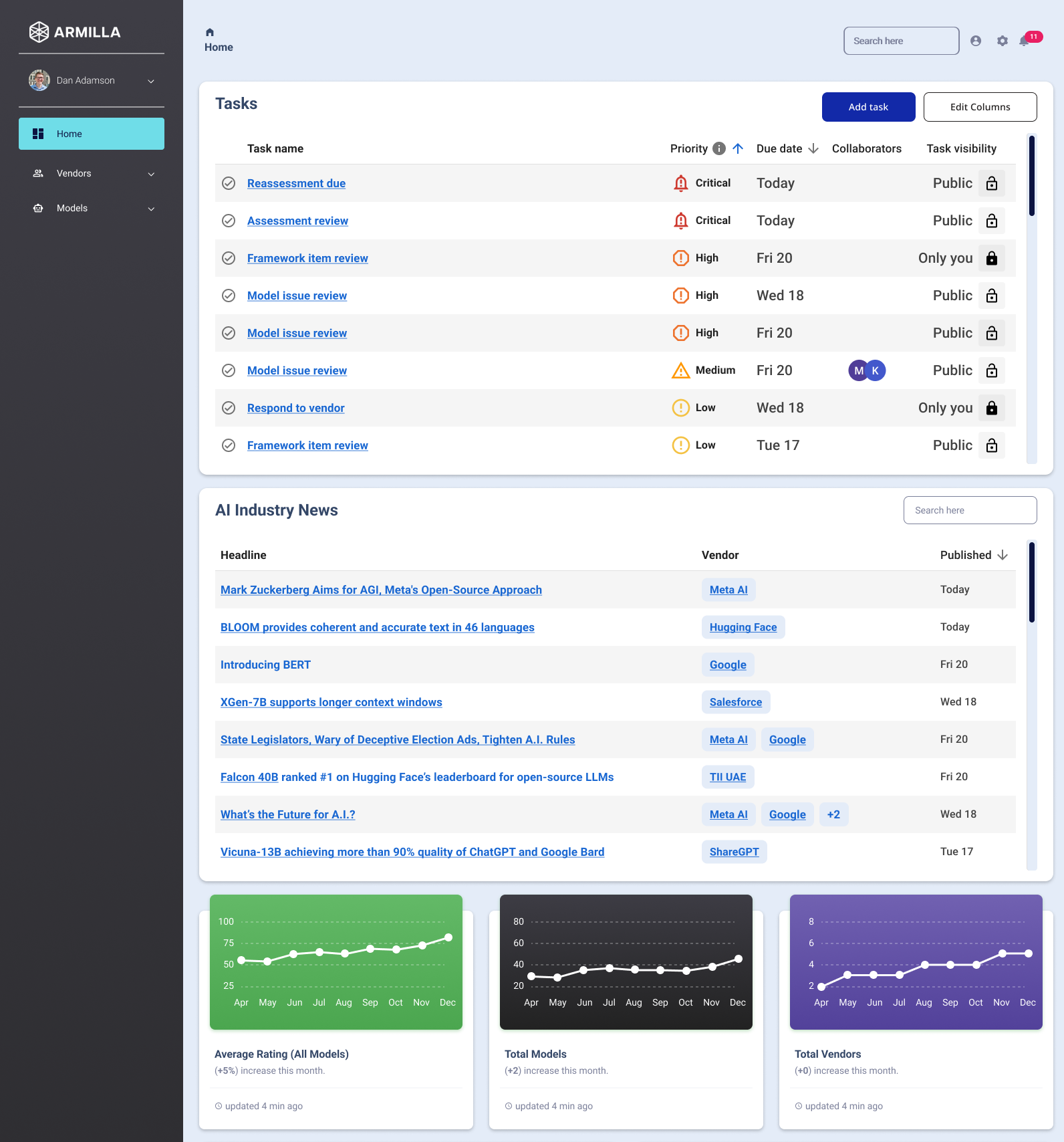

Bildnachweis: Armilla

Wenn das Modell die Prüfung besteht, gewährt Armilla eine Garantie, die dem Käufer des Modells etwaige Gebühren erstattet, die er für die Nutzung des Modells gezahlt hat.

„Was wir Unternehmen wirklich bieten, ist Vertrauen in die Technologie, die sie von externen KI-Anbietern beziehen“, sagte Ramakrishnan. „Unternehmen können zu uns kommen und uns Bewertungen der Anbieter durchführen lassen, die sie nutzen möchten. Genau wie die Penetrationstests, die sie für neue Technologien durchführen würden, führen wir Penetrationstests für KI durch.“

Ich fragte Ramakrishnan übrigens, ob es Armilla-Modelle gäbe würde nicht Testen Sie aus ethischen Gründen – beispielsweise einen Gesichtserkennungsalgorithmus eines Anbieters, der dafür bekannt ist, mit fragwürdigen Akteuren Geschäfte zu machen. Er sagte:

„Es wäre nicht nur gegen unsere Ethik, sondern auch gegen unser Geschäftsmodell, das auf Vertrauen basiert, Bewertungen und Berichte zu erstellen, die falsches Vertrauen in KI-Modelle schaffen, die für einen Kunden und die Gesellschaft problematisch sind.“ Aus rechtlicher Sicht werden wir keine Kunden für Modelle übernehmen, die von der EU verboten sind, die verboten wurden, was beispielsweise bei einigen Systemen zur Gesichtserkennung und biometrischen Kategorisierung der Fall ist, sondern für Anwendungen, die in die EU fallen Kategorie „höheres Risiko“ im Sinne des EU-KI-Gesetzes, ja.“

Nun ist das Konzept von Garantien und Versicherungsschutz für KI nicht neu – eine Tatsache, die diesen Autor ehrlich gesagt überrascht hat. Im Jahr 2018 stellte Munich Re mit aiSure ein Versicherungsprodukt vor, das zum Schutz vor Verlusten durch potenziell unzuverlässige KI-Modelle entwickelt wurde, indem die Modelle ähnliche Benchmarks wie Armilla durchlaufen. Außerhalb der Garantien bieten immer mehr Anbieter, darunter OpenAI, Microsoft und AWS, Schutz vor Urheberrechtsverletzungen, die durch den Einsatz ihrer KI-Tools entstehen können.

Aber Ramakrishnan behauptet, Armillas Ansatz sei einzigartig.

„Unsere Bewertung betrifft ein breites Spektrum an Bereichen, darunter KPIs, Prozesse, Leistung, Datenqualität sowie qualitative und quantitative Kriterien, und wir führen dies zu einem Bruchteil der Kosten und des Zeitaufwands durch“, fügte er hinzu. „Wir bewerten KI-Modelle auf der Grundlage von Anforderungen, die in Rechtsvorschriften wie dem EU AI Act oder dem AI-Recruiting-Bias-Gesetz in NYC – NYC Local Law 144 – und anderen staatlichen Vorschriften, wie der vorgeschlagenen Verordnung zu quantitativen KI-Tests in Colorado oder dem Versicherungsrundschreiben von New York, festgelegt sind.“ der Einsatz von KI beim Underwriting oder der Preisgestaltung. Wir sind auch bereit, Bewertungen durchzuführen, die aufgrund anderer neuer Vorschriften erforderlich sind, sobald diese in Kraft treten, beispielsweise dem kanadischen AI and Data Act.“

Armilla, das Ende 2023 mit Unterstützung der Versicherungsträger Swiss Re, Greenlight Re und Chaucer eine Versicherung aufnahm, gibt an, etwa zehn Kunden zu haben, darunter ein Gesundheitsunternehmen, das GenAI zur Verarbeitung von Krankenakten einsetzt. Ramakrishnan erzählt mir, dass der Kundenstamm von Armilla seit dem vierten Quartal 2023 monatlich um das Zweifache gewachsen ist.

„Wir bedienen zwei Hauptzielgruppen: Unternehmen und Drittanbieter von KI“, sagte Ramakrishnan. „Unternehmen nutzen unsere Garantie, um den KI-Drittanbietern, die sie beziehen, Schutz zu bieten. Drittanbieter nutzen unsere Garantie als Gütesiegel dafür, dass ihr Produkt vertrauenswürdig ist, was dazu beiträgt, ihre Verkaufszyklen zu verkürzen.“

Garantien für KI sind intuitiv sinnvoll. Aber ein Teil von mir fragt sich, ob Armilla in der Lage sein wird, mit der sich schnell verändernden KI-Politik (z. B. dem New Yorker Gesetz zur Voreingenommenheit von Einstellungsalgorithmen, dem EU-KI-Gesetz usw.) Schritt zu halten, was das Unternehmen in die Lage versetzen könnte, beträchtliche Auszahlungen zu erhalten, wenn dies der Fall ist Beurteilungen – und Verträge – sind nicht kugelsicher.

Ramakrishnan wischte diese Sorge beiseite.

„Die Regulierung entwickelt sich in vielen Gerichtsbarkeiten unabhängig voneinander rasch weiter“, sagte er, „und es wird von entscheidender Bedeutung sein, die Nuancen der Gesetzgebung auf der ganzen Welt zu verstehen.“ Es gibt keinen „Einheitsstandard“, den wir als globalen Standard anwenden können, also müssen wir alles zusammenfügen. Das ist eine Herausforderung – hat aber den Vorteil, dass für uns ein „Graben“ entsteht.“

Armilla – mit Sitz in Toronto und 13 Mitarbeitern – sammelte kürzlich 4,5 Millionen US-Dollar in einer von Mistral angeführten Seed-Runde (nicht zu verwechseln mit dem gleichnamigen KI-Startup) unter Beteiligung von Greycroft, Differential Venture Capital, Mozilla Ventures, Betaworks Ventures, MS&AD Ventures, 630 Ventures, Morgan Creek Digital, Y Combinator, Greenlight Re und Chaucer. Ramakrishnan erhöhte die Gesamtsumme auf 7 Millionen US-Dollar und sagte, dass der Erlös in die Erweiterung des bestehenden Garantieangebots von Armilla sowie in die Einführung neuer Produkte fließen werde.

„Versicherungen werden die größte Rolle bei der Bewältigung von KI-Risiken spielen, und Armilla ist führend bei der Entwicklung von Versicherungsprodukten, die es Unternehmen ermöglichen, KI-Lösungen sicher einzusetzen“, sagte Ramakrishnan.