Ampere hat diese Woche seine vorgestellt AmpereOne-Prozessoren für Cloud-Rechenzentren, die zufällig die ersten Allzweck-CPUs der Branche mit bis zu 132 sind, die für KI-Inferenz verwendet werden können.

Die neuen Chips verbrauchen mehr Strom als ihre Vorgänger – Ampere Altra (die zumindest für eine Weile im Ampere-Sortiment bleiben werden) – aber das Unternehmen behauptet, dass seine Prozessoren mit bis zu 192 Kernen trotz des höheren Stromverbrauchs eine höhere Rechendichte als CPUs bieten von AMD und Intel. Einige dieser Leistungsansprüche können umstritten sein.

192 benutzerdefinierte Cloud Native-Kerne

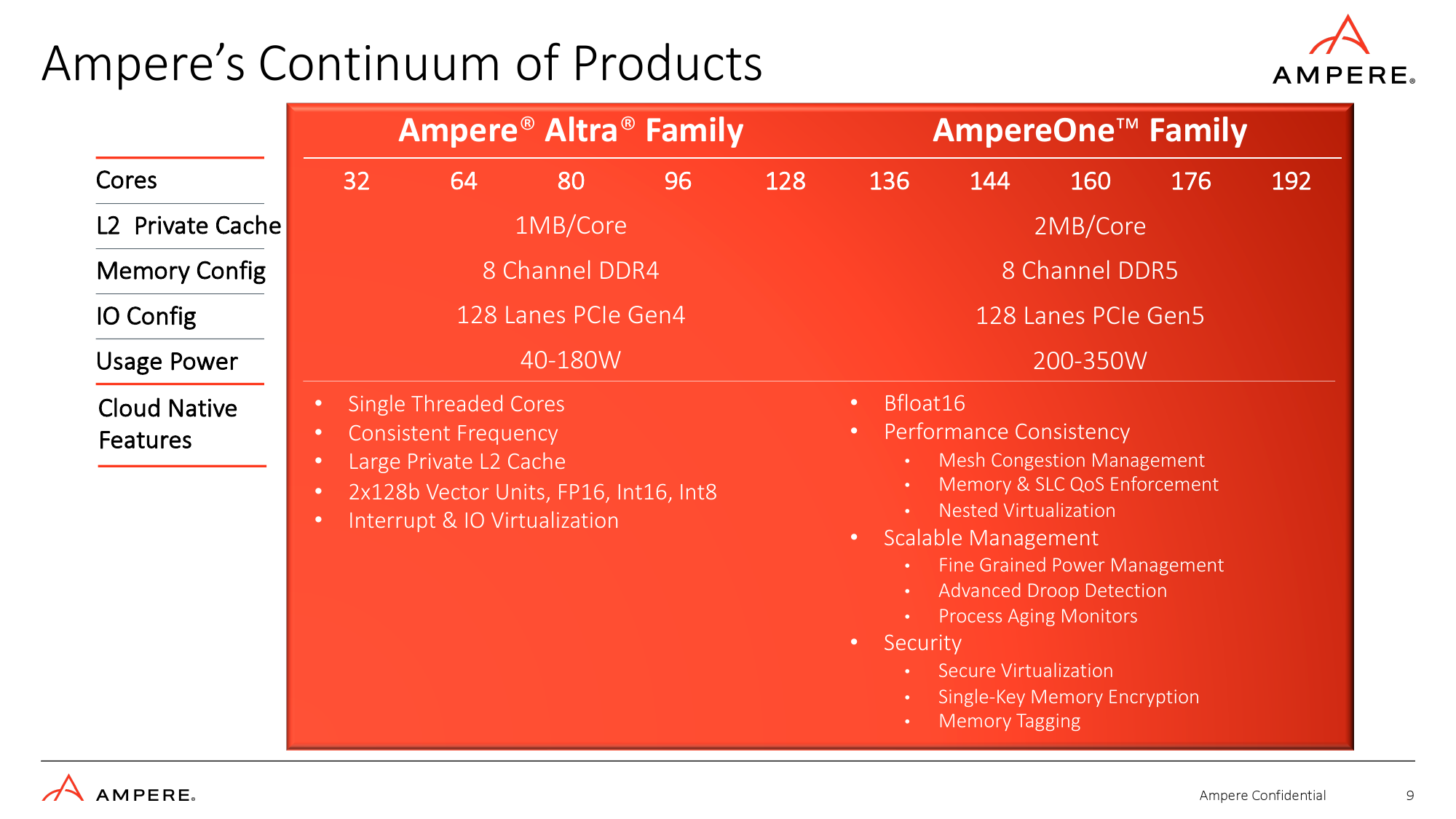

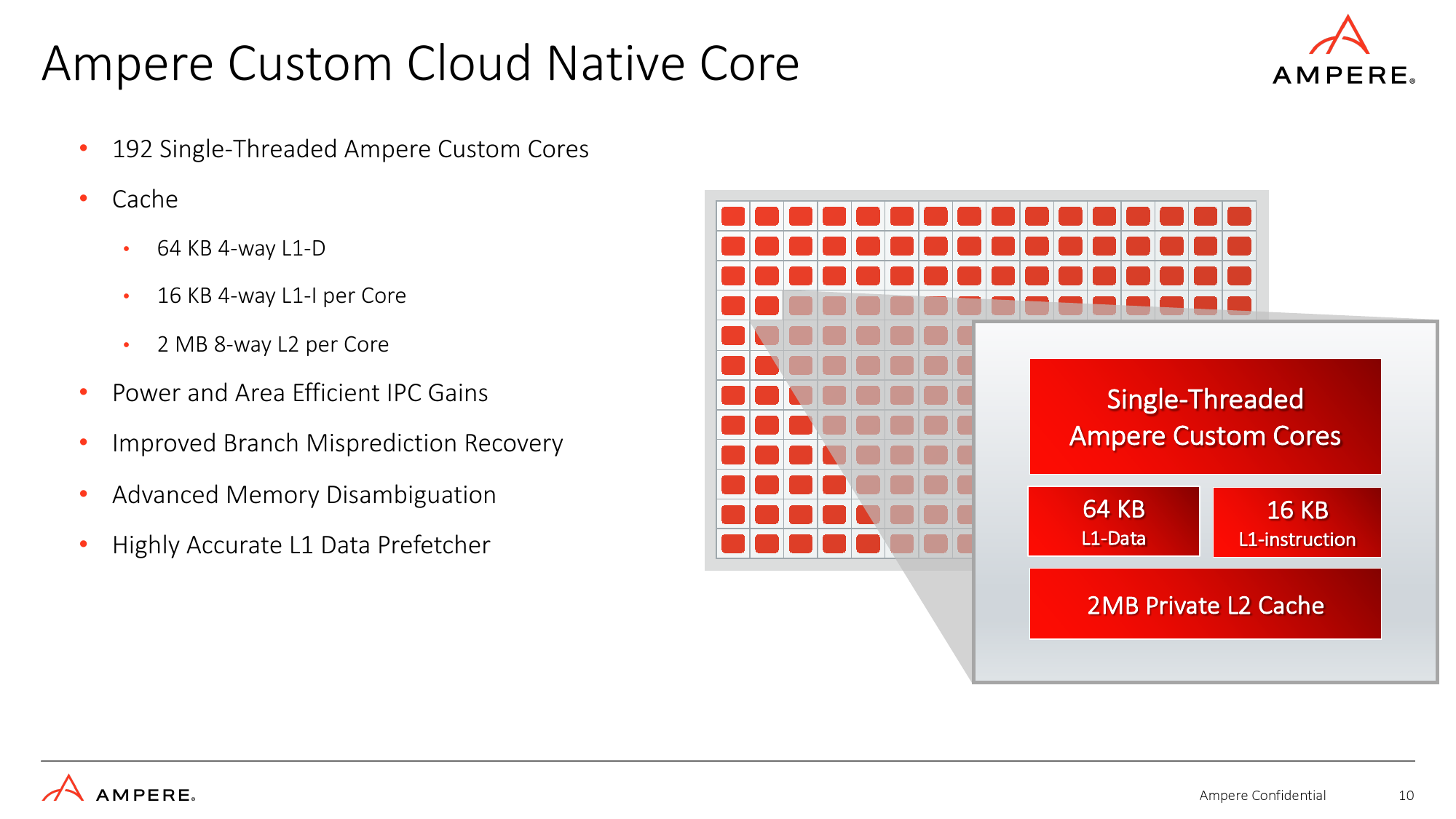

Die AmpereOne-Prozessoren von Ampere verfügen über 136 bis 192 Kerne (im Gegensatz zu 32 bis 128 Kernen beim Ampere Altra), die mit bis zu 3,0 GHz laufen und auf der firmeneigenen Implementierung der Armv8.6+-Befehlssatzarchitektur (mit zwei 128-Bit-Vektoren) basieren Einheiten, die die Formate FP16, BF16, INT16 und INT8 unterstützen), die mit 2 MB 8-Wege-Set-Assoziativitäts-L2-Cache pro Kern ausgestattet sind (vorher 1 MB) und über ein mechanisches Netzwerk mit 64 Heimknoten und verzeichnisbasiertem Snoop miteinander verbunden sind Filter. Zusätzlich zu den L1- und L2-Caches verfügt der SoC auch über einen 64-MB-Cache auf Systemebene. Die neuen CPUs sind abhängig von der genauen SKU für 200 W – 350 W ausgelegt, beim Ampere Altra sind es 40 W – 180 W.

Das Unternehmen gibt an, dass seine neuen Kerne weiter für Cloud- und KI-Workloads optimiert sind und über Leistungs- und Effizienzsteigerungen bei den Anweisungen pro Takt (IPC) verfügen, was wahrscheinlich einen höheren IPC (im Vergleich zu Arms Neoverse N1, der für Altra verwendet wird) ohne spürbare Steigerung bedeutet hinsichtlich Stromverbrauch und Chipfläche. Apropos Chip-Bereich: Ampere macht keine Angaben dazu, sagt aber, dass der AmpereOne auf einer der 5-nm-Klasse-Prozesstechnologien von TSMC hergestellt wird.

Obwohl Ampere nicht alle Details zu seinem AmpereOne-Kern preisgibt, heißt es, dass sie über einen hochpräzisen L1-Daten-Prefetcher verfügen (reduziert die Latenz, stellt sicher, dass die CPU weniger Zeit mit dem Warten auf Daten verbringt und reduziert den Stromverbrauch des Systems durch Minimierung der Speicherzugriffe). verfeinerte Verzweigungsfehlvorhersage-Wiederherstellung (je früher die CPU eine Verzweigungsfehlvorhersage erkennen und wiederherstellen kann, desto geringer wird die Latenz und es wird weniger Strom verschwendet) und ausgefeilte Speicher-Disambiguierung (erhöht den IPC, minimiert Pipeline-Störungen, maximiert die Ausführung außerhalb der Reihenfolge, senkt Latenz und verbessert die Handhabung mehrerer Lese-/Schreibanforderungen in virtualisierten Umgebungen).

Während die Liste der Verbesserungen der AmpereOne-Kernarchitektur auf dem Papier nicht allzu lang erscheint, können diese Dinge tatsächlich die Leistung erheblich verbessern und erforderten eine Menge Recherche (z. B. welche Dinge verlangsamen die Leistung einer Cloud-Rechenzentrums-CPU am meisten?) und viel Arbeit, sie effizient umzusetzen.

Erweiterte Sicherheit und E/A

Da der AmpereOne SoC auf Cloud-Rechenzentren ausgerichtet ist, ist er mit entsprechendem I/O ausgestattet, der acht DDR5-Kanäle für bis zu 16 Module mit Unterstützung von bis zu 8 TB Speicher pro Sockel, 128 Lanes PCIe Gen5 mit 32 Controllern und x4-Verzweigung umfasst.

Rechenzentren erfordern außerdem bestimmte Zuverlässigkeits-, Verfügbarkeits-, Wartungsfreundlichkeits- (RAS) und Sicherheitsfunktionen. Zu diesem Zweck unterstützt das SoC vollständig ECC-Speicher, Single-Key-Speicherverschlüsselung, Speicher-Tagging, sichere Virtualisierung und verschachtelte Virtualisierung, um nur einige davon zu nennen. Darüber hinaus verfügt AmpereOne über zahlreiche Sicherheitsfunktionen wie Krypto- und Entropiebeschleuniger, Abwehr spekulativer Seitenkanalangriffe, Abwehr von ROP/JOP-Angriffen usw.

Kuriose Benchmark-Ergebnisse

Ohne Zweifel ist der AmpereOne SoC von Ampere ein beeindruckendes Stück Silizium, das für die Bewältigung von Cloud-Workloads entwickelt wurde und über 192 Allzweckkerne verfügt – das erste in der Branche. Doch um seine Argumente zu beweisen, verwendet Ampere eher merkwürdige Benchmark-Ergebnisse.

Als Hauptvorteil sieht Ampere die Rechendichte seines AmpereOne. Das Unternehmen gibt an, dass ein 42U-16,5-kW-Rack mit 192-Kern-AmpereOne-SoC-basierten 1S-Maschinen bis zu 7926 virtuelle Maschinen unterstützen kann, während ein Rack auf Basis von AMDs 96-Kern-EPYC 9654 „Genoa“ 2496 VMs und ein Rack mit Strom versorgen kann Die 56-Core Xeon Scalable 8480+ „Sapphire Rapids“-CPUs von Intel können 1680 VMs verarbeiten. Dieser Vergleich macht bei einem Leistungsbudget von 16,5 kW durchaus Sinn.

Aber die Leistungsdichte von 42U-Racks nimmt zu und Ex-Scaler wie AWS, Google und Microsoft sind darauf vorbereitet, insbesondere für ihre leistungsintensiven Workloads. Basierend auf einer Umfrage von UpTimeInstitute Im Jahr 2020 können wir sagen, dass 16 % der Unternehmen typische 42U-Rakcs mit einer Rack-Leistungsdichte von 20 kW bis über 50 kW eingesetzt haben. Mittlerweile ist die Anzahl typischer Bereitstellungen mit 20-kW-Racks gestiegen und nicht gesunken, da die CPUs der neuesten und vorherigen Generation von AMD ihre TDPs im Vergleich zu ihren Vorgängern erhöht haben.

Wenn es um Leistung geht, demonstriert Ampere die Vorteile seines AmpereOne-basierten Systems mit 160 Kernen und 512 GB Speicher, auf dem Generative AI (stabile Diffusion) und AI Recommenders (DLRM) ausgeführt werden, gegenüber Systemen, die auf der 96-Kern-EPYC 9654-CPU von AMD mit 256 GB basieren Speicher (was bedeutet, dass es im Acht-Kanal-Modus funktionierte, nicht im 12-Kanal-Modus, der von Genoa unterstützt wird). Ampere-basierte Maschinen produzierten 2,3-mal mehr Frames/s für generative KI und über 2-mal mehr Abfragen/s für KI-Empfehlungen.

In diesem Fall verglich Ampere die Leistung seiner Systeme bei der Datenverarbeitung mit einer FP16-Präzision, während AMD-basierte Maschinen mit einer FP32-Präzision gerechnet haben, was kein direkter Vergleich ist. Darüber hinaus werden viele FP16-Workloads mittlerweile auf GPUs statt auf CPUs ausgeführt, und massiv parallele GPUs liefern tendenziell spektakuläre Ergebnisse bei generativen KI- und AI-Empfehlungs-Workloads.

Zusammenfassung

Ampere’s AmpereOne sind die branchenweit ersten Allzweck-CPUs mit bis zu 192 Kernen, was sicherlich großen Respekt verdient. Diese CPUs verfügen außerdem über robuste I/O-Fähigkeiten, erweiterte Sicherheitsfunktionen und versprechen verbesserte IPC-Gewinne (Instructions per Clock). Außerdem können sie KI-Workloads mit FP16-, BF16-, FP8- und INT8-Präzision ausführen.

Allerdings entschied sich das Unternehmen dazu, eher kontroverse Methoden zu verwenden, um seine Argumente bei den Benchmark-Ergebnissen unter Beweis zu stellen, was einen gewissen Schatten auf seine Erfolge wirft. Dennoch wird es besonders interessant sein, unabhängige Testergebnisse von AmpereOne-basierten Servern zu sehen.