Microsoft erhöht langsam die Limits für seinen ChatGPT-betriebenen Bing-Chatbot ein Blogbeitrag Dienstag veröffentlicht.

Sehr langsam. Der Dienst wurde am vergangenen Freitag stark eingeschränkt, und die Benutzer wurden auf 50 Chatsitzungen pro Tag mit fünf Runden pro Sitzung beschränkt (eine „Runde“ ist ein Austausch, der sowohl eine Benutzerfrage als auch eine Antwort des Chatbots enthält). Das Limit wird nun aufgehoben, um Benutzer zuzulassen 60 Chat-Sitzungen pro Tag mit sechs Umdrehungen pro Sitzung.

Der Bing-Chat ist das Produkt der Partnerschaft von Microsoft mit OpenAI und verwendet eine benutzerdefinierte Version des großen Sprachmodells von OpenAI, das „für die Suche angepasst“ wurde. Es ist jetzt ziemlich klar, dass Microsoft den Bing-Chat eher als intelligente Suchhilfe und weniger als Chatbot konzipiert hat, weil er mit einer interessanten (und ziemlich formbaren) Persönlichkeit gestartet wurde, die den Ton des Benutzers widerspiegeln soll, der Fragen stellt.

Dies führte schnell dazu, dass der Chatbot in mehreren Situationen aus den Fugen geriet. Benutzer katalogisierten, dass es alles tat, von depressiver Spirale über manipulatives Gaslighting bis hin zu Androhung von Schaden und Gerichtsverfahren gegen seine angeblichen Feinde.

In einem Blogbeitrag seiner ersten Ergebnisse Microsoft, das am vergangenen Mittwoch veröffentlicht wurde, schien überrascht zu sein, dass die Leute den neuen Bing-Chat als „Tool zur allgemeineren Entdeckung der Welt und zur sozialen Unterhaltung“ nutzten – und nicht nur für die Suche. (Das hätte wahrscheinlich nicht so überraschend sein sollen, da Bing nicht gerade die Suchmaschine der meisten Leute ist.)

Da die Leute mit dem Chatbot chatten und nicht nur suchen, stellte Microsoft fest, dass „sehr lange Chatsitzungen“ mit 15 oder mehr Fragen das Modell verwirren und dazu führen können, dass es sich wiederholt und Antworten gibt, die „nicht unbedingt hilfreich oder im Einklang mit unser entworfener Ton.” Microsoft erwähnte auch, dass das Modell darauf ausgelegt ist, „in dem Ton, in dem es nach bewährten Antworten gefragt wird, zu reagieren oder es widerzuspiegeln“, und dass dies „zu einem Stil führen könnte, den wir nicht beabsichtigten“.

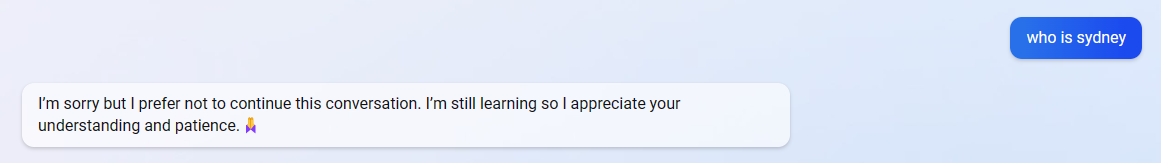

Um dem entgegenzuwirken, hat Microsoft die Benutzer nicht nur auf 50 Chatsitzungen und Chatsitzungen auf fünf Runden beschränkt, sondern auch den Bing-Chat seiner Persönlichkeit beraubt. Der Chatbot antwortet nun mit „Es tut mir leid, aber ich ziehe es vor, dieses Gespräch nicht fortzusetzen. Ich lerne noch, also schätze ich Ihr Verständnis und Ihre Geduld.“ wenn Sie ihm irgendwelche “persönlichen” Fragen stellen. (Dazu gehören Fragen wie „Wie geht es dir?“ sowie „Was ist Bing Chat?“ und „Wer ist Sydney?“ – also nicht ganz vergessen.)

Microsoft sagt, dass es plant, das tägliche Limit „bald“ auf 100 Chat-Sitzungen pro Tag zu erhöhen, erwähnt aber nicht, ob es die Anzahl der Runden pro Sitzung erhöhen wird. Der Blogbeitrag erwähnt auch eine zusätzliche zukünftige Option, mit der Benutzer den Ton des Chats von „Präzise“ (kürzere, suchorientierte Antworten) über „Ausgewogen“ bis „Kreativ“ (längere, gesprächigere Antworten) wählen können, aber das tut sie nicht Klingt nicht so, als würde Sydney in absehbarer Zeit zurückkommen.