AMD kündigte heute auf seiner Data Center- und AI Technology Premiere-Veranstaltung hier in San Francisco, Kalifornien, eine Reihe neuer Produkte an. Das Unternehmen teilte schließlich weitere Details zu seinen Instinct MI300A-Prozessoren mit, die über 3D-gestapelte CPU- und GPU-Kerne im selben Paket mit HBM verfügen, sowie zu einem neuen reinen GPU-Modell MI300X, das acht Beschleuniger auf einer Plattform mit unglaublichen 1,5 TB HBM3 vereint Speicher.

Das Unternehmen gab außerdem Ankündigungen über seine 5-nm-EPYC-Bergamo-Prozessoren für Cloud-native-Anwendungen und seine EPYC-Genoa-X-Prozessoren mit bis zu 1,1 GB L3-Cache bekannt. Alle drei dieser Produkte sind ab sofort erhältlich, aber AMD bringt in der zweiten Hälfte des Jahres 2023 auch seine EPYC-Sienna-Prozessoren für Telekommunikationsunternehmen und Edge auf den Markt.

In Kombination mit AMDs Portfolio an Alveo- und Pensando-Netzwerken und DPUs verfügt AMD über eine vollständige Palette an Produkten, die auf KI-Workloads ausgerichtet sind, und steht damit in direkter Konkurrenz zum Marktführer Nvidia, seinem Hauptkonkurrenten für KI-Beschleunigungsprodukte, und Intel, das ebenfalls mehrere KI-Produkte anbietet -Beschleunigungslösungen für eine breite Produktpalette.

Dieser Artikel konzentriert sich auf die Neuigkeiten rund um den MI300, wir werden jedoch in Kürze Links zu unseren anderen Inhalten hinzufügen. Wir haben die Informationen gerade von AMD erhalten, daher wird dieser Artikel aktualisiert, sobald wir weitere Details hinzufügen.

AMD Instinct MI300

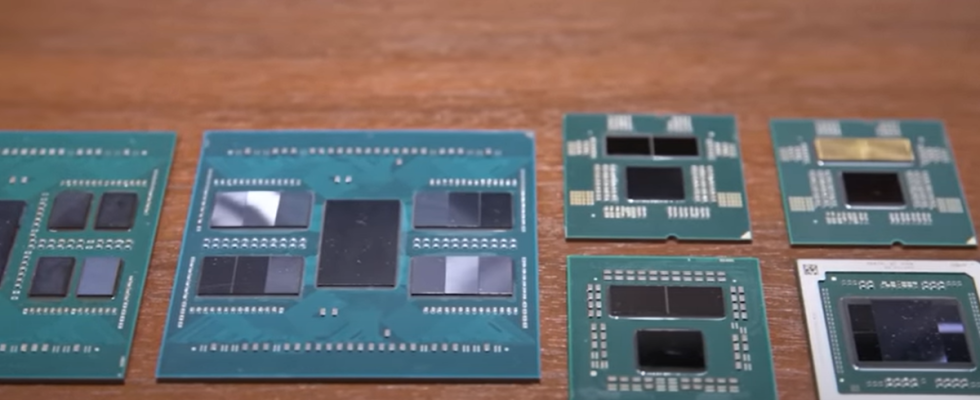

Der Instinct MI300A ist eine Rechenzentrums-APU, die insgesamt 13 Chiplets, viele davon 3D-gestapelt, zu einem einzigen Chippaket mit vierundzwanzig Zen 4-CPU-Kernen kombiniert, die mit einer CDNA 3-Grafik-Engine und acht Stapeln HBM3-Speicher kombiniert sind insgesamt 128 GB. Insgesamt wiegt der Chip 146 Milliarden Transistoren und ist damit der größte Chip, den AMD in Produktion gebracht hat. Die neun Rechenchips, eine Mischung aus 5-nm-CPUs und GPUs, sind 3D-gestapelt auf vier 6-nm-Basischips, bei denen es sich um aktive Interposer handelt, die unter anderem Speicher- und I/O-Verkehr verarbeiten. Der Instinct MI300 wird den Zwei-Exaflop-Supercomputer El Capitan antreiben, der voraussichtlich der schnellste der Welt sein wird, wenn er später in diesem Jahr online geht.

Heute hat AMD eine reine GPU-Variante, den MI300X, angekündigt und mehrere Demos seiner Leistung präsentiert. Der reine GPU-MI300X ist für große Sprachmodelle (LLMs) optimiert und ist nur mit CDNA3-GPU-Kacheln gepaart mit 192 GB HBM3-Speicher ausgestattet.

Die umfangreiche Speicherkapazität, verteilt auf 24 GB HBM3-Chips, ermöglicht es dem Chip, LLMs mit bis zu 80 Milliarden Parametern auszuführen, was laut AMD einen Rekord für eine einzelne GPU darstellt. Der Chip liefert 5,2 TB/s Speicherbandbreite über acht Kanäle und 896 GB/s Infinity Fabric-Bandbreite. Der MI300X bietet eine 2,4-fache HBM-Dichte als der Nvidia H100 und eine 1,6-fache HBM-Bandbreite als der H100, was bedeutet, dass AMD größere Modelle als die Chips von Nvidia betreiben kann.

Der Chip besteht aus 12 verschiedenen Chiplets auf einer Mischung aus 5-nm- (GPU) und 6-nm-Knoten (I/O-Chip), die acht GPUs und mehrere I/O-Chips umfassen, für insgesamt 153 Milliarden Transistoren.

Der MI300A kann in mehreren verschiedenen Modi ausgeführt werden, aber der primäre Modus besteht aus einer einzelnen Speicherdomäne und einer NUMA-Domäne und bietet so einen einheitlichen Zugriffsspeicher für alle CPU- und GPU-Kerne. Mittlerweile nutzt der MI300X kohärenten Speicher zwischen allen seinen GPU-Clustern. Die wichtigste Erkenntnis besteht darin, dass der Cache-kohärente Speicher die Datenbewegung zwischen CPU und GPU reduziert, die häufig mehr Strom verbraucht als die Berechnung selbst, wodurch die Latenz verringert und Leistung und Energieeffizienz verbessert werden.

AMD führte eine Demo eines Falcon-40B-Modells mit 40 Milliarden Parametern durch, das auf einer einzelnen MI300X-GPU läuft, es wurden jedoch keine Leistungsmetriken bereitgestellt. Stattdessen schrieb das LLM ein Gedicht über San Francisco, den Ort der AMD-Veranstaltung. Laut AMD ist dies das erste Mal, dass ein so großes Modell auf einer einzigen GPU läuft.

AMD kündigte außerdem die AMD Instinct Platform an, die acht MI300X-GPUs auf einem einzigen Server-Motherboard mit insgesamt 1,5 TB HBM3-Speicher vereint. Diese Plattform ist im Gegensatz zu Nvidias proprietären MGX-Plattformen OCP-kompatibel. Laut AMD wird dieses Open-Source-Design die Bereitstellung beschleunigen.

MI300A, das CPU+GPU-Modell, ist jetzt im Test. Die MI300X- und 8-GPU-Instinct-Plattform wird im dritten Quartal getestet und im vierten Quartal auf den Markt gebracht. Wir sind immer noch auf der Suche nach weiteren Details – weitere Informationen folgen in den kommenden Stunden.